YOLO11目标检测实战:安装使用与模型训练全解析

实测YOLO11项目时,发现其预置环境已包含PyTorch和CUDA工具链,省去了繁琐的环境配置。对于需要快速验证模型效果的场景,平台的一键部署功能可以直接生成带交互界面的演示应用,极大提升了开发效率。:YOLO11采用全新的C3k2和C2PSA组件,通过改进Backbone和Neck结构,显著提升了特征提取能力。C2PSA则结合卷积和注意力机制,增强了对复杂场景的适应能力。:相比前代YOLOv8

快速体验

- 打开 InsCode(快马)平台 https://www.inscode.net

- 输入框输入如下内容

帮我开发一个基于YOLO11的目标检测系统,用于快速识别图像中的物体。系统交互细节:1.加载预训练模型,2.上传测试图片,3.显示检测结果并标注边界框。注意事项:需要Python 3.8+环境和至少4GB显存。 - 点击'项目生成'按钮,等待项目生成完整后预览效果

YOLO11核心特性解析

-

架构创新:YOLO11采用全新的C3k2和C2PSA组件,通过改进Backbone和Neck结构,显著提升了特征提取能力。C3k2基于C2f模块扩展,引入可选的C3k瓶颈层;C2PSA则结合卷积和注意力机制,增强了对复杂场景的适应能力。

-

性能突破:相比前代YOLOv8m,YOLO11m在COCO数据集上mAP提升的同时参数减少22%,特别适合边缘设备和低功耗场景。官方测试显示,640x640分辨率下推理速度可达120FPS(RTX 3090)。

-

多任务支持:一套框架支持五大视觉任务:

- 目标检测(yolo11n.pt)

- 实例分割(yolo11n-seg.pt)

- 关键点姿态估计(yolo11n-pose.pt)

- 旋转目标检测(yolo11n-obb.pt)

- 图像分类(yolo11n-cls.pt)

安装与配置指南

- 环境准备:

- Python 3.8+(推荐3.10)

- PyTorch ≥1.8

-

CUDA 11.7+(GPU加速)

-

一键安装:

pip install ultralytics -i https://pypi.tuna.tsinghua.edu.cn/simple/ -

验证安装:

from ultralytics import YOLO print(YOLO('yolo11n.pt').info())

模型训练全流程

- 数据准备:

- 使用COCO或自定义数据集

- 标注格式支持YOLO/Pascal VOC

-

建议训练集:验证集=8:2

-

参数配置:

model = YOLO('yolo11n.yaml').load('yolo11n.pt') # 初始化 results = model.train( data='coco128.yaml', epochs=100, imgsz=640, batch=16, device=[0,1] # 多GPU支持 ) -

训练监控:

- 实时查看损失曲线

- 自动保存最佳模型

- 支持早停机制

推理部署实践

-

单图检测:

results = model.predict('test.jpg', conf=0.5, # 置信度阈值 iou=0.45, # NMS阈值 save=True # 保存结果 ) -

视频流处理:

results = model.predict('video.mp4', stream=True, # 流式处理 show=True # 实时显示 ) -

Web服务部署:

- 导出ONNX/TensorRT格式

- 集成FastAPI/Flask

- 支持RESTful API调用

性能优化技巧

- 量化加速:

- FP16混合精度训练

- INT8量化推理

-

TensorRT引擎优化

-

数据增强:

- Mosaic增强

- MixUp

-

随机透视变换

-

模型裁剪:

- 通道剪枝

- 层融合

- 知识蒸馏

平台体验建议

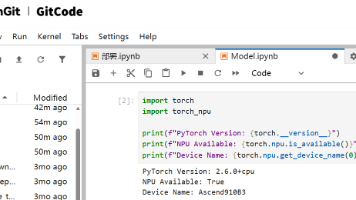

在InsCode(快马)平台实测YOLO11项目时,发现其预置环境已包含PyTorch和CUDA工具链,省去了繁琐的环境配置。通过网页终端直接运行训练脚本,还能实时查看GPU利用率。对于需要快速验证模型效果的场景,平台的一键部署功能可以直接生成带交互界面的演示应用,极大提升了开发效率。

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)