终极指南:如何用vid2vid实现自动驾驶视频模拟

vid2vid是一个基于PyTorch的高分辨率视频到视频转换框架,专门用于将语义标签地图转换为逼真的视频序列。在自动驾驶领域,这项技术可以将简单的语义地图实时渲染成真实的道路场景视频,为算法测试和场景仿真提供强大的工具支持。## 🚀 vid2vid自动驾驶应用场景自动驾驶系统的开发和测试需要大量的真实道路场景数据,但获取这些数据成本高昂且存在安全风险。vid2vid完美解决了这个问题,

vid2vid是一个基于PyTorch的高分辨率视频到视频转换框架,专门用于将语义标签地图转换为逼真的视频序列。在自动驾驶领域,这项技术可以将简单的语义地图实时渲染成真实的道路场景视频,为算法测试和场景仿真提供强大的工具支持。

🚀 vid2vid自动驾驶应用场景

自动驾驶系统的开发和测试需要大量的真实道路场景数据,但获取这些数据成本高昂且存在安全风险。vid2vid完美解决了这个问题,它能够:

- 语义地图到真实路况转换 - 将抽象的道路标记转换为逼真的街景视频

- 多场景实时生成 - 支持不同天气、光照条件下的道路场景仿真

- 高分辨率视频合成 - 最高支持2048x1024分辨率,确保细节丰富真实

📁 项目核心架构解析

vid2vid项目采用模块化设计,核心功能分布在多个目录中:

- 数据处理模块 - data/ 包含各种数据集加载器和预处理工具

- 模型定义 - models/ 包含生成器和判别器的完整实现

- 训练配置 - options/ 提供完整的训练参数配置选项

- 示例脚本 - scripts/ 提供开箱即用的训练和测试脚本

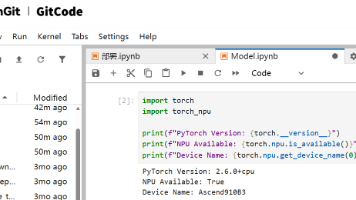

🛠️ 快速上手配置步骤

环境准备与安装

首先克隆项目仓库:

git clone https://gitcode.com/gh_mirrors/vi/vid2vid

cd vid2vid

安装必要的依赖库:

pip install dominate requests

自动驾驶场景测试

对于自动驾驶应用,推荐使用Cityscapes数据集进行测试:

- 下载预训练模型

python scripts/street/download_models.py

- 运行测试脚本

bash ./scripts/street/test_2048.sh

自定义训练流程

如果需要针对特定自动驾驶场景进行训练,可以按照以下步骤:

- 数据准备 - 准备语义标签地图和对应的真实图像

- 配置参数 - 在options/train_options.py中调整训练参数

- 分阶段训练 - 从低分辨率开始,逐步提升到高分辨率

💡 技术优势与特点

高保真视频生成

vid2vid采用渐进式训练策略,能够生成极其逼真的视频序列。在自动驾驶应用中,这意味着:

- 真实的光照效果 - 准确仿真不同时间段的阳光角度和强度

- 自然的动态变化 - 车辆、行人、树木等元素的运动符合物理规律

- 细节丰富 - 从路面的纹理到建筑物的外观都高度真实

多模态支持

除了自动驾驶场景,vid2vid还支持:

- 人脸视频合成 - 从边缘图生成逼真的人脸视频

- 人体动作生成 - 根据姿态信息合成人体运动视频

🎯 实际应用案例

自动驾驶算法验证

使用vid2vid可以生成大量虚拟测试场景,用于验证自动驾驶算法在不同路况下的表现:

- 极端天气测试 - 仿真雨雪天气对感知系统的影响

- 罕见场景仿真 - 创建现实中难以遇到的危险场景

- 传感器故障测试 - 仿真摄像头或激光雷达部分失效的情况

仿真环境构建

结合游戏引擎或仿真平台,vid2vid可以:

- 实时场景渲染 - 为仿真系统提供高质量的视觉输出

- 数据增强 - 为机器学习模型提供更多的训练样本

🔧 进阶配置技巧

内存优化配置

对于高分辨率视频生成,内存管理至关重要:

- 调整

max_frames_per_gpu参数控制单GPU处理的帧数 - 使用

sparse_D标志减少判别器的内存占用 - 采用

no_flow选项在静态背景场景中节省资源

性能调优建议

- 多GPU训练 - 充分利用多个GPU并行处理,显著提升训练速度

- 渐进式分辨率 - 从512x256开始训练,逐步提升到2048x1024

- 批次大小优化 - 根据GPU内存调整batchSize参数

📈 未来发展方向

vid2vid技术在自动驾驶领域的应用前景广阔:

- 实时视频转换 - 开发更轻量级的模型支持实时应用

- 多传感器融合 - 结合雷达、摄像头等多源数据进行更真实的场景重建

- 交互式场景编辑 - 允许用户实时编辑语义地图并立即看到效果

通过vid2vid技术,自动驾驶开发者可以低成本、高效率地创建大量测试场景,加速算法开发和验证过程,为更安全的自动驾驶系统奠定坚实基础。

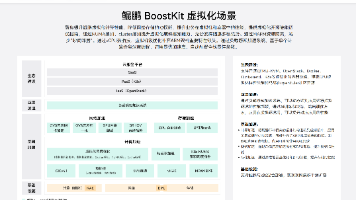

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

项目地址: https://gitcode.com/gh_mirrors/vi/vid2vid

项目地址: https://gitcode.com/gh_mirrors/vi/vid2vid

所有评论(0)