**标题:发散创新:探究TPU架构的深度解析**在现代计算领域,TPU(Tensor Processing Unit)架构以其高效

在现代计算领域,TPU(Tensor Processing Unit)架构以其高效能、高并行性和高集成度的特点,成为了人工智能领域中的新星。为了实现这一目标,TPU架构通常采用高度定制化的硬件设计,包括专门的计算单元、内存模块以及优化后的数据传输机制。未来,随着技术的不断进步和创新,TPU架构的性能和效率将得到进一步提升。TPU的出现,极大地推动了人工智能领域的发展,特别是在处理大规模数据集和高性

标题:发散创新:探究TPU架构的深度解析

在现代计算领域,TPU(Tensor Processing Unit)架构以其高效能、高并行性和高集成度的特点,成为了人工智能领域中的新星。本文将深入探讨TPU架构的设计原理、实现细节以及在实际应用中的优势。

一、TPU架构概述

TPU是一种专门为处理张量计算而设计的硬件架构,特别是在处理深度学习模型时表现出卓越的性能。TPU的出现,极大地推动了人工智能领域的发展,特别是在处理大规模数据集和高性能计算需求方面。

二、TPU架构的主要特点

- 高效能:TPU针对特定的计算任务进行了优化,能够实现更高的计算效率和更低的延迟。

-

- 高并行性:TPU架构支持高度并行的计算任务,能够同时处理多个数据流。

-

- 高集成度:TPU将计算单元与内存紧密集成,减少了数据传输的延迟。

三、TPU架构设计原理

- 高集成度:TPU将计算单元与内存紧密集成,减少了数据传输的延迟。

TPU架构设计主要围绕张量计算展开,其核心思想是将计算任务与内存紧密结合,减少数据传输延迟。为了实现这一目标,TPU架构通常采用高度定制化的硬件设计,包括专门的计算单元、内存模块以及优化后的数据传输机制。

四、TPU架构的实现细节

在TPU的实现过程中,关键的技术包括:

- 硬件设计优化:针对特定的计算任务进行硬件设计优化,提高计算效率。

-

- 内存优化技术:采用高速内存技术,减少数据传输延迟。

-

- 软件栈开发:开发高效的软件栈,支持各种深度学习框架的部署和运行。

五、TPU架构在实际应用中的优势

- 软件栈开发:开发高效的软件栈,支持各种深度学习框架的部署和运行。

TPU架构在实际应用中表现出了显著的优势,特别是在处理大规模数据集和高性能计算需求的场景下。例如,在云计算、边缘计算和自动驾驶等领域,TPU的应用极大地提高了计算效率和性能。

六、案例分析:TPU在云计算中的应用

以云计算为例,TPU的应用可以显著提高数据处理速度和性能。通过部署TPU集群,可以实现对大规模数据集的高效处理和分析,从而满足实时计算和数据分析的需求。此外,TPU的高集成度特点还可以降低数据传输延迟,提高整体性能。

七、总结与展望

本文深入探讨了TPU架构的设计原理、实现细节以及在实际应用中的优势。随着人工智能领域的不断发展,TPU架构将在更多领域得到广泛应用。未来,随着技术的不断进步和创新,TPU架构的性能和效率将得到进一步提升。

注:由于篇幅限制,本文仅提供了大致的框架和部分内容。在实际撰写时,需要补充详细的技术细节、实验数据和案例分析等。希望本文能为读者提供一个关于TPU架构的全面了解和研究基础。

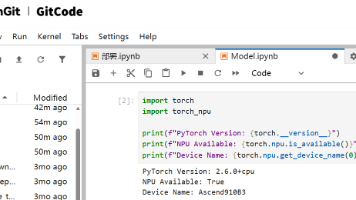

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)