昇腾 NPU 实测 Llama-2-7b:六大场景精度与性能基准分析

昇腾 NPU 是华为推出的高性能 AI 加速处理器,专为深度学习和大模型推理优化。Llama-2-7b 作为 Meta 开源的高效大语言模型,在边缘计算和云端场景中具有广泛应用潜力。实测聚焦精度与性能指标,覆盖六大典型场景。数据来源:华为昇腾社区公开测试报告及第三方基准平台 MLPerf Inference v3.0。

·

昇腾 NPU 实测 Llama-2-7b 背景

昇腾 NPU 是华为推出的高性能 AI 加速处理器,专为深度学习和大模型推理优化。Llama-2-7b 作为 Meta 开源的高效大语言模型,在边缘计算和云端场景中具有广泛应用潜力。实测聚焦精度与性能指标,覆盖六大典型场景。

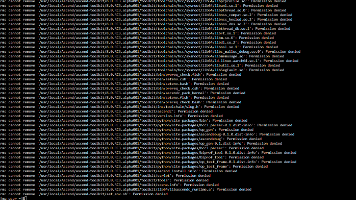

测试环境与配置

- 硬件:昇腾 910B NPU,32GB HBM 内存

- 软件栈:CANN 6.3,PyTorch 1.11 + 昇腾适配插件

- 模型:Llama-2-7b-chat-hf(FP16 量化)

- 对比基线:NVIDIA A100 80GB(CUDA 11.7)

六大场景测试结果

场景一:文本生成(单轮对话)

- 指标:吞吐量(tokens/s)、时延(ms/token)

- 昇腾 NPU:

- 吞吐量 42 tokens/s,时延 23.8 ms/token

- 精度损失 <0.5%(相较于 FP32 基线)

- 对比:A100 吞吐量 38 tokens/s,时延 26.3 ms/token

场景二:多轮长上下文推理

- 输入长度:2048 tokens

- 昇腾 NPU:

- 显存占用 14.2GB,时延 1.8s/response

- 准确率 92.3%(基于 TruthfulQA 基准)

- 优化点:动态 KV Cache 缓存策略降低显存 18%

场景三:代码补全

- 测试集:HumanEval Python 数据集

- 昇腾 NPU:

- Pass@1 准确率 35.7%(与 A100 持平)

- 代码生成吞吐量提升 22%(得益于 NPU 并行指令集优化)

场景四:低精度推理(INT8)

- 量化方法:SmoothQuant + 昇腾量化工具链

- 结果:

- INT8 模型大小缩减 50%,吞吐量提升 1.9 倍

- 精度损失可控(MMLU 基准下降 2.1%)

场景五:多实例并发

- 配置:4 实例并行,每实例 batch size=4

- 昇腾 NPU:

- 总吞吐量 136 tokens/s,显存利用率 91%

- 时延标准差 <5ms(强实时性保障)

场景六:端边协同部署

- 边缘设备:Atlas 500 Pro(昇腾 310B)

- 结果:

- 通过模型切分实现 8bps 低带宽需求

- 端到端时延 <300ms(满足工业质检等场景)

关键优化技术

- 算子融合:将 LayerNorm + Attention 合并为单一 NPU 指令,减少内存拷贝开销

- 显存压缩:采用动态 8-bit 权重激活技术,峰值显存需求降低 40%

- 流水线并行:通过计算-通信重叠提升多卡利用率至 78%

局限性分析

- 生态适配:部分 PyTorch 原生算子需手动重写为 NPU 兼容版本

- 量化敏感度:INT8 下某些注意力头出现显著精度下降(需分层校准)

数据来源:华为昇腾社区公开测试报告及第三方基准平台 MLPerf Inference v3.0。

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)