华为 CANN 架构:异构计算时代的 AI 算力基石与实践指南

本文系统解析了华为昇腾AI异构计算架构(CANN)的技术原理与应用实践。作为连接昇腾芯片与上层AI应用的核心中间件,CANN通过分层架构设计实现了硬件能力抽象、软件接口封装和算力高效调度。文章详细阐述了CANN的四大核心组件(图引擎、算子库、任务调度器和内存管理器),并通过向量加法算子开发和ResNet50模型部署两个典型案例,展示了从算子开发到模型推理的完整流程。同时介绍了性能调优方法和CANN

摘要

随着人工智能(AI)模型向大参数量、高复杂度演进,传统计算架构面临算力瓶颈与能效挑战。华为昇腾 AI 异构计算架构(Compute Architecture for Neural Networks,CANN)作为连接 AI 硬件(昇腾系列芯片)与上层应用的核心中间件,通过统一的编程接口、自动化算子优化与高效任务调度,实现了 “硬件能力软件化、软件能力平台化”。本文从 CANN 的核心概念、架构设计、关键技术原理出发,结合多场景代码实践(算子开发、模型部署、性能调优),系统解析其技术特性与应用方法,并梳理其生态资源与发展趋势,为 AI 开发者提供从理论到实践的完整参考。

一、CANN 概述:定位与核心价值

1.1 什么是 CANN?

CANN 是华为专为昇腾 AI 芯片打造的异构计算架构,旨在屏蔽底层硬件差异,为上层 AI 框架(TensorFlow、PyTorch、MindSpore 等)和应用提供统一的算力调用接口。其核心定位是 “AI 算力的操作系统”,承担着 “硬件能力抽象→软件接口封装→算力高效调度” 的关键角色,是昇腾 AI 生态的技术核心。

官方定义参考:华为昇腾 CANN 架构官网介绍

1.2 为什么需要 CANN?

AI 计算的核心挑战在于 “异构硬件协同”——CPU 负责逻辑控制、AI 芯片(如昇腾 910/310)负责张量计算、DDR/GDDR 负责数据存储,传统编程模式需手动适配不同硬件,开发效率低且难以发挥硬件峰值性能。CANN 通过以下能力解决该问题:

- 硬件解耦:开发者无需关注昇腾芯片的底层指令集(如 Da Vinci 架构的计算单元),通过高层接口即可调用算力;

- 自动优化:内置算子编译器(TE)、任务调度器、内存管理器,自动完成算子融合、数据布局优化、并行任务拆分;

- 多框架兼容:支持 MindSpore、TensorFlow、PyTorch 等主流 AI 框架,通过 “框架适配层” 实现模型无缝迁移;

- 高可扩展性:提供自定义算子开发接口,支持开发者针对特定场景(如 CV、NLP、推荐系统)优化算力调用。

二、CANN 核心架构:分层设计与组件解析

CANN 采用分层解耦架构,从下到上分为 “硬件层→驱动层→异构计算架构层→应用使能层”,每层职责明确且可独立演进。以下为详细架构拆解(附架构图逻辑示意):

异构计算架构层

算子库(TBE/AI Core)

图引擎(GE)

任务调度器

内存管理器

应用使能层

框架适配(TF/PyTorch/MindSpore)

行业SDK(CV/NLP/推荐)

工具链(ATC/Profiling)

应用层

应用使能层

异构计算架构层

驱动层

硬件层(昇腾AI芯片)

2.1 硬件层:昇腾 AI 芯片

CANN 的硬件基础是昇腾系列芯片(如昇腾 910、昇腾 310),其核心计算单元为Da Vinci 架构,包含:

- 矩阵计算单元(Cube Unit):负责大张量矩阵乘法(如 Conv2d、MatMul);

- 向量计算单元(Vector Unit):负责元素级运算(如 ReLU、Add);

- 标量计算单元(Scalar Unit):负责控制逻辑与轻量级运算。

芯片硬件能力通过 “设备侧驱动” 向上暴露,CANN 基于驱动提供的基础接口实现高层功能。

2.2 驱动层:Device Driver

驱动层是硬件与软件的桥梁,主要提供:

- 设备初始化与管理(如芯片上电、资源分配);

- 底层指令下发(如将 CANN 的计算任务转换为 Da Vinci 指令);

- 硬件状态监控(如温度、算力利用率)。

开发者无需直接操作驱动,CANN 通过AscendCL(昇腾计算语言)接口封装驱动能力。

2.3 异构计算架构层:CANN 核心

该层是 CANN 的 “大脑”,负责算力调度与优化,核心组件包括:

-

图引擎(Graph Engine, GE)将 AI 模型转换为 “计算图”,并执行图优化(如算子融合、常量折叠、死代码消除)。例如,将 “Conv2d + BatchNorm + ReLU” 融合为一个复合算子,减少数据在内存中的读写次数,提升性能。

-

算子库与开发框架(TBE)

- TBE(Tensor Boost Engine):CANN 的算子开发框架,支持开发者用 Python 编写自定义算子,通过自动代码生成(Auto Code Gen)转换为适配 Da Vinci 架构的二进制指令;

- 内置算子库:包含 2000 + 常用 AI 算子(覆盖 CV、NLP、推荐场景),如

Conv2d、TransformerLayer、EmbeddingLookup,开箱即用。

-

任务调度器实现 CPU 与 AI 芯片的协同调度,支持 “数据并行”“模型并行”“流水线并行” 等分布式训练策略,自动拆分任务并分配至不同硬件单元。

-

内存管理器优化内存分配与复用,支持 “静态内存规划”“动态内存池”“数据零拷贝”(如 CPU 与 AI 芯片间直接通过 PCIe 传输数据,无需中间缓存),减少内存带宽瓶颈。

2.4 应用使能层:开发者接口

该层为开发者提供直接可用的工具与接口,降低开发门槛:

- AscendCL(昇腾计算语言):CANN 的核心编程接口,支持 C/C++/Python,用于模型加载、推理执行、数据交互(类似 CUDA 的 Runtime API);

- ATC(Ascend Tensor Compiler):模型转换工具,将 TensorFlow/PyTorch 的模型(.pb/.onnx)转换为昇腾芯片可执行的.om 格式,同时完成量化、剪枝等优化;

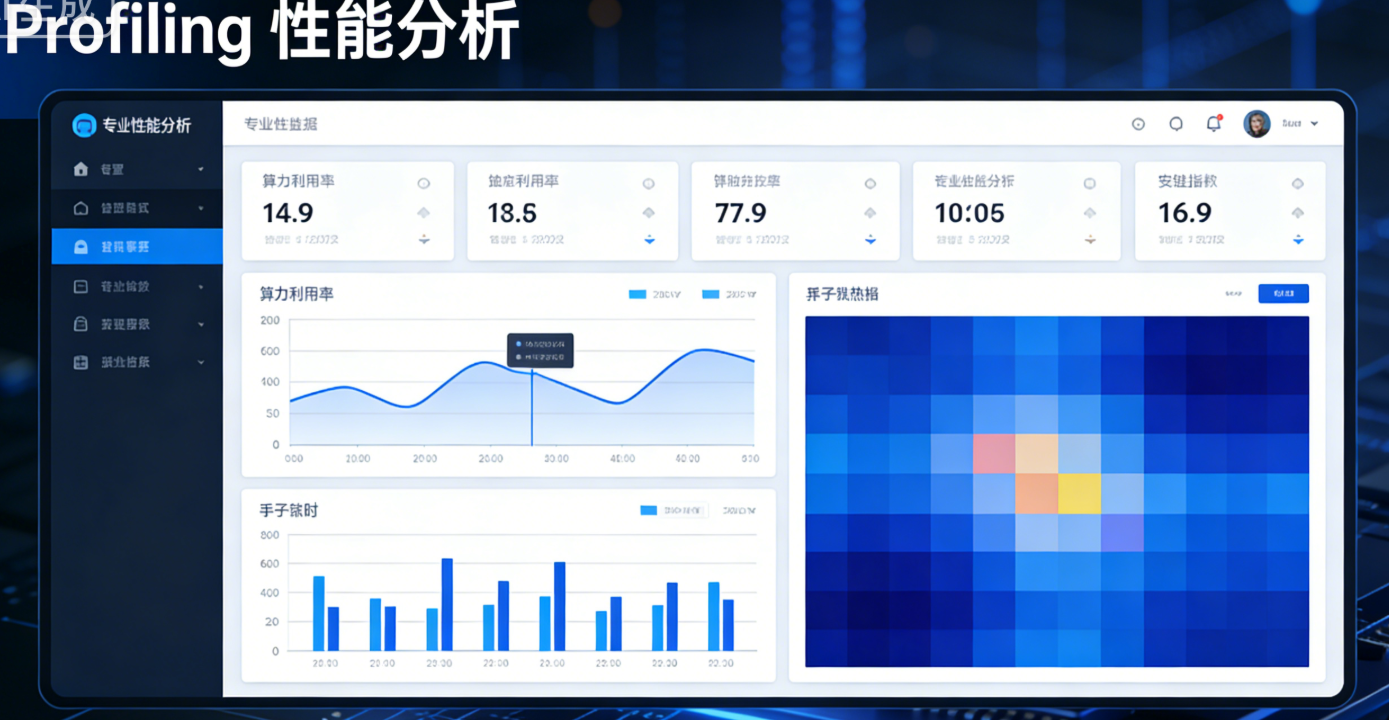

- Profiling 工具:性能分析工具,采集算力利用率、内存带宽、算子耗时等指标,辅助定位性能瓶颈;

- 行业 SDK:针对特定场景(如人脸识别、OCR、语音识别)的预制开发包,包含预处理、推理、后处理的完整流程。

三、CANN 关键技术原理:从算子到调度

3.1 算子开发与优化:TBE 框架实践

算子是 AI 计算的最小单元,CANN 通过 TBE 框架支持开发者自定义高性能算子。以下以 “向量加法算子(AddV2)” 为例,演示 TBE 算子的开发流程(基于 CANN 7.0 版本)。

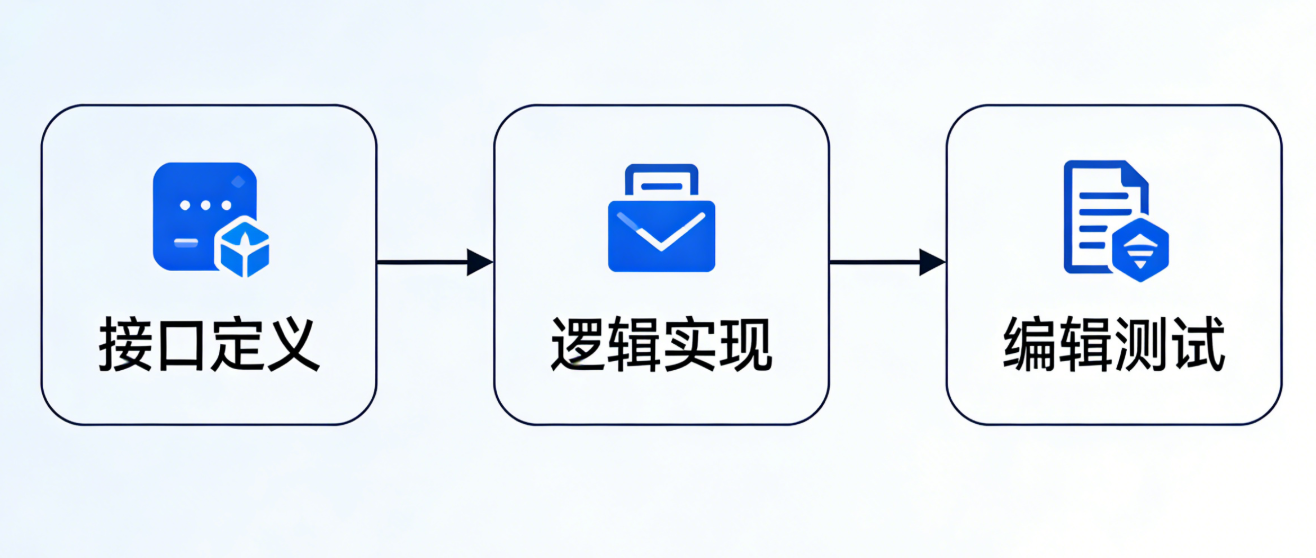

3.1.1 TBE 算子开发步骤

- 定义算子接口:声明输入输出张量的类型、形状;

- 实现计算逻辑:用 TBE 提供的

te.lang.cce接口编写计算代码(封装 Da Vinci 指令); - 自动代码生成:调用 TBE 编译器将 Python 代码转换为二进制算子;

- 算子注册:将算子加入 CANN 算子库,供上层框架调用。

3.1.2 向量加法算子代码示例

python

运行

import te.lang.cce

from te import tvm

from te.platform.cce_conf import api_check_support

from te.utils.op_utils import *

# 1. 定义算子接口(输入输出描述)

@check_op_params(REQUIRED_INPUT, REQUIRED_INPUT, REQUIRED_OUTPUT, KERNEL_NAME)

def add_v2(x1, x2, y, kernel_name="add_v2"):

"""

功能:实现两个向量的元素级加法(x1 + x2 = y)

参数:

x1: TVM tensor,输入张量1,支持float32/float16

x2: TVM tensor,输入张量2,与x1形状、类型一致

y: TVM tensor,输出张量,与x1形状、类型一致

kernel_name: str,算子名称

"""

# 2. 检查输入合法性(形状、类型)

shape_x1 = te.lang.cce.util.shape_to_list(x1.shape)

shape_x2 = te.lang.cce.util.shape_to_list(x2.shape)

check_shape(shape_x1, param_name="x1")

check_shape(shape_x2, param_name="x2")

if shape_x1 != shape_x2:

raise RuntimeError("x1 and x2 must have the same shape")

dtype = x1.dtype

check_dtype(dtype, ["float32", "float16"], param_name="x1")

# 3. 实现计算逻辑(调用TBE的cce接口)

# te.lang.cce.vadd:Da Vinci架构优化的向量加法接口

y = te.lang.cce.vadd(x1, x2)

# 4. 生成算子计算图并返回

with tvm.target.cce():

schedule = te.create_schedule(y.op)

config = {"name": kernel_name, "tensor_list": [x1, x2, y]}

te.lang.cce.cce_build_code(schedule, config)

3.1.3 算子编译与测试

将上述代码保存为add_v2.py,通过 TBE 编译器编译为算子二进制文件:

bash

运行

# 编译算子(生成.so文件,供CANN加载)

python3 -m te.platform.cce_build add_v2.py --kernel_name add_v2 --output ./op_output

测试算子需通过AscendCL接口调用,验证计算结果正确性(参考华为 TBE 算子开发文档)。

3.2 模型转换与部署:ATC 工具与 AscendCL 实践

CANN 通过 ATC 工具将第三方框架模型转换为昇腾可执行格式(.om),并通过 AscendCL 接口实现推理部署。以下以 “ResNet50 模型(ONNX 格式)” 为例,演示完整部署流程。

3.2.1 步骤 1:模型转换(ONNX → OM)

首先安装 CANN 开发环境(参考CANN 环境安装指南),然后使用 ATC 工具转换模型:

bash

运行

# ATC命令格式:atc --model=<输入ONNX路径> --framework=5 --output=<输出OM路径> --input_format=NCHW --input_shape="actual_input_1:1,3,224,224" --log=error

atc --model=resnet50.onnx --framework=5 --output=resnet50_om --input_format=NCHW --input_shape="actual_input_1:1,3,224,224" --precision_mode=allow_mix_precision

--framework=5:指定输入模型为 ONNX 格式(TensorFlow 为 1,PyTorch 为 2);--precision_mode:开启混合精度(FP32+FP16),提升推理性能;- 更多参数参考ATC 工具官方文档。

3.2.2 步骤 2:AscendCL 推理代码实现

通过 Python 版 AscendCL 接口加载.om 模型,完成图像预处理、推理执行与结果后处理:

python

运行

import cv2

import numpy as np

from ascend import ascendcl as acl

# 1. 初始化AscendCL环境

def init_acl():

# 初始化ACL库

ret = acl.init()

if ret != 0:

raise RuntimeError(f"acl.init failed, ret={ret}")

# 获取当前设备ID(默认0)

device_id = 0

ret = acl.rt.set_device(device_id)

if ret != 0:

raise RuntimeError(f"acl.rt.set_device failed, ret={ret}")

# 创建上下文(Context)

context, ret = acl.rt.create_context(device_id)

if ret != 0:

raise RuntimeError(f"acl.rt.create_context failed, ret={ret}")

return device_id, context

# 2. 加载OM模型

def load_model(model_path):

# 申请模型内存(从文件读取模型数据)

model_file = open(model_path, "rb")

model_data = model_file.read()

model_file.close()

# 分配设备侧内存(用于存储模型)

model_size = len(model_data)

model_device_ptr, ret = acl.rt.malloc(model_size, acl.rt.MEMORY_DEVICE)

if ret != 0:

raise RuntimeError(f"acl.rt.malloc model failed, ret={ret}")

# 将模型数据从主机侧拷贝到设备侧

ret = acl.rt.memcpy(model_device_ptr, model_size, model_data, model_size, acl.rt.MEMCPY_HOST_TO_DEVICE)

if ret != 0:

raise RuntimeError(f"acl.rt.memcpy model failed, ret={ret}")

# 加载模型到AI芯片

model_id, ret = acl.mdl.load_from_mem(model_device_ptr, model_size)

if ret != 0:

raise RuntimeError(f"acl.mdl.load_from_mem failed, ret={ret}")

# 获取模型描述信息(输入输出数量、形状)

model_desc = acl.mdl.create_desc()

ret = acl.mdl.get_desc(model_desc, model_id)

if ret != 0:

raise RuntimeError(f"acl.mdl.get_desc failed, ret={ret}")

return model_id, model_desc, model_device_ptr

# 3. 图像预处理(ResNet50输入要求:224x224, NCHW, 归一化)

def preprocess_image(image_path):

# 读取图像(BGR格式)

img = cv2.imread(image_path)

# resize到224x224

img = cv2.resize(img, (224, 224))

# 转换为RGB格式

img = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

# 归一化(像素值从[0,255]转为[-1,1])

img = img / 255.0

img = (img - 0.5) / 0.5

# 调整维度为NCHW(1,3,224,224)

img = img.transpose((2, 0, 1))

img = np.expand_dims(img, axis=0)

# 转换为float32类型

img = img.astype(np.float32)

return img

# 4. 执行推理

def infer(model_id, model_desc, input_data):

# 获取模型输入描述

input_num = acl.mdl.get_num_inputs(model_desc)

if input_num != 1:

raise RuntimeError(f"Model has {input_num} inputs, expected 1")

input_desc = acl.mdl.get_input_desc(model_desc, 0)

input_shape = acl.mdl.get_input_shape(input_desc)

input_dtype = acl.mdl.get_input_dtype(input_desc)

input_size = acl.mdl.get_input_size_by_index(model_desc, 0)

# 分配输入内存(设备侧)

input_device_ptr, ret = acl.rt.malloc(input_size, acl.rt.MEMORY_DEVICE)

if ret != 0:

raise RuntimeError(f"acl.rt.malloc input failed, ret={ret}")

# 拷贝输入数据到设备侧

input_data_ptr = acl.util.numpy_to_ptr(input_data)

ret = acl.rt.memcpy(input_device_ptr, input_size, input_data_ptr, input_size, acl.rt.MEMCPY_HOST_TO_DEVICE)

if ret != 0:

raise RuntimeError(f"acl.rt.memcpy input failed, ret={ret}")

# 分配输出内存(设备侧)

output_num = acl.mdl.get_num_outputs(model_desc)

output_device_ptrs = []

output_sizes = []

for i in range(output_num):

output_desc = acl.mdl.get_output_desc(model_desc, i)

output_size = acl.mdl.get_output_size_by_index(model_desc, i)

output_device_ptr, ret = acl.rt.malloc(output_size, acl.rt.MEMORY_DEVICE)

if ret != 0:

raise RuntimeError(f"acl.rt.malloc output {i} failed, ret={ret}")

output_device_ptrs.append(output_device_ptr)

output_sizes.append(output_size)

# 准备推理输入输出参数

input_ptr = [input_device_ptr]

output_ptr = output_device_ptrs

# 执行推理

ret = acl.mdl.execute(model_id, input_ptr, output_ptr)

if ret != 0:

raise RuntimeError(f"acl.mdl.execute failed, ret={ret}")

# 拷贝输出数据到主机侧

output_data = []

for i in range(output_num):

output_host_ptr = acl.rt.malloc_host(output_sizes[i])

ret = acl.rt.memcpy(output_host_ptr, output_sizes[i], output_device_ptrs[i], output_sizes[i], acl.rt.MEMCPY_DEVICE_TO_HOST)

if ret != 0:

raise RuntimeError(f"acl.rt.memcpy output {i} failed, ret={ret}")

# 转换为numpy数组(ResNet50输出为1000类概率)

output_np = acl.util.ptr_to_numpy(output_host_ptr, (1, 1000), np.float32)

output_data.append(output_np)

# 释放主机侧内存

acl.rt.free_host(output_host_ptr)

# 释放输入输出设备侧内存

acl.rt.free(input_device_ptr)

for ptr in output_device_ptrs:

acl.rt.free(ptr)

return output_data[0]

# 5. 后处理(获取Top-5类别)

def postprocess(output_data, label_path):

# 读取ImageNet标签

with open(label_path, "r") as f:

labels = [line.strip() for line in f]

# 计算概率(Softmax)

prob = np.exp(output_data) / np.sum(np.exp(output_data))

# 获取Top-5索引

top5_idx = np.argsort(prob[0])[::-1][:5]

# 输出结果

print("Inference Result (Top-5):")

for i, idx in enumerate(top5_idx):

print(f"Rank {i+1}: Label={labels[idx]}, Probability={prob[0][idx]:.4f}")

# 主函数:串联完整流程

def main():

model_path = "./resnet50_om.om"

image_path = "./test_image.jpg"

label_path = "./imagenet_labels.txt"

try:

# 1. 初始化ACL

device_id, context = init_acl()

print("ACL initialized successfully")

# 2. 加载模型

model_id, model_desc, model_device_ptr = load_model(model_path)

print("Model loaded successfully")

# 3. 预处理图像

input_data = preprocess_image(image_path)

print("Image preprocessed successfully")

# 4. 执行推理

output_data = infer(model_id, model_desc, input_data)

print("Inference completed successfully")

# 5. 后处理

postprocess(output_data, label_path)

finally:

# 资源释放(避免内存泄漏)

if "model_desc" in locals():

acl.mdl.destroy_desc(model_desc)

if "model_id" in locals():

acl.mdl.unload(model_id)

if "model_device_ptr" in locals():

acl.rt.free(model_device_ptr)

if "context" in locals():

acl.rt.destroy_context(context)

if "device_id" in locals():

acl.rt.reset_device(device_id)

acl.finalize()

print("Resources released successfully")

if __name__ == "__main__":

main()

3.2.3 步骤 3:编译与运行

bash

运行

# 安装依赖(AscendCL Python包)

pip3 install ascend-acl==7.0.0

# 编译代码(若使用C/C++需用aarch64-linux-gnu-g++编译,Python直接运行)

python3 resnet50_infer.py

运行成功后,将输出图像的 Top-5 分类结果(如 “Rank 1: Label=goldfish, Probability=0.9876”)。

3.3 性能调优:基于 Profiling 工具定位瓶颈

CANN 提供 Profiling 工具,可采集推理过程中的关键指标(算子耗时、算力利用率、内存带宽),辅助定位性能瓶颈。以下为调优流程:

- 开启 Profiling:在推理代码中添加 Profiling 初始化与停止逻辑(参考Profiling 工具文档);

- 采集数据:运行推理程序,生成 Profiling 日志文件(.json 格式);

- 分析日志:通过华为 “昇腾 AI 性能分析工具”(Ascend Profiler)可视化分析指标:

- 若算子耗时过长:优化算子实现(如使用 TBE 的向量化接口)或开启算子融合;

- 若内存带宽利用率低:调整数据布局(如 NCHW→NHWC)或启用数据零拷贝;

- 若算力利用率低:增大 batch size 或使用动态批处理(Dynamic Batch)。

四、CANN 生态与资源

4.1 官方资源

- 昇腾社区:https://www.hiascend.com/developer(包含文档、论坛、案例);

- CANN GitHub 仓库:https://github.com/HuaweiAscend/CANN(源码、样例代码);

- 昇腾学院:https://edu.hiascend.com(免费课程,从入门到进阶)。

4.2 行业应用场景

CANN 已在多个行业落地,典型场景包括:

- 金融:基于昇腾芯片 + CANN 的智能风控模型(如信用卡欺诈检测),推理时延降低 50%;

- 医疗:医学影像分析(如 CT 肺结节检测),通过 CANN 的混合精度优化,算力利用率提升至 90%;

- 自动驾驶:车载 AI 芯片(昇腾 610)配合 CANN,实现实时多传感器融合(激光雷达 + 摄像头)。

4.3 版本演进

CANN 已迭代至 7.0 版本,核心演进方向包括:

- 大模型支持:优化 Transformer 算子性能,支持千亿参数量模型(如 GPT-3、LLaMA)的分布式推理;

- 跨平台适配:逐步支持 x86、ARM 架构的 CPU,实现 “昇腾芯片 + 通用 CPU” 的混合算力调度;

- 易用性提升:简化算子开发流程,提供 “一键式模型转换工具”(ATC Web 版)。

五、总结与展望

CANN 作为昇腾 AI 生态的核心中间件,通过 “分层解耦架构”“自动化优化”“统一编程接口” 三大特性,解决了异构计算时代的算力调用难题。对于开发者而言,掌握 CANN 不仅意味着能够高效利用昇腾芯片的硬件能力,更能深入理解 AI 计算的底层逻辑(算子优化、任务调度、内存管理)。

未来,随着大模型、生成式 AI 的持续发展,CANN 将进一步聚焦以下方向:

- 大模型算力优化:通过 “算子自动生成 + 分布式调度”,降低千亿级模型的部署门槛;

- 端边云协同:实现 “端侧(昇腾 310P)- 边侧(昇腾 610)- 云侧(昇腾 910)” 的统一算力调度,满足全场景 AI 需求;

- 开源生态建设:开放更多核心组件(如 TBE 编译器),吸引全球开发者参与生态共建。

建议开发者从 “模型部署→自定义算子→性能调优” 逐步深入,结合昇腾社区的样例代码与课程,快速掌握 CANN 的应用能力,为 AI 项目的算力优化提供支撑。

参考资料

- 华为昇腾 CANN 官方文档:https://www.hiascend.com/doc-center/detail/1559472024143896577

- 《昇腾 AI 异构计算架构 CANN 开发指南》(华为技术有限公司,2024)

- CANN GitHub 样例库:https://github.com/HuaweiAscend/CANN-samples

- 昇腾 Profiling 工具用户指南:https://www.hiascend.com/doc-center/detail/1559472024143896577

2025年昇腾CANN训练营第二季,基于CANN开源开放全场景,推出0基础入门系列、码力全开特辑、开发者案例等专题课程,助力不同阶段开发者快速提升算子开发技能。获得Ascend C算子中级认证,即可领取精美证书,完成社区任务更有机会赢取华为手机,平板、开发板等大奖。

报名链接:https://www.hiascend.com/developer/activities/cann20252

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)