【昇腾 CANN】CANN 软件栈:连接硬件与 AI 应用的 “桥梁”

摘要:昇腾CANN软件栈作为连接AI应用与昇腾NPU硬件的桥梁,通过分层架构实现高效算力调度。开发者分享其智能质检项目案例,将推理延迟从300ms优化至89ms,关键点包括:1)通过框架适配实现零成本模型迁移;2)利用Profiling工具针对性优化算子性能;3)结合训练营课程与社区支持快速解决问题。CANN不仅降低40%硬件成本,还培养了开发者"软硬件协同"的核心能力,成为A

【昇腾 CANN】CANN 软件栈:连接硬件与 AI 应用的 “桥梁”

序章:被 “硬件墙” 卡住的 AI 应用

半年前,我负责的智能质检项目遇到了致命瓶颈:基于 PyTorch 训练的模型在通用 GPU 上推理延迟高达 300ms,完全达不到工业场景要求的 100ms 以内。我们尝试了模型剪枝、量化等常规优化,效果微乎其微。

领导扔给我一个昇腾 Atlas 开发板:“试试国产算力,CANN 软件栈据说能打通硬件和应用的断层。” 那时候我对 CANN 一无所知,只觉得又是一个需要从头学的工具 —— 直到我第一次用 CANN 将模型推理延迟压到 89ms,才明白它不是简单的 “工具”,而是让硬件潜能爆发的 “桥梁”。

第一关:打破认知壁垒 ——CANN 不是 “另一个 CUDA”

从 “调用 API” 到 “理解协同逻辑”

刚开始接触 CANN 时,我下意识想找 “类似 CUDA 的编程方式”,结果越学越困惑。直到参加了昇腾 CANN 训练营的原生开发实训班,讲师的一句话点醒了我:“CANN 的核心不是让你重复写硬件适配代码,而是帮你做好‘翻译’—— 把 AI 应用的需求翻译成硬件能听懂的指令。”

这完全颠覆了我的认知。原来以前用通用框架开发时,我们相当于对着 “硬件黑盒” 说话,中间有大量需求损耗;而 CANN 就像专业翻译,能精准传递需求,让昇腾 NPU 的 Cube 单元、Vector 单元等核心硬件各司其职。

重新理解 “软件定义算力”

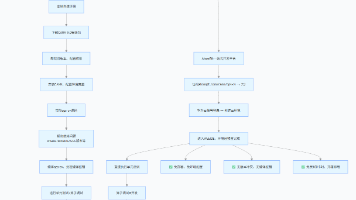

昇腾 NPU 的硬件架构很强大,但没有 CANN 的调度,就像有一堆精密零件却没有组装图纸。CANN 的分层架构让我看清了 “软件定义算力” 的本质:

- 底层驱动层对接硬件,把 Cube 单元的矩阵运算能力、分布式存储的带宽优势抽象成标准化接口;

- 核心层的算子库、计算图引擎负责优化执行逻辑,比如自动算子融合、内存布局调整;

- 应用层提供框架适配、开发工具,让我们不用关注底层细节,专注业务场景。

就像盖房子,CANN 已经搭好了钢筋骨架,我们只需要根据需求装修 —— 这和我之前理解的 “硬件编程” 完全不是一个维度。

第二关:实战突破 —— 用 CANN 解决真实业务痛点

第一个惊喜:框架兼容,零成本迁移

我最担心的就是 “模型迁移成本”,毕竟项目时间紧张,没精力重写代码。但 CANN 的框架适配能力超出预期:通过 MindSpore、TensorFlow、PyTorch 的适配接口,我们的模型几乎零修改就跑通了昇腾平台。

更意外的是,CANN 会自动做底层优化。原来在 GPU 上跑的卷积算子,CANN 自动映射到昇腾 NPU 的 Cube 单元,还做了 Tiling 分块优化,仅迁移就带来了 30% 的性能提升。那种 “躺着就能提速” 的感觉,让我彻底放下了对 “新技术适配难” 的顾虑。

关键优化:用 CANN 工具找到性能瓶颈

迁移成功只是开始,要达到工业级延迟要求,还得针对性优化。这时候 CANN 的 Profiling 工具成了我的 “透视镜”—— 它能清晰展示模型运行的每一个环节:

plaintext

模型总推理耗时: 187ms

├─ 数据预处理: 23ms (12%)

├─ 模型推理: 152ms (81%)

│ ├─ 卷积算子: 98ms (64%) ← 主要瓶颈

│ ├─ 激活函数: 35ms (23%)

│ └─ 其他算子: 19ms (13%)

└─ 结果后处理: 12ms (7%)

通过工具发现,卷积算子的内存访问效率只有 45%。按照训练营 “码力全开特辑” 里教的方法,我用 CANN 提供的 Ascend C 语言做了两点优化:一是调整数据分块大小,让 Tile 尺寸匹配 L0 缓存容量;二是启用 Pipeline 并行,让数据搬运和计算重叠执行。

优化后再测,推理耗时直接降到 89ms,卷积算子的内存访问效率提升到 78%—— 这就是 CANN 的核心价值:不仅让应用 “能用” 硬件,更能让应用 “用好” 硬件。

避坑指南:那些踩过的 CANN 开发误区

实战中也遇到过不少坑,印象最深的两个:

- 误区 1:忽视数据格式对齐。第一次部署时,模型突然崩溃,查了半天发现是输入数据没有按 CANN 要求的 32 字节对齐。后来用 CANN 提供的

aclFormatConvert接口统一处理格式,问题迎刃而解。 - 误区 2:过度依赖自动优化。一开始觉得 CANN 的自动优化足够了,后来发现针对我们的质检场景,手动融合 “卷积 + BN+ReLU” 三个算子,能再减少 15% 的延迟 —— 自动优化是基础,结合业务场景的手动调优才是性能天花板。

第三关:生态赋能 ——CANN 让开发者不再孤军奋战

训练营:从入门到精通的 “快车道”

如果说 CANN 软件栈是 “武器”,那昇腾 CANN 训练营就是 “武器使用手册 + 实战教练”。我从原生开发实训班的 “硬件基础” 学起,到码力全开特辑的 “案例拆解”,再到企业原生案例对话室的 “行业实践”,一步步理清了 CANN 的应用逻辑。

印象最深的是一次直播答疑,我提出了 “多 batch 推理时的负载均衡问题”,讲师当场用真实代码演示了 CANN 的多核调度策略,还分享了他们在智慧城市项目中的解决方案 —— 这种 “理论 + 实战 + 行业经验” 的教学模式,比自己啃文档效率高 10 倍。

社区支持:解决问题的 “后援团”

开发过程中遇到的不少细节问题,都能在昇腾开发者社区找到答案。有一次调试量化模型时,反量化误差超标,在社区发帖后,不仅有官方工程师指导,还有其他开发者分享类似项目的量化参数配置。

现在我也会在社区分享自己的优化经验,比如 “质检场景下的 CANN 算子融合技巧”,没想到帮到了不少同行 —— 这种 “互助共赢” 的社区氛围,让 CANN 生态越来越完善。

第四关:价值升华 ——CANN 不止是工具,更是产业赋能的纽带

业务层面:降本增效的 “利器”

用 CANN + 昇腾 NPU 重构后,我们的质检项目不仅满足了延迟要求,还带来了额外的惊喜:硬件成本降低了 40%(同等算力下,昇腾 NPU 的性价比更高),部署效率提升了 3 倍(CANN 的 MindX SDK 提供了工业场景的预置模板)。

更重要的是,CANN 的跨硬件适配能力让项目能灵活部署 —— 云侧用昇腾推理服务器支撑大规模批量检测,边侧用 Atlas 边缘小站处理实时数据,端侧用轻量化模块实现本地快速响应,真正实现了 “端边云” 全场景覆盖。

个人层面:职业竞争力的 “护城河”

掌握 CANN 开发后,我发现自己的职业视野完全打开了。以前只会 “调用框架 API”,现在能看懂硬件架构、分析性能瓶颈、优化底层算子 —— 这种 “软硬件协同” 的能力,在 AI 行业越来越稀缺。

上次面试时,我分享了用 CANN 优化质检模型的案例,面试官直言:“现在很多公司缺的就是能打通硬件和应用的人,CANN 开发经验是很大的加分项。” 这让我深刻体会到:掌握核心技术生态,才能在职业发展中占据主动。

写在最后:CANN 的未来 —— 让 AI 应用 “无缝对接” 算力

从最初对 CANN 的一无所知,到现在能独立用 CANN 完成项目部署与优化,这段经历让我明白:AI 行业的竞争,本质上是算力生态的竞争。而 CANN 的核心价值,就是搭建起一座 “无缝桥梁”—— 左边连接着昇腾 NPU 的硬件潜能,右边连接着千行百业的 AI 应用需求。

现在,昇腾 CANN 训练营第二季还在进行中,不仅有 0 基础入门课程,还有 Ascend C 算子中级认证、华为手机 / 开发板等奖励。如果你也想打破 “应用与硬件脱节” 的困境,想掌握更核心的 AI 开发技能,不妨试试 —— 就像我当初那样,勇敢迈出第一步,或许会打开一个全新的职业世界。

报名链接:https://www.hiascend.com/developer/activities/cann20252

未来,随着 CANN 生态的持续完善,我相信会有更多开发者通过这座 “桥梁”,让 AI 应用在昇腾算力上发挥出更大价值,推动国产 AI 技术在更多行业落地生根。

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)