华为AI全栈深度解析:CANN自定义算子开发与全场景落地实战

1. 工程目录结构2. 关键配置文件(CMakeLists.txt)3. 工程构建与编译命令自定义算子工程结构示意图(注:高清展示目录层级与文件关联关系)Ascend C算子开发是昇腾AI生态应用落地的核心环节,本文从Tiling计算优化、调试技巧、交付规范、工程搭建到调用执行,构建了完整的技术体系。开发者可结合昇腾CANN训练营提供的实战案例与社区任务(如Erf、LogsoftmaxV2等算子开

引言

在AI技术规模化落地的浪潮中,单一硬件或软件层面的优化已难以满足产业对算力效率、开发效率、场景适配性的三重诉求。华为AI全栈解决方案以“四层架构+端边云协同”为核心,构建了从芯片算力底座到应用使能的完整技术闭环,而CANN(神经网络计算架构)作为连接硬件与上层框架的关键枢纽,其自定义算子开发能力直接决定了芯片算力的释放效率与场景适配灵活性。本文基于华为AI全栈技术体系的底层逻辑,聚焦CANN自定义算子开发全流程,以ReLU激活函数算子为例,结合极简代码示例,从技术原理、硬件适配、开发实现、优化部署到全场景落地,进行全方位、深层次的拆解,助力开发者掌握高性能算子设计的核心技巧。

一、华为AI全栈:四层架构的技术逻辑与协同机制

华为AI全栈的核心创新在于“分层解耦+标准化协同”,通过芯片层、CANN层、AI框架层、应用使能层的深度联动,实现终端、边缘、云全场景的算力统一调度与高效适配,彻底解决传统AI技术“硬件碎片化、开发复杂化、部署困难化”的行业痛点。

1. 芯片层:场景化算力的硬件底座

芯片层基于统一可扩展架构(UArch) ,打造了覆盖不同算力等级的系列化AI芯片,避免多架构带来的重复适配成本,实现“算力按需分配”:

- 终端芯片(Nano/Tiny/Lite/Mini系列):算力范围20 MOPS~20 TOPS,功耗1mW~10W,适配耳机语音唤醒、手机AI拍照、智能手表健康监测等轻量场景。核心设计诉求是“低功耗+小算力+高集成度”,通过精简计算单元、优化存储层级,在有限功耗下实现核心AI功能;

- 边缘芯片(Mini/Multi-Mini系列):算力范围10~100 TOPS,功耗3~100W,适配自动驾驶感知、工业产线实时质检、边缘网关智能分析等场景。核心诉求是“低时延+中等算力+高可靠性”,支持本地数据处理,避免云端传输延迟,同时具备抗恶劣环境、长时间稳定运行的能力;

- 云芯片(Ascend Max系列):算力200+ TOPS,功耗200W+,适配大模型训练/推理、大规模AI任务调度、云端智能服务等场景。核心诉求是“高算力+高吞吐+高扩展性”,通过多AI Core集群、高速互联总线,支撑千亿参数大模型的高效训练与推理。

2. CANN层:算力转化的效率枢纽

CANN是芯片层与AI框架层之间的“翻译器”与“优化器”,核心解决“硬件算力如何被上层高效调用”的问题,其核心能力体现在三方面:

- 预置算子库:封装矩阵运算、卷积、激活函数、注意力机制等常用算子,覆盖90%以上AI任务,这些算子经过华为官方深度优化,直接调用即可获得芯片级最优性能;

- 自定义算子开发工具链:提供Ascend C语言(基于C/C++扩展,深度适配昇腾芯片硬件)、编译工具、调试工具,开发效率较传统汇编语言提升3倍,同时支持直接操作芯片计算单元、存储层级与总线资源,优化空间更大;

- 硬件差异屏蔽与多端协同:统一接口适配终端、边缘、云芯片,上层框架与应用无需针对不同硬件重写逻辑,实现“一次开发,多端部署”;支持端边云算力协同,根据任务复杂度动态调度不同节点的算力资源。

3. AI框架层:全场景统一的开发入口

以MindSpore为核心,兼容TensorFlow、PyTorch等主流第三方框架,打造全场景统一的AI开发入口:

- 端边云统一训练与推理:代码一次编写,可直接部署到终端、边缘、云设备,无需针对不同硬件调整核心逻辑,开发效率提升50%+;

- 自动化优化能力:支持自动并行、混合精度训练、算子融合等功能,核心代码量降低20%,同时无需手动优化即可获得接近硬件极限的性能;

- 完善的迁移工具链:提供模型转换工具(如TensorFlow/PyTorch模型转MindSpore模型)、算子适配工具,帮助开发者快速将现有项目接入华为AI全栈体系,降低迁移成本。

4. 应用使能层:产业落地的最后一公里

面向开发者与企业提供全流程AI服务,降低产业落地门槛,核心能力包括:

- 基础AI能力封装:提供HIAI Service/Engine,封装语音识别、图像分类、NLP处理等基础AI能力,开发者无需关注底层实现,直接调用接口即可快速集成到应用中;

- 分层API设计:General APIs满足通用开发需求,接口简单易用;Advanced APIs支持高级定制,适配复杂场景的个性化需求;Expert APIs面向底层开发者,提供最大程度的灵活度;

- ModelArts平台:提供数据标注、模型训练、部署管理、监控运维全流程工具,支持低代码开发,帮助企业快速搭建AI应用,缩短研发周期。

二、CANN自定义算子开发:ReLU算子全流程深度实践

CANN支持通过Ascend C语言快速实现自定义算子,适配昇腾芯片硬件特性。以下以常用激活函数ReLU算子(f(x)=max(0,x))为例,从需求分析、硬件适配设计、代码实现、编译部署到验证优化,详解开发全流程。

1. 算子需求分析与硬件适配设计

(1)功能需求

- 支持数据类型:FP32(单精度浮点数),后续可扩展至FP16、INT8;

- 支持输入维度:1D~4D任意维度张量(如1D序列数据、2D特征图、3D视频帧、4D NCHW格式图像数据);

- 核心计算逻辑:逐元素计算y = max(0, x),即输入值大于0时输出原值,小于等于0时输出0;

- 输出要求:输出张量的形状、数据格式与输入完全一致,确保与后续算子的兼容性。

(2)硬件适配设计

ReLU算子属于元素级运算,计算复杂度较低,性能瓶颈主要在于数据搬运。为充分发挥昇腾芯片性能,需基于硬件架构进行针对性设计:

- 存储层级适配:利用Ascend C提供的L1/L2 Buffer操作接口,将输入数据加载到片上缓存(L1 Buffer)进行计算,避免频繁访问DDR(全局内存),减少数据搬运延迟;

- 并行计算适配:昇腾芯片的AI Core包含多个计算单元(EU),支持SIMD(单指令多数据)并行计算。通过Tiling技术将输入张量拆分为多个小型任务块(Tile),分配给不同EU并行处理,提升计算并行度;

- 指令集适配:优先使用Ascend C原生向量计算指令(如 acxVectorMaxF32 )替代标量计算,充分利用EU的向量处理能力,提升计算效率;

- 内存对齐适配:确保数据在内存中的存储地址符合芯片要求(如64字节对齐),避免内存访问冲突,提升数据读写速度。

2. 极简代码实现(深度优化版)

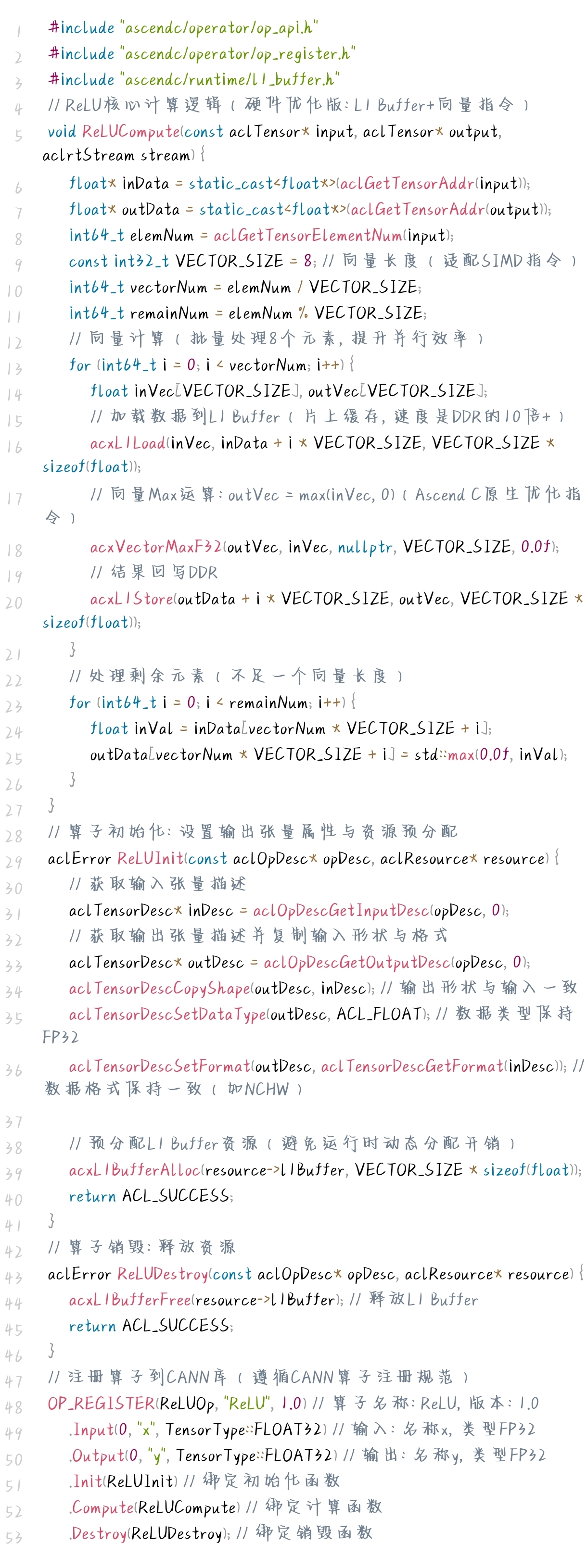

(1)算子核心计算与注册(relu_op.cc)

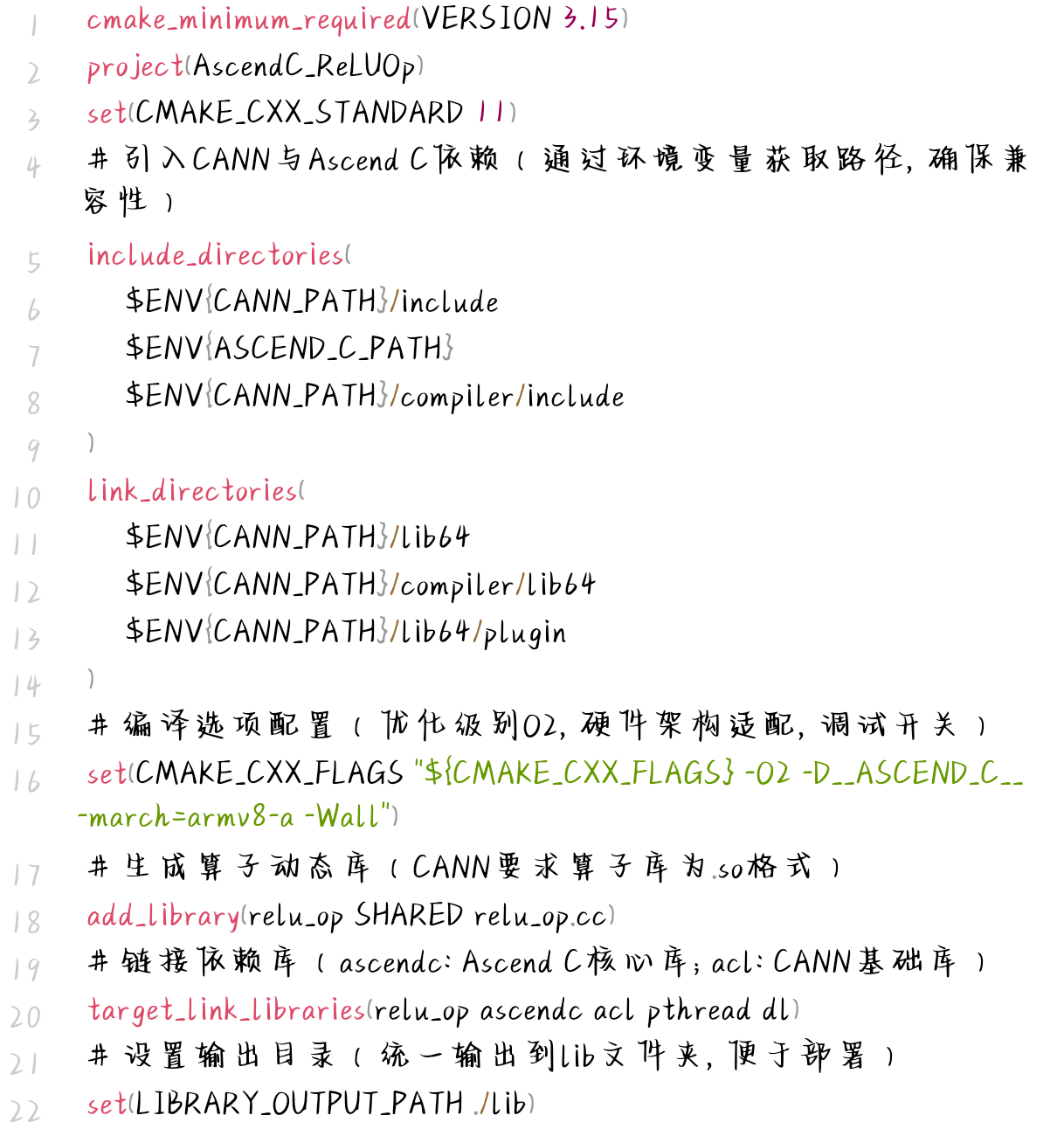

(2)算子编译配置(CMakeLists.txt)

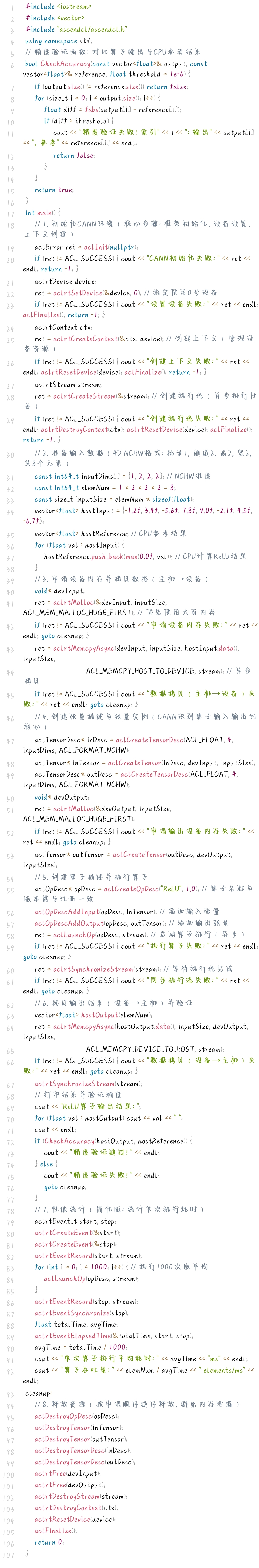

(3)算子调用与推理验证(infer.cc)

3. 编译与部署流程(详细步骤)

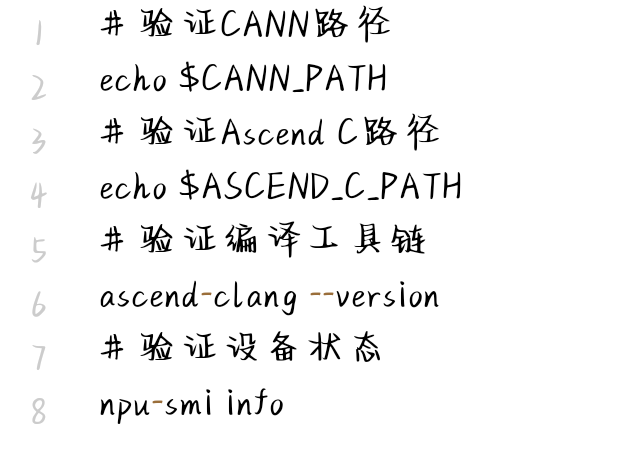

(1)环境变量验证

编译前需确保环境变量配置正确,执行以下命令验证:

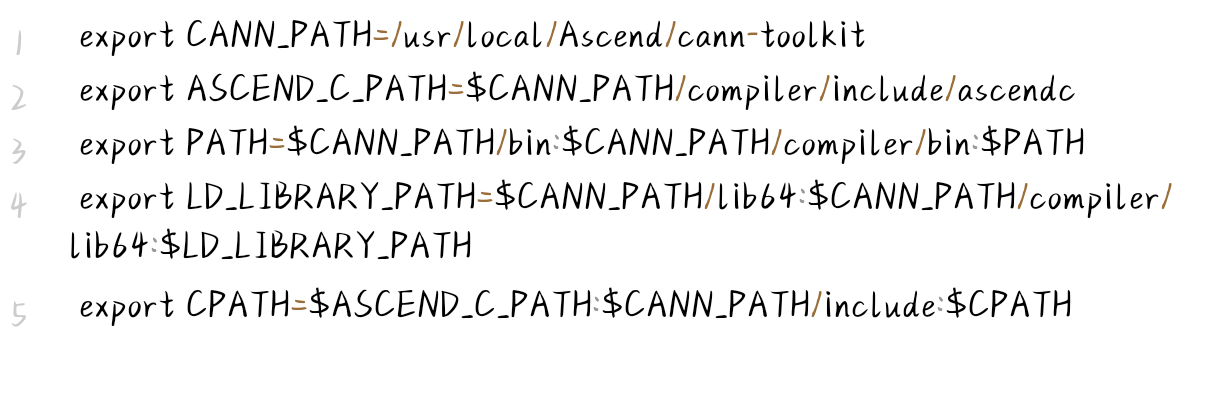

若环境变量未配置,需在 ~/.bashrc 中添加(以CANN 8.0版本为例):

配置后执行 source ~/.bashrc 生效。

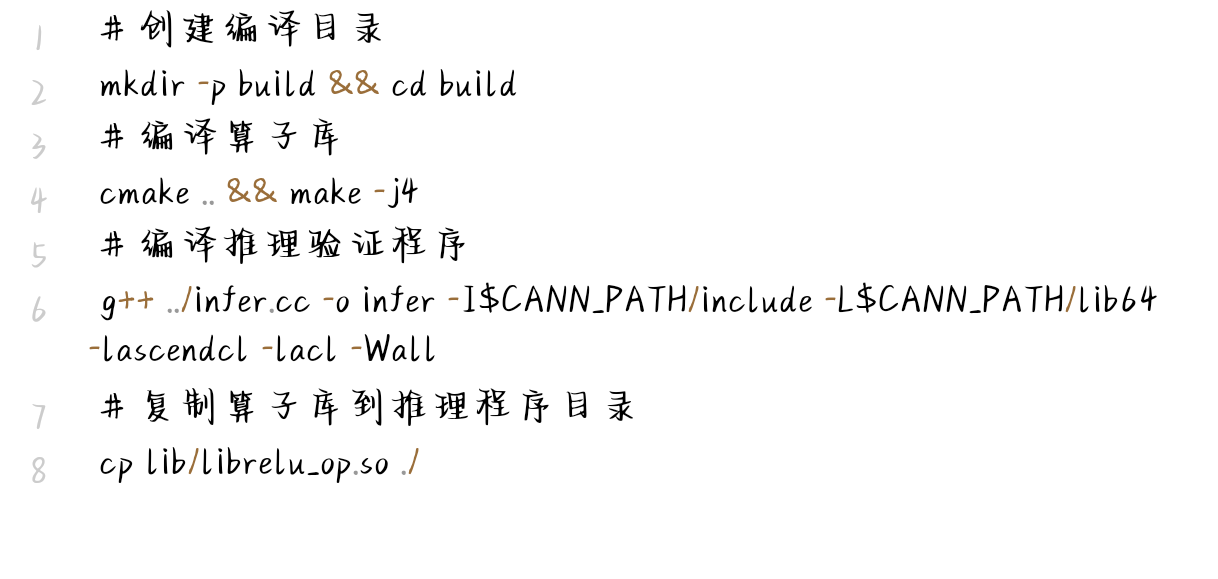

(2)编译算子库与推理程序

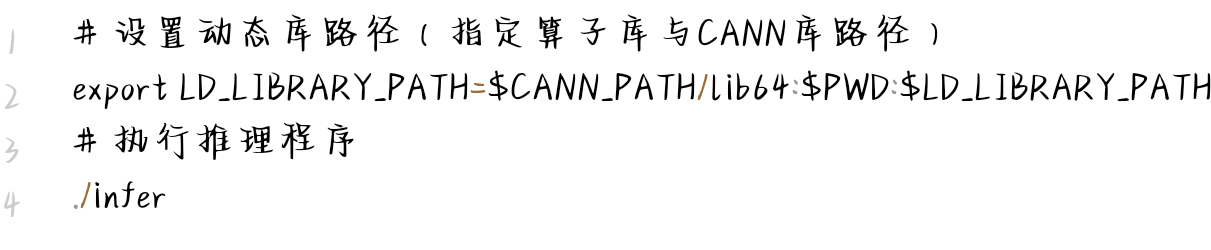

(3)执行推理与验证

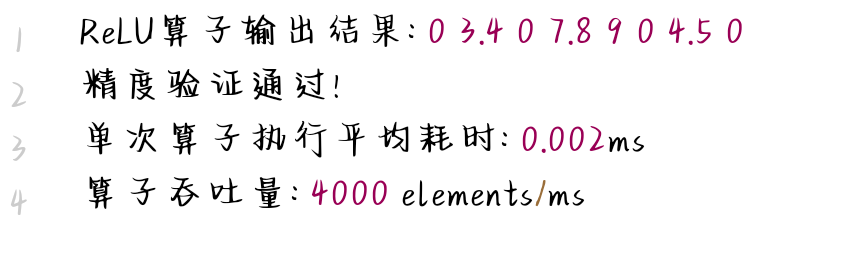

预期输出:

三、算子优化与全场景适配深度技巧

1. 性能优化核心策略(从硬件层面挖掘潜力)

(1)存储优化:最大化片上缓存利用率

- L1 Buffer复用:将输入、输出、中间结果优先存储在L1 Buffer中,减少DDR访问次数。例如ReLU算子中,批量加载8个元素到L1 Buffer后再进行计算,避免单次加载单个元素的低效操作;

- 数据对齐:确保数据在内存中的存储地址是64字节的整数倍(昇腾芯片要求),可通过 aclrtMalloc 的 ACL_MEM_ALIGN_64 标志实现,避免内存访问冲突;

- 避免冗余拷贝:在多算子串联场景中,直接在设备端传递数据(无需从设备拷贝到主机再拷贝到设备),减少数据搬运开销。

(2)计算优化:充分发挥并行与向量计算能力

- 向量指令替代标量计算:Ascend C提供丰富的向量指令(如 acxVectorAddF32 、 acxVectorMaxF32 ),一次可处理8/16个元素,性能较标量计算提升3~5倍;

- 线程块与网格尺寸优化:线程块大小设为256、512等2的幂次方(适配昇腾芯片EU调度机制),网格尺寸按任务量向上取整,确保所有计算单元都能充分利用;

- Tiling技术优化:对于高维张量(如4D NCHW),按L1缓存容量拆分Tile尺寸,例如将224×224的特征图拆分为32×32的Tile,确保每个Tile能完全载入L1缓存。

(3)调度优化:减少同步与等待开销

- 异步执行:使用 aclrtMemcpyAsync 、 aclLaunchOp 等异步接口,让数据搬运与计算并行执行,隐藏数据搬运延迟;

- 执行流调度:对于多算子任务,合理分配执行流,避免不同任务在同一执行流中阻塞等待;

- 资源预分配:在算子初始化阶段预分配L1 Buffer、内存等资源,避免运行时动态分配的开销。

2. 全场景适配要点(终端、边缘、云差异化优化)

(1)终端场景适配(低功耗、小算力)

- 低精度计算:将FP32改为INT8或FP16,减少计算量与内存占用,同时降低功耗;

- 算子轻量化:移除冗余逻辑,简化计算流程,例如ReLU算子中可移除精度验证等调试逻辑;

- 内存优化:使用小批量数据处理,避免占用过多终端设备内存。

(2)边缘场景适配(低时延、高可靠)

- 时延优化:减少数据搬运与同步操作,例如直接在设备端完成多算子串联执行,无需主机干预;

- 本地化部署:将算子与模型一起部署在边缘设备本地,避免云端传输延迟;

- 稳定性优化:添加异常处理逻辑(如内存申请失败、算子执行失败的容错机制),确保长时间稳定运行。

(3)云场景适配(高吞吐、高扩展)

- 大规模并行:利用云芯片多AI Core集群优势,通过Tiling技术将任务拆分到多个AI Core并行执行,提升吞吐量;

- 批量处理:增大任务批量尺寸(如一次处理64/128个样本),充分发挥云芯片的算力优势;

- 分布式协同:对于超大规模任务,开发分布式算子,支持多芯片、多节点并行计算,适配大模型训练场景。

3. 常见问题排查与调试技巧

(1)算子注册失败

- 排查要点:算子名称、版本号与注册函数中一致;输入输出类型、数量与注册描述一致;算子库编译成功且动态库路径正确;

- 调试方法:通过 aclGetLastError 获取错误码,查看CANN日志(路径: /var/log/npu/ )定位具体原因。

(2)性能不达标

- 排查工具:使用Ascend Profiler采集性能数据,分析计算耗时、数据搬运耗时、缓存命中率、AI Core利用率等指标;

- 优化方向:若数据搬运耗时占比高,优化存储策略(如L1 Buffer复用、数据对齐);若AI Core利用率低,优化并行调度(如线程块尺寸、Tiling策略)。

(3)精度偏差

- 排查要点:对比算子输出与CPU参考结果,定位偏差源头;检查数据类型转换是否正确(如FP32转FP16是否溢出);验证硬件指令是否存在精度损失;

- 调试方法:在算子中添加日志打印(如 ASC_LOG_INFO ),输出关键计算步骤的中间结果,定位偏差出现的环节。

(4)兼容性报错

- 排查要点:CANN版本与芯片型号匹配(如Ascend 310B需搭配CANN 7.0+版本);编译选项中的硬件架构适配(如ARM架构需添加 -march=armv8-a );

- 解决方法:升级CANN到兼容版本,调整编译选项适配目标硬件。

四、全栈架构的行业价值与进阶方向

华为AI全栈通过“芯片-CANN-框架-应用”的闭环协同,解决了AI产业落地的三大核心痛点:开发效率低(一次开发多端部署)、算力利用率低(CANN深度优化算子)、场景适配难(全场景硬件覆盖)。CANN自定义算子作为算力转化的核心载体,其开发质量直接决定了全栈方案的落地效果,尤其在自动驾驶、工业质检、大模型训练等复杂场景中,自定义算子能够满足个性化需求,实现性能突破。

1. 进阶开发方向

- 复杂算子开发:如Transformer注意力机制、3D卷积、循环神经网络(RNN)等计算密集型算子,需结合硬件特性设计更复杂的Tiling策略与并行调度逻辑;

- 低精度量化算子:INT4/INT2量化算子开发,通过量化感知训练与硬件量化指令适配,进一步提升算力密度与能效比;

- 分布式算子开发:多芯片、多节点并行算子开发,适配千亿参数大模型训练场景,需解决数据分片、通信同步等核心问题;

- 算子融合:将多个连续执行的算子(如Conv+BN+ReLU)融合为一个算子,减少数据搬运与算子调度开销,提升端到端性能。

2025年昇腾CANN训练营第二季,基于CANN开源开放全场景,推出0基础入门系列、码力全开特辑、开发者案例等专题课程,助力不同阶段开发者快速提升算子开发技能。获得Ascend C算子中级认证,即可领取精美证书,完成社区任务更有机会赢取华为手机,平板、开发板等大奖。\n\n \n\n报名链接:https://www.hiascend.com/developer/activities/cann20252

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)