openPangu-Embedded-1B:昇腾原生大模型内存泄漏检测实战指南

在昇腾Atlas硬件上部署openPangu-Embedded-1B这类10亿参数的大语言模型时,内存管理成为关键挑战。一个看似微小的内存泄漏(Memory Leak)在长时间运行的推理服务中可能累积成严重问题,导致NPU(Neural Processing Unit)内存耗尽、服务崩溃,甚至影响整个集群稳定性。本文将深入探讨openPangu-Embedded-1B在昇腾环境下的内存泄漏检测..

·

openPangu-Embedded-1B:昇腾原生大模型内存泄漏检测实战指南

引言:为什么大模型部署需要关注内存泄漏?

在昇腾Atlas硬件上部署openPangu-Embedded-1B这类10亿参数的大语言模型时,内存管理成为关键挑战。一个看似微小的内存泄漏(Memory Leak)在长时间运行的推理服务中可能累积成严重问题,导致NPU(Neural Processing Unit)内存耗尽、服务崩溃,甚至影响整个集群稳定性。

本文将深入探讨openPangu-Embedded-1B在昇腾环境下的内存泄漏检测方法,提供从理论到实践的完整解决方案。

内存泄漏的典型表现与危害

常见症状

量化影响

| 泄漏类型 | 影响程度 | 检测难度 | 修复优先级 |

|---|---|---|---|

| 张量未释放 | ⭐⭐⭐⭐⭐ | 中等 | 紧急 |

| 缓存积累 | ⭐⭐⭐⭐ | 容易 | 高 |

| 图编译泄漏 | ⭐⭐⭐ | 困难 | 中 |

| 上下文管理 | ⭐⭐ | 中等 | 中 |

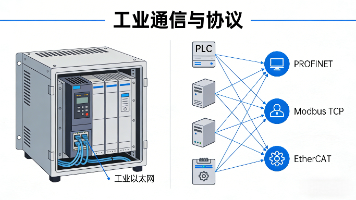

openPangu-Embedded-1B内存管理架构

核心内存组件

关键内存区域

| 内存区域 | 用途 | 泄漏风险 | 监控指标 |

|---|---|---|---|

| KV Cache | 注意力键值缓存 | 高 | kv_cache_size |

| 编码器缓存 | 多模态编码输出 | 中 | encoder_cache_size |

| 输入批次 | 请求处理状态 | 中 | batch_memory_usage |

| 中间张量 | 前向计算临时结果 | 高 | intermediate_tensors |

内存泄漏检测实战

1. 基础监控工具配置

NPU内存状态查询

# 实时监控NPU内存使用情况

npu-smi info

# 查看具体进程内存占用

npu-smi info -t proc -i 0

# 监控vLLM服务内存趋势

watch -n 5 "npu-smi info | grep -E 'Memory|Usage'"

Python内存分析集成

import torch

import psutil

import time

from collections import deque

class MemoryMonitor:

def __init__(self, check_interval=60):

self.check_interval = check_interval

self.memory_history = deque(maxlen=100)

self.leak_threshold = 1024 * 1024 * 100 # 100MB增长阈值

def start_monitoring(self):

while True:

memory_info = torch.npu.mem_get_info()

free_memory = memory_info[0] / (1024 ** 3) # GB

total_memory = memory_info[1] / (1024 ** 3) # GB

current_usage = {

'timestamp': time.time(),

'free_gb': free_memory,

'used_gb': total_memory - free_memory,

'total_gb': total_memory

}

self.memory_history.append(current_usage)

self._check_for_leaks()

time.sleep(self.check_interval)

def _check_for_leaks(self):

if len(self.memory_history) < 2:

return

recent_usage = [entry['used_gb'] for entry in list(self.memory_history)[-10:]]

if len(recent_usage) >= 5 and all(

recent_usage[i] < recent_usage[i+1]

for i in range(len(recent_usage)-1)

):

print(f"⚠️ 内存泄漏警告: 持续增长 {recent_usage}")

2. vLLM-ascend特定泄漏检测

关键监控点配置

# 在NPUModelRunner中添加内存跟踪

def __init__(self, vllm_config: VllmConfig, device: torch.device):

# ... 原有初始化代码 ...

# 内存监控增强

self.memory_monitor = MemoryMonitor()

self.allocated_blocks = set()

self._setup_memory_tracking()

def _setup_memory_tracking(self):

"""设置内存分配跟踪"""

original_allocate = torch.npu.empty

def tracked_allocate(*args, **kwargs):

tensor = original_allocate(*args, **kwargs)

size = tensor.numel() * tensor.element_size()

print(f"分配张量: {size/1024/1024:.2f}MB, shape: {tensor.shape}")

return tensor

torch.npu.empty = tracked_allocate

def _update_states(self, scheduler_output: "SchedulerOutput") -> None:

"""重写状态更新方法,添加内存清理"""

# ... 原有逻辑 ...

# 显式释放已完成请求的内存

for req_id in scheduler_output.finished_req_ids:

self._cleanup_request_memory(req_id)

# 强制垃圾回收

if len(scheduler_output.finished_req_ids) > 0:

import gc

gc.collect()

torch.npu.empty_cache()

def _cleanup_request_memory(self, req_id: str):

"""清理单个请求的内存资源"""

if req_id in self.encoder_cache:

del self.encoder_cache[req_id]

if req_id in self.requests:

del self.requests[req_id]

3. 自动化泄漏测试框架

压力测试脚本

import threading

import requests

import json

class MemoryLeakTester:

def __init__(self, base_url, model_name):

self.base_url = base_url

self.model_name = model_name

self.test_cases = self._generate_test_cases()

def _generate_test_cases(self):

return [

{"prompt": "介绍一下人工智能", "max_tokens": 50},

{"prompt": "写一首关于春天的诗", "max_tokens": 100},

{"prompt": "解释Transformer架构", "max_tokens": 200},

# ... 更多测试用例

]

def run_stress_test(self, duration=3600, requests_per_sec=10):

"""运行长时间压力测试"""

end_time = time.time() + duration

request_count = 0

while time.time() < end_time:

threads = []

for _ in range(requests_per_sec):

thread = threading.Thread(target=self._send_request)

threads.append(thread)

thread.start()

for thread in threads:

thread.join()

request_count += requests_per_sec

if request_count % 100 == 0:

self._log_memory_status()

time.sleep(1)

def _send_request(self):

"""发送单个推理请求"""

test_case = random.choice(self.test_cases)

payload = {

"model": self.model_name,

"messages": [{"role": "user", "content": test_case["prompt"]}],

"max_tokens": test_case["max_tokens"],

"temperature": 0.7

}

try:

response = requests.post(

f"{self.base_url}/v1/chat/completions",

json=payload,

timeout=30

)

return response.json()

except Exception as e:

print(f"请求失败: {e}")

return None

泄漏模式识别与修复

常见泄漏模式分析

具体修复方案

方案1:张量生命周期管理

class SafeTensorManager:

def __init__(self):

self.tracked_tensors = {}

def track_tensor(self, name, tensor):

"""跟踪张量并记录元数据"""

self.tracked_tensors[name] = {

'tensor': tensor,

'size': tensor.numel() * tensor.element_size(),

'created': time.time(),

'device': tensor.device

}

def release_tensor(self, name):

"""安全释放张量"""

if name in self.tracked_tensors:

tensor_info = self.tracked_tensors[name]

if tensor_info['tensor'] is not None:

# 确保张量在正确的设备上释放

if tensor_info['device'].type == 'npu':

tensor_info['tensor'] = None

del self.tracked_tensors[name]

def cleanup(self):

"""清理所有跟踪的张量"""

for name in list(self.tracked_tensors.keys()):

self.release_tensor(name)

方案2:KV Cache泄漏修复

def patch_kv_cache_management():

"""修补KV缓存管理中的潜在泄漏"""

original_method = NPUModelRunner._update_states

def patched_update_states(self, scheduler_output):

# 调用原始方法

result = original_method(self, scheduler_output)

# 增强的内存清理

self._cleanup_orphaned_blocks()

self._compact_memory_pools()

return result

# 应用补丁

NPUModelRunner._update_states = patched_update_states

def _cleanup_orphaned_blocks(self):

"""清理孤儿内存块"""

active_blocks = set()

for req_state in self.requests.values():

for block_ids in req_state.block_ids:

active_blocks.update(block_ids)

# 找出并释放不再使用的块

orphaned_blocks = self.allocated_blocks - active_blocks

for block_id in orphaned_blocks:

self._release_block(block_id)

self.allocated_blocks = active_blocks

监控与告警系统

实时监控看板配置

class MemoryDashboard:

def __init__(self):

self.metrics = {

'npu_memory_used': [],

'npu_memory_free': [],

'kv_cache_size': [],

'encoder_cache_size': [],

'batch_memory_usage': []

}

def update_metrics(self):

"""更新所有监控指标"""

memory_info = torch.npu.mem_get_info()

self.metrics['npu_memory_used'].append(memory_info[1] - memory_info[0])

self.metrics['npu_memory_free'].append(memory_info[0])

# 获取模型运行器特定指标

if hasattr(self, 'model_runner'):

self.metrics['kv_cache_size'].append(

sum(tensor.numel() * tensor.element_size()

for tensor in self.model_runner.kv_caches)

)

def generate_alerts(self):

"""生成内存告警"""

recent_used = self.metrics['npu_memory_used'][-10:]

if len(recent_used) >= 5:

# 检测持续增长模式

growth_rate = (recent_used[-1] - recent_used[0]) / len(recent_used)

if growth_rate > 50 * 1024 * 1024: # 50MB/分钟

self._send_alert(f"内存泄漏疑似: 增长率 {growth_rate/1024/1024:.2f}MB/分钟")

def _send_alert(self, message):

"""发送告警通知"""

print(f"🚨 内存告警: {message}")

# 这里可以集成邮件、短信、钉钉等告警渠道

自动化修复工作流

最佳实践总结

预防性措施

- 代码审查重点: 所有张量操作必须配套释放逻辑

- 资源管理: 使用上下文管理器确保资源释放

- 监控覆盖: 实现全链路内存使用监控

- 定期压测: 建立常态化压力测试机制

应急响应流程

| 泄漏级别 | 响应动作 | 目标恢复时间 |

|---|---|---|

| 轻微(<100MB/h) | 增加监控频率 | <1小时 |

| 中等(100-500MB/h) | 自动清理+告警 | <30分钟 |

| 严重(>500MB/h) | 服务重启+根因分析 | <5分钟 |

长期优化方向

- 内存池化: 实现统一的内存分配管理

- 预测性缩放: 基于历史数据的资源预测

- 智能压缩: 动态调整缓存策略

- 跨节点平衡: 集群级内存资源调度

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

项目地址: https://ai.gitcode.com/ascend-tribe/openpangu-embedded-1b-model

项目地址: https://ai.gitcode.com/ascend-tribe/openpangu-embedded-1b-model

所有评论(0)