Faster R-CNN训练实战:基于VOCdevkit2007的完整目标检测流程

PASCAL VOC2007是目标检测领域最具影响力的数据集之一,包含约9,963张图像,涵盖20个常见物体类别,如人、车、动物和日常用品。每张图像均提供精确的边界框(bounding box)标注和类别标签,支持目标检测、语义分割和图像分类三大任务。其高质量的手工标注和丰富的场景多样性,使其成为Faster R-CNN等两阶段检测器的标准评测基准。尤其在RPN区域提议生成与多尺度目标检测验证中,

简介:本文深入解析VOC2007数据集的核心工具包VOCdevkit2007,涵盖其文件结构与在Faster R-CNN目标检测模型训练中的关键作用。文章介绍如何利用Annotations、ImageSets、JPEGImages等目录进行数据准备,并通过Python脚本将XML标注转换为模型可读格式。结合TensorFlow或PyTorch框架,详细阐述RPN区域提议、分类回归训练及mAP评估全过程,帮助开发者掌握从数据预处理到模型评估的完整目标检测实践流程。

1. VOC2007数据集简介与应用场景

PASCAL VOC2007是目标检测领域最具影响力的数据集之一,包含约9,963张图像,涵盖20个常见物体类别,如人、车、动物和日常用品。每张图像均提供精确的边界框(bounding box)标注和类别标签,支持目标检测、语义分割和图像分类三大任务。其高质量的手工标注和丰富的场景多样性,使其成为Faster R-CNN等两阶段检测器的标准评测基准。尤其在RPN区域提议生成与多尺度目标检测验证中,VOC2007提供了极具挑战性的测试环境,显著提升了模型泛化能力的研究深度。

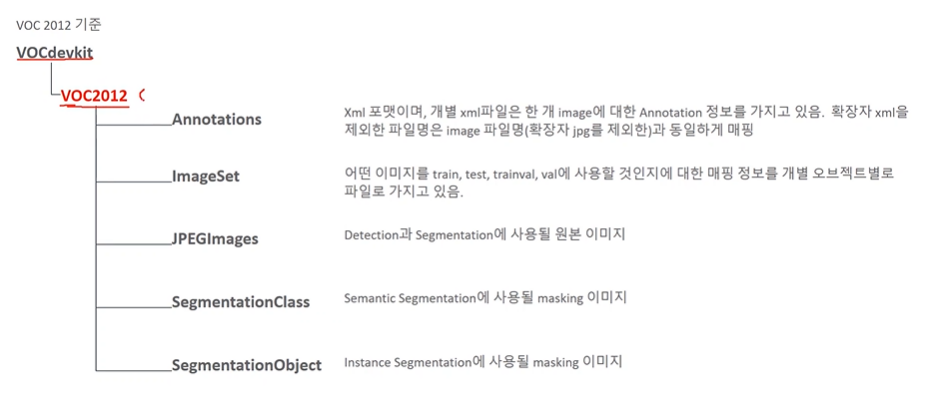

2. VOCdevkit2007文件结构详解

PASCAL VOC2007数据集作为目标检测与语义分割任务的经典基准,其高效使用依赖于对 VOCdevkit2007 目录结构的深入理解。该开发工具包不仅组织了图像、标注和划分信息,还提供了标准化接口以支持模型训练与评估流程。本章将系统性地解析 VOCdevkit2007 的层级结构,重点剖析各子目录的功能职责、文件命名规范以及关键数据的读取方式,为后续的数据预处理与模型输入构建奠定坚实基础。

2.1 VOCdevkit的核心目录布局

VOCdevkit2007 是整个PASCAL VOC2007数据集的根目录容器,其内部采用清晰且模块化的组织方式,确保不同任务(如目标检测、分割)可以独立访问所需资源,同时避免冗余或冲突。理解其核心目录布局是进行任何基于VOC2007实验的前提条件。

2.1.1 根目录VOCdevkit2007的组成结构

进入 VOCdevkit2007 后,用户会看到如下主要子目录:

VOCdevkit2007/

├── VOC2007/

│ ├── Annotations/

│ ├── ImageSets/

│ ├── JPEGImages/

│ ├── SegmentationClass/

│ └── SegmentationObject/

└── results/ # 存放模型预测结果(可选)

tools/ # 提供官方评估脚本(如voc_eval.m)

其中, VOC2007/ 是实际承载数据内容的核心目录,其余部分多用于辅助评估与结果输出。 Annotations/ 存储每张图像对应的XML格式标注文件,包含边界框坐标、类别标签等元数据; JPEGImages/ 存放原始RGB图像,均为 .jpg 格式; ImageSets/ 定义训练集、验证集和测试集的划分方式,通过文本列表指定图像ID;而 SegmentationClass/ 与 SegmentationObject/ 则分别提供像素级语义分割与实例分割的掩模图像。

这种分层设计体现了良好的关注点分离原则:图像数据、标注信息、集合划分、分割标签各自独立管理,便于扩展与维护。例如,在仅执行目标检测任务时,可忽略分割相关目录,从而减少I/O负载。

以下表格总结了 VOCdevkit2007 中各目录的主要功能及其典型应用场景:

| 目录名称 | 功能描述 | 典型用途 |

|---|---|---|

Annotations/ |

存储XML格式的标注文件,包含对象类别、边界框、截断/遮挡状态等 | 目标检测、数据增强、标注清洗 |

JPEGImages/ |

原始JPEG图像文件,按编号命名(如000001.jpg) | 图像加载、预处理、可视化 |

ImageSets/Main/ |

包含train.txt, val.txt等文本文件,列出图像ID | 数据集划分、训练流程控制 |

ImageSets/Layout/ |

针对“人”类别的姿态标注划分(较少使用) | 人体姿态估计研究 |

ImageSets/Segmentation/ |

分割任务专用划分文件 | 语义分割训练与测试 |

SegmentationClass/ |

类别级分割图(PNG格式,调色板编码) | 语义分割任务 |

SegmentationObject/ |

实例级分割图(区分同一类的不同对象) | 实例分割任务 |

注意 :所有图像和标注文件均以六位数字命名(如

000001.jpg),并与XML文件共享相同前缀,形成一一映射关系。这一命名规范极大简化了自动化脚本的设计。

2.1.2 子目录VOC2007的功能划分与路径规范

在实际项目中,正确配置路径对于数据读取至关重要。假设项目工程位于 /home/user/project/ ,推荐使用相对路径或环境变量来引用 VOC2007 数据目录,以增强代码可移植性。

import os

# 定义数据集根路径

VOC_ROOT = "/path/to/VOCdevkit2007"

VOC2007_DIR = os.path.join(VOC_ROOT, "VOC2007")

# 构建各子目录路径

ANNOTATIONS_DIR = os.path.join(VOC2007_DIR, "Annotations")

JPEGIMAGES_DIR = os.path.join(VOC2007_DIR, "JPEGImages")

IMAGESETS_DIR = os.path.join(VOC2007_DIR, "ImageSets", "Main")

SEGMENTATION_CLASS_DIR = os.path.join(VOC2007_DIR, "SegmentationClass")

上述路径构造方式不仅清晰表达了目录层级,也便于在多平台(Linux/Windows)间迁移。此外,建议封装成配置类或YAML文件,以便统一管理:

dataset:

root: /data/VOCdevkit2007

year: 2007

image_dir: ${dataset.root}/VOC${dataset.year}/JPEGImages

annotation_dir: ${dataset.root}/VOC${dataset.year}/Annotations

image_set_dir: ${dataset.root}/VOC${dataset.year}/ImageSets/Main

通过这种方式,路径逻辑集中化,降低出错风险,并支持灵活切换不同年份(如VOC2012)数据集。

为了更直观展示 VOCdevkit2007 的整体结构,下面使用Mermaid语法绘制其目录拓扑图:

graph TD

A[VOCdevkit2007] --> B[VOC2007]

A --> C[results]

A --> D[tools]

B --> E[Annotations]

B --> F[JPEGImages]

B --> G[ImageSets]

B --> H[SegmentationClass]

B --> I[SegmentationObject]

G --> J[Main]

G --> K[Layout]

G --> L[Segmentation]

style A fill:#f9f,stroke:#333

style B fill:#bbf,stroke:#333,color:#fff

style E fill:#cff,stroke:#333

style F fill:#cfc,stroke:#333

style G fill:#fcc,stroke:#333

该流程图清晰展示了从开发工具包根目录到具体功能子目录的层级关系。可以看出, ImageSets 作为一个复合节点,进一步细分为多个任务导向的子集,体现PASCAL VOC对多任务支持的设计理念。

此外,路径规范还涉及跨平台兼容问题。在Windows系统中路径分隔符为 \ ,而在Unix-like系统中为 / 。Python的 os.path.join() 函数自动处理此差异,因此应避免硬编码斜杠字符。若使用现代库如 pathlib ,可进一步提升代码可读性:

from pathlib import Path

voc_path = Path("/path/to/VOCdevkit2007") / "VOC2007"

image_path = voc_path / "JPEGImages" / "000001.jpg"

if image_path.exists():

print(f"Found image: {image_path}")

else:

raise FileNotFoundError("Image not found at specified path.")

综上所述, VOCdevkit2007 的目录结构不仅是物理文件的组织形式,更是数据流调度的基础框架。掌握其组成结构与路径访问模式,是实现自动化数据加载与处理的第一步。

2.2 Annotations目录与XML标注解析

Annotations/ 目录是目标检测任务中最关键的信息源之一,其中每个 .xml 文件对应一张图像的完整标注信息。这些文件遵循特定的XML Schema标准,记录了图像中所有感兴趣对象的位置、类别及属性状态。深入理解其结构并掌握解析方法,是构建训练数据集的核心环节。

2.2.1 XML文件的结构化标签含义(如object, name, bndbox)

一个典型的VOC2007 XML标注文件示例如下:

<annotation>

<folder>VOC2007</folder>

<filename>000001.jpg</filename>

<source>

<database>The VOC2007 Database</database>

<annotation>PASCAL VOC2007</annotation>

<image>flickr</image>

</source>

<size>

<width>353</width>

<height>500</height>

<depth>3</depth>

</size>

<segmented>0</segmented>

<object>

<name>person</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>89</xmin>

<ymin>105</ymin>

<xmax>274</xmax>

<ymax>377</ymax>

</bndbox>

</object>

<object>

<name>dog</name>

<pose>Left</pose>

<truncated>1</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>163</xmin>

<ymin>264</ymin>

<xmax>252</xmax>

<ymax>378</ymax>

</bndbox>

</object>

</annotation>

各标签含义如下:

<filename>:对应图像文件名(不含路径)<size>:图像尺寸(宽、高、通道数)<object>:表示一个检测对象,可能重复出现(多个物体)<name>:类别名称(共20类,如car, cat, bicycle等)<truncated>:是否被截断(1表示部分可见)<difficult>:是否难以识别(1表示模糊、小目标等)<bndbox>:边界框坐标,以左上角为原点,单位为像素

这些字段直接影响训练过程中的样本选择策略。例如,常有过滤 difficult=1 的对象以提高训练稳定性。

2.2.2 使用Python解析XML实现边界框信息提取

利用Python内置的 xml.etree.ElementTree 模块,可轻松解析XML文件并提取所需信息。以下是一个完整的解析函数:

import xml.etree.ElementTree as ET

import os

def parse_voc_xml(xml_file):

"""

解析单个VOC XML文件,返回图像信息与对象列表

:param xml_file: XML文件路径

:return: dict 包含filename, size, objects

"""

tree = ET.parse(xml_file)

root = tree.getroot()

data = {

'filename': root.find('filename').text,

'size': {

'width': int(root.find('size/width').text),

'height': int(root.find('size/height').text),

'depth': int(root.find('size/depth').text)

},

'objects': []

}

for obj in root.findall('object'):

obj_data = {

'name': obj.find('name').text,

'truncated': int(obj.find('truncated').text),

'difficult': int(obj.find('difficult').text),

'bbox': {

'xmin': int(obj.find('bndbox/xmin').text),

'ymin': int(obj.find('bndbox/ymin').text),

'xmax': int(obj.find('bndbox/xmax').text),

'ymax': int(obj.find('bndbox/ymax').text)

}

}

data['objects'].append(obj_data)

return data

# 示例调用

xml_path = os.path.join(ANNOTATIONS_DIR, "000001.xml")

parsed_data = parse_voc_xml(xml_path)

print(parsed_data['objects'])

代码逻辑逐行解读:

ET.parse(xml_file):加载并解析XML文件生成树结构。root.getroot():获取XML文档根节点。find()方法定位单一元素(如filename),findall()获取所有匹配项(如多个object)。.text属性提取标签内的文本内容,并转换为整型用于数值计算。- 每个

object节点被构造成字典,包含类别名、难度标志和归一化后的边界框。

该函数输出可用于后续数据增强、可视化或训练样本生成。例如,结合 matplotlib 绘制边界框:

import matplotlib.pyplot as plt

import matplotlib.patches as patches

from PIL import Image

img = Image.open(os.path.join(JPEGIMAGES_DIR, parsed_data['filename']))

fig, ax = plt.subplots(1)

ax.imshow(img)

for obj in parsed_data['objects']:

bbox = obj['bbox']

rect = patches.Rectangle(

(bbox['xmin'], bbox['ymin']),

bbox['xmax'] - bbox['xmin'],

bbox['ymax'] - bbox['ymin'],

linewidth=2, edgecolor='r', facecolor='none'

)

ax.add_patch(rect)

ax.text(bbox['xmin'], bbox['ymin']-10, obj['name'], color='white', backgroundcolor='red')

plt.show()

2.2.3 标注一致性检查与异常数据清洗方法

尽管VOC2007标注质量较高,但仍可能存在边界框越界、类别拼写错误或空文件等问题。实施一致性检查有助于提升训练鲁棒性。

常见检查项包括:

| 检查类型 | 判断条件 | 处理方式 |

|---|---|---|

| 坐标合法性 | xmin < 0 或 xmax > width |

裁剪至合法范围 |

| 宽高有效性 | width <= 0 或 height <= 0 |

忽略或标记为difficult |

| 类别合法性 | name not in CLASS_NAMES |

报警并记录 |

| 文件缺失 | .xml 存在但 .jpg 不存在 |

删除标注或补全数据 |

实现示例:

def validate_annotation(xml_file, img_dir):

data = parse_voc_xml(xml_file)

img_path = os.path.join(img_dir, data['filename'])

if not os.path.exists(img_path):

print(f"[ERROR] Image not found: {img_path}")

return False

for obj in data['objects']:

bbox = obj['bbox']

w = data['size']['width']

h = data['size']['height']

if (bbox['xmin'] >= bbox['xmax'] or

bbox['ymin'] >= bbox['ymax']):

print(f"[WARN] Invalid bbox in {xml_file}: {obj['name']}")

continue

if (bbox['xmin'] < 0 or bbox['ymin'] < 0 or

bbox['xmax'] > w or bbox['ymax'] > h):

print(f"[FIX] Clamping bbox in {xml_file}")

bbox['xmin'] = max(0, bbox['xmin'])

bbox['ymin'] = max(0, bbox['ymin'])

bbox['xmax'] = min(w, bbox['xmax'])

bbox['ymax'] = min(h, bbox['ymax'])

return True

此函数可在数据加载前批量运行,确保输入数据的完整性与合理性。

2.3 ImageSets划分训练/验证/测试集方法

2.3.1 Main、Layout、Segmentation子目录的作用区别

ImageSets/ 下的三个子目录服务于不同任务需求:

- Main/ :目标检测专用,包含各类别的正负样本划分(如

car_train.txt) - Layout/ :人体部件布局标注划分(如头、躯干),用于姿态估计

- Segmentation/ :语义分割任务的图像ID列表

其中, Main/ 最为常用,其文件命名规则为 {class}_{set}.txt ,例如 aeroplane_train.txt 表示飞机类的训练图像列表,每行格式为 <image_id> <1/-1> ,1表示包含该类,-1表示不包含。

2.3.2 train.txt、val.txt、trainval.txt的生成逻辑与用途

这三个核心文件定义了标准划分:

| 文件 | 内容 | 用途 |

|---|---|---|

train.txt |

5717张图像ID | 训练阶段使用 |

val.txt |

5823张图像ID | 验证模型性能 |

trainval.txt |

train + val 合并(11540张) | 全量训练 |

test.txt |

未公开标签,仅用于官方评测 | 最终提交结果 |

可通过简单脚本统计数量:

wc -l VOC2007/ImageSets/Main/train.txt

这些文件由VOC官方预先生成,无需手动创建。但在自定义实验中,可能需要重新划分。

2.3.3 自定义数据划分策略以适配特定实验需求

当研究少样本学习或领域泛化时,需定制划分策略。例如,按比例随机切分:

import random

from sklearn.model_selection import train_test_split

def create_custom_split(image_ids, test_ratio=0.2, seed=42):

train_ids, val_ids = train_test_split(

image_ids, test_size=test_ratio, random_state=seed

)

with open("custom_train.txt", "w") as f:

f.write("\n".join(train_ids))

with open("custom_val.txt", "w") as f:

f.write("\n".join(val_ids))

# 获取所有图像ID

all_images = [f.split(".")[0] for f in os.listdir(JPEGIMAGES_DIR)]

create_custom_split(all_images)

此方法允许灵活控制数据分布,适用于消融实验或多阶段训练。

2.4 JPEGImages图像数据组织规范

2.4.1 图像命名规则与格式要求(.jpg)

所有图像以六位零填充数字命名(如 000001.jpg ),共约9963张。命名唯一且与XML文件严格对应。格式统一为JPEG,RGB三通道,无Alpha通道。

2.4.2 图像预处理流程:尺寸归一化与色彩空间转换

虽然Faster R-CNN通常保持原始分辨率送入网络(利用RoI Pooling适应尺度变化),但某些框架要求固定输入尺寸。通用预处理流程如下:

from PIL import Image

import torch

import torchvision.transforms as T

transform = T.Compose([

T.Resize((600, 800)), # 短边缩放至600,长边等比

T.ToTensor(),

T.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

img = Image.open(os.path.join(JPEGIMAGES_DIR, "000001.jpg")).convert("RGB")

tensor_img = transform(img).unsqueeze(0) # 添加batch维度

该流程实现了尺寸归一化、张量转换与标准化,符合主流深度学习框架输入要求。

综上, VOCdevkit2007 的文件结构设计严谨,层次分明,充分支持多种视觉任务的开展。深入掌握其组织逻辑与数据访问方式,是构建高效目标检测系统的基石。

3. 语义分割相关文件与掩模数据管理

语义分割作为计算机视觉中像素级理解任务的核心,其目标是为图像中的每一个像素分配一个类别标签。在PASCAL VOC2007数据集中,语义分割任务被赋予了与目标检测同等重要的地位,并通过两个专用目录 SegmentationClass 与 SegmentationObject 提供精细的标注支持。这些掩模(mask)数据不仅可用于独立的分割模型训练(如FCN、U-Net、DeepLab),还可与边界框标注协同使用,在多任务学习或弱监督检测中发挥关键作用。本章将深入剖析VOC2007中语义分割相关文件的组织结构、编码机制和实际操作方法,重点解析掩模图像的存储格式、可视化流程以及与其他任务的数据联动方式。

3.1 SegmentationClass与SegmentationObject目录对比

PASCAL VOC2007中的语义分割标注分为两类: 类别级分割图(Class Segmentation) 和 实例级分割图(Object Segmentation) ,分别对应 SegmentationClass 和 SegmentationObject 两个子目录。这两个目录共享相同的图像命名规则(以 .png 格式保存),但其像素值编码逻辑存在本质差异,服务于不同的建模需求。

3.1.1 类别级分割图(Class Segmentation)的数据编码方式

SegmentationClass 目录下的每一张PNG图像代表的是整幅输入图像中每个像素所属的语义类别。例如,背景标记为0,人标记为15,汽车标记为6等。这种编码采用的是 调色板模式(Palette Mode) 的8位灰度图(Grayscale with Palette),即图像本身是一个单通道矩阵,其像素值范围为0~255,每个数值映射到一个预定义的颜色和语义类别。

该目录的设计初衷是为了支持全卷积网络(Fully Convolutional Networks, FCN)等端到端语义分割模型的训练。由于所有同类对象共享同一标签值(如所有人都是15),因此无法区分同一类别的多个个体——这正是“语义分割”与“实例分割”的根本区别。

为了便于理解,下表展示了VOC2007中部分常见类别的ID映射关系:

| 类别名称 | 分割标签值 | RGB颜色(近似) |

|---|---|---|

| 背景 | 0 | (0, 0, 0) |

| 飞机 | 1 | (128, 0, 0) |

| 自行车 | 2 | (0, 128, 0) |

| 鸟 | 3 | (128, 128, 0) |

| 船 | 4 | (0, 0, 128) |

| 瓶子 | 5 | (128, 0, 128) |

| 车 | 6 | (0, 128, 128) |

| … | … | … |

| 人 | 15 | (192, 192, 192) |

注:具体颜色由PNG调色板决定,非直接RGB三通道输出。

这类图像在加载时必须保留原始的调色板信息,否则会导致颜色错乱或语义误解。Python中可通过PIL库正确读取此类图像并提取其类别索引矩阵。

from PIL import Image

import numpy as np

# 加载类别级分割图

mask_path = "VOCdevkit/VOC2007/SegmentationClass/000032.png"

mask_img = Image.open(mask_path)

# 检查是否为P模式(调色板模式)

print(f"Image mode: {mask_img.mode}") # 应输出 'P'

# 转换为numpy数组(此时仍保持调色板索引)

mask_array = np.array(mask_img)

print(f"Unique labels in mask: {np.unique(mask_array)}")

代码逻辑逐行解读:

- 第3行:使用

PIL.Image.open()打开指定路径的PNG图像,自动识别其为调色板图像。 - 第6–7行:检查图像模式是否为

'P',这是判断是否为调色板图像的关键依据。若误用OpenCV加载可能丢失调色板信息。 - 第10–11行:将图像转换为NumPy数组后,得到的是每个像素对应的类别ID(0~255之间的整数)。此时可进行唯一值统计,验证包含哪些物体类别。

此外,值得注意的是,某些图像可能包含未标注区域(ignore regions),通常用255表示。在训练过程中应将其设置为忽略标签(ignore_index),避免影响损失函数计算。

3.1.2 实例级分割图(Object Segmentation)的像素级标注机制

与 SegmentationClass 不同, SegmentationObject 目录提供的是一张张 实例感知的分割图 。虽然同样是PNG格式且使用调色板,但其像素值不再仅表示语义类别,而是对 每个独立对象实例赋予唯一的标识符 。

例如,在一幅包含两只猫的图像中:

- SegmentationClass 中两只猫都标记为类别8;

- SegmentationObject 中第一只猫可能标记为81,第二只为82,其中十位数字表示语义类别(8=猫),个位用于区分不同实例。

这种设计使得研究者可以在不依赖额外注释的情况下实现一定程度的实例分离,尤其适用于弱监督实例分割或实例感知语义分割的研究场景。

然而需要指出,VOC2007并未提供真正的逐实例边界框或ID跟踪机制,因此 SegmentationObject 更像是“伪实例分割”,主要用于辅助分析对象空间分布或构建更复杂的标签派生策略。

下面是一个解析 SegmentationObject 图像并提取实例信息的示例代码:

import matplotlib.pyplot as plt

# 加载实例级分割图

obj_mask_path = "VOCdevkit/VOC2007/SegmentationObject/000032.png"

obj_mask_img = Image.open(obj_mask_path)

obj_mask_array = np.array(obj_mask_img)

# 分析实例组成

unique_values = np.unique(obj_mask_array[obj_mask_array != 0]) # 排除背景

instances_info = {}

for val in unique_values:

if val == 255: # 忽略区域

continue

semantic_id = val // 10 # 十位数为类别ID

instance_id = val % 10 # 个位数为实例编号

instances_info[val] = {'class': semantic_id, 'instance': instance_id}

print("Detected instances:", instances_info)

参数说明与扩展分析:

val // 10和val % 10是基于VOC约定的解码逻辑。该编码方式虽简单,但在类别超过9或实例超过9时会产生冲突(如类别10与实例1混淆),因此实际应用中需谨慎处理边界情况。- 若图像中出现非法值(如大于250且非255),应视为噪声或损坏数据,建议加入清洗步骤。

- 此外,可以结合XML中的

<object>列表验证实例数量是否一致,从而实现跨模态一致性校验。

3.2 掩模图像的存储格式与可视化技术

掩模图像的质量直接影响模型训练效果,而正确的加载与可视化手段则是确保数据无误的前提。本节将系统介绍VOC2007中PNG掩模的内部结构、调色板原理及常用可视化工具链。

3.2.1 PNG格式中调色板(palette)的映射原理

VOC2007的分割图采用 8-bit paletted PNG 格式,这意味着每个像素仅占用1字节(0~255),并通过一个外部查找表(LUT, Look-Up Table)映射到具体的RGB颜色。这种压缩方式显著减少了文件体积,同时保证了语义清晰性。

调色板本质上是一个长度为768字节的数组(256 entries × 3 channels),按 R0,G0,B0,R1,G1,B1,…顺序排列。当图像模式为 'P' 时,渲染器会根据当前像素值 i 查找第 i*3 到 i*3+2 字节,获得对应颜色。

以下Mermaid流程图展示了解码过程:

graph TD

A[读取PNG文件] --> B{图像模式?}

B -- P模式 --> C[提取调色板LUT]

B -- RGB模式 --> D[直接获取像素值]

C --> E[像素值→索引]

E --> F[索引查表得RGB]

F --> G[显示彩色分割图]

该机制的优势在于:即使原始标签是离散的整数,也能通过固定调色板实现一致的可视化效果。然而一旦调色板丢失(如用OpenCV错误地保存为普通灰度图),则无法还原原始语义。

3.2.2 利用OpenCV或PIL加载并显示分割掩模

尽管PIL天然支持调色板图像,但OpenCV默认将其解释为灰度图,容易造成语义错乱。以下是推荐的跨库安全加载方案:

import cv2

import matplotlib.pyplot as plt

def load_segmentation_mask_safe(path):

pil_img = Image.open(path)

palette = pil_img.getpalette() # 获取原始调色板

mask_array = np.array(pil_img)

# 构建伪彩色图像用于显示

color_mask = np.zeros((mask_array.shape[0], mask_array.shape[1], 3), dtype=np.uint8)

for idx in np.unique(mask_array):

if idx == 255:

continue

color_mask[mask_array == idx] = palette[idx*3:idx*3+3]

return mask_array, color_mask

# 使用示例

raw_mask, vis_mask = load_segmentation_mask_safe(mask_path)

plt.figure(figsize=(12, 6))

plt.subplot(1, 2, 1)

plt.imshow(raw_mask, cmap='nipy_spectral')

plt.title("Raw Class Mask (Indexed)")

plt.axis('off')

plt.subplot(1, 2, 2)

plt.imshow(vis_mask)

plt.title("Colorized Visualization")

plt.axis('off')

plt.show()

逻辑分析:

- 函数

getpalette()提取完整的256×3调色板数据; - 构造

color_mask三维数组,手动完成索引到RGB的映射; - 可视化时使用

nipy_spectral等离散色谱突出类别差异。

3.2.3 掩模与原始图像的对齐校验方法

由于分割任务要求像素级精确匹配,必须验证掩模与原始JPEG图像的空间一致性。常见的问题包括尺寸不匹配、裁剪偏移或坐标反转。

可通过以下脚本实现自动化对齐检查:

def check_alignment(image_path, mask_path):

img = cv2.imread(image_path)

mask_pil = Image.open(mask_path)

mask = np.array(mask_pil)

h_img, w_img = img.shape[:2]

h_mask, w_mask = mask.shape

if h_img != h_mask or w_img != w_mask:

print(f"[ERROR] Size mismatch: Image({w_img}x{h_img}) vs Mask({w_mask}x{h_mask})")

return False

# 叠加显示用于人工核查

img_rgb = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

overlay = cv2.addWeighted(img_rgb, 0.6,

(vis_mask if 'vis_mask' in locals() else

np.stack([mask]*3, axis=-1)), 0.4, 0)

plt.imshow(overlay)

plt.title("Overlay: Image + Mask")

plt.axis('off')

plt.show()

return True

此函数可用于批量检测数据集完整性,防止因预处理失误导致训练失败。

3.3 分割任务与目标检测的数据协同使用

虽然语义分割与目标检测属于不同层级的任务,但在现代多任务学习框架中,二者常被联合利用以提升特征表达能力。VOC2007提供了同时涵盖边界框与掩模的数据基础,为这种协同提供了可能。

3.3.1 如何从分割图中反推边界框坐标

在缺乏XML标注的情况下,可利用分割图生成粗略的包围盒(Bounding Box)。这对于数据增强、弱监督学习或异常检测非常有用。

def mask_to_bounding_box(mask_array, class_id):

"""从类别分割图中提取指定类别的最小外接矩形"""

instances = (mask_array == class_id)

if not np.any(instances):

return None

rows = np.any(instances, axis=1)

cols = np.any(instances, axis=0)

ymin, ymax = np.where(rows)[0][[0, -1]]

xmin, xmax = np.where(cols)[0][[0, -1]]

return [xmin, ymin, xmax, ymax]

# 示例:从mask_array中提取人的边界框

person_bbox = mask_to_bounding_box(mask_array, class_id=15)

print("Inferred person bbox:", person_bbox)

参数说明:

- mask_array : 来自 SegmentationClass 的整数标签图;

- class_id : 目标类别的ID(如15为人);

- 输出为 [x_min, y_min, x_max, y_max] 格式的边界框。

此方法生成的框比手工标注稍大(包含完整轮廓),适合用作RPN的候选区域初始化或教师信号。

3.3.2 多任务学习中共享特征的基础支持

在Faster R-CNN++或Mask R-CNN架构中,主干网络提取的特征图可同时服务于检测头和分割头。VOC2007的双标注体系恰好满足这一需求。

下表总结了两种任务的数据来源及其融合潜力:

| 任务类型 | 数据源 | 特征用途 | 融合方式 |

|---|---|---|---|

| 目标检测 | Annotations/XML | RPN + RoI Head分类回归 | 共享Backbone特征图 |

| 语义分割 | SegmentationClass | 像素级分类监督 | 解码器分支接入高层特征 |

| 实例感知训练 | SegmentationObject | 辅助实例分离 | 对比学习或注意力引导 |

借助统一的数据路径管理,可在PyTorch Dataset类中同时返回图像、boxes、labels和masks,构建真正的多任务输入管道。

综上所述, SegmentationClass 与 SegmentationObject 不仅是独立任务的数据支撑,更是通往高级视觉理解的重要桥梁。通过对掩模数据的深入管理和有效利用,开发者能够在单一框架下实现检测、分割乃至实例识别的统一建模。

4. 从原始标注到模型输入的数据转换

目标检测任务的成功不仅依赖于强大的模型架构,更取决于高质量、结构化且适配框架的输入数据。在使用PASCAL VOC2007数据集训练如Faster R-CNN等深度学习模型时,原始的XML格式标注文件无法被直接用于训练流程,必须经过一系列标准化处理,转化为特定格式的训练样本列表或二进制数据流。本章系统性地阐述如何将VOC2007中分散存储的图像路径与XML标注信息整合为统一的输入表示形式,并探讨在此过程中引入数据增强策略以提升模型泛化能力的技术路径。此外,还将详细说明不同主流深度学习框架(如TensorFlow与PyTorch)对输入数据的不同要求及其对应的适配方法。

4.1 XML标注转Faster R-CNN输入格式(如voc_train.txt)

在构建目标检测系统的训练流水线之前,首要任务是将VOC2007提供的结构化XML标注文件转换为适用于目标检测模型训练的轻量级文本记录格式。这类格式通常表现为每行一条样本,包含图像路径、类别标签以及边界框坐标(x_min, y_min, x_max, y_max),并以空格或逗号分隔字段。该过程不仅是数据预处理的基础步骤,也是后续实现批量加载和高效迭代的前提条件。

4.1.1 构建标准训练文本文件的字段设计(图像路径+标签+坐标)

为了确保训练脚本能准确读取每张图像中的多个对象实例,需设计一种既能表达单图多框又能保持可扩展性的文本格式。常见的做法是采用“一行一对象”的方式组织 voc_train.txt 文件,其典型结构如下所示:

JPEGImages/000005.jpg,23,21,178,196,14

JPEGImages/000005.jpg,94,17,196,195,14

JPEGImages/000007.jpg,8,12,302,269,1

其中各字段含义如下表所示:

| 字段位置 | 含义 | 示例值 | 说明 |

|---|---|---|---|

| 第1列 | 图像相对路径 | JPEGImages/000005.jpg | 相对于VOCdevkit根目录的路径 |

| 第2列 | x_min | 23 | 边界框左上角横坐标 |

| 第3列 | y_min | 21 | 边界框左上角纵坐标 |

| 第4列 | x_max | 178 | 边界框右下角横坐标 |

| 第5列 | y_max | 196 | 边界框右下角纵坐标 |

| 第6列 | class_id | 14 | 类别索引,对应VOC类别映射表 |

这种设计的优势在于:

- 支持一张图像出现多个目标;

- 易于通过Python逐行解析生成张量;

- 可无缝对接大多数自定义Dataset类。

值得注意的是,类别ID应遵循VOC2007官方定义的20个类别的顺序进行编号(从0开始或1开始依框架而定)。例如,“aeroplane”=0,“bicycle”=1,……,“tvmonitor”=19。

VOC类别映射表(class_to_idx)

CLASS_NAMES = [

'aeroplane', 'bicycle', 'bird', 'boat',

'bottle', 'bus', 'car', 'cat',

'chair', 'cow', 'diningtable', 'dog',

'horse', 'motorbike', 'person', 'pottedplant',

'sheep', 'sofa', 'train', 'tvmonitor'

]

class_to_idx = {cls: idx for idx, cls in enumerate(CLASS_NAMES)}

该字典将在解析XML时用于将 <name> 标签内容转换为整数类别标签。

4.1.2 批量自动化脚本编写:遍历Annotations生成训练列表

以下是一个完整的Python脚本示例,用于自动遍历 Annotations/ 目录下的所有XML文件,提取每幅图像中所有物体的边界框与类别信息,并写入 voc_train.txt 文件。

import os

import xml.etree.ElementTree as ET

# 配置路径

ANNOTATIONS_DIR = "VOCdevkit/VOC2007/Annotations"

IMAGE_DIR = "VOCdevkit/VOC2007/JPEGImages"

OUTPUT_FILE = "voc_train.txt"

# VOC 20类名称映射

CLASS_NAMES = [

'aeroplane', 'bicycle', 'bird', 'boat', 'bottle', 'bus', 'car', 'cat',

'chair', 'cow', 'diningtable', 'dog', 'horse', 'motorbike', 'person',

'pottedplant', 'sheep', 'sofa', 'train', 'tvmonitor'

]

class_to_idx = {name: idx for idx, name in enumerate(CLASS_NAMES)}

def parse_xml(xml_path):

tree = ET.parse(xml_path)

root = tree.getroot()

size = root.find('size')

width = int(size.find('width').text)

height = int(size.find('height').text)

objects = []

for obj in root.findall('object'):

cls_name = obj.find('name').text.lower().strip()

if cls_name not in class_to_idx:

continue # 忽略无效类别

bbox = obj.find('bndbox')

xmin = float(bbox.find('xmin').text)

ymin = float(bbox.find('ymin').text)

xmax = float(bbox.find('xmax').text)

ymax = float(bbox.find('ymax').text)

# 坐标裁剪,防止越界

xmin = max(0, min(xmin, width - 1))

ymin = max(0, min(ymin, height - 1))

xmax = max(0, min(xmax, width - 1))

ymax = max(0, min(ymax, height - 1))

if xmin >= xmax or ymin >= ymax:

continue # 无效框跳过

cls_id = class_to_idx[cls_name]

objects.append((xmin, ymin, xmax, ymax, cls_id))

return objects

def generate_train_list():

with open(OUTPUT_FILE, 'w') as f_out:

for xml_file in os.listdir(ANNOTATIONS_DIR):

if not xml_file.endswith('.xml'):

continue

image_id = xml_file.split('.')[0]

xml_path = os.path.join(ANNOTATIONS_DIR, xml_file)

img_path = os.path.join(IMAGE_DIR, f"{image_id}.jpg")

if not os.path.exists(img_path):

print(f"Warning: Image {img_path} not found, skipping.")

continue

boxes = parse_xml(xml_path)

for box in boxes:

line = f"{img_path},{int(box[0])},{int(box[1])},{int(box[2])},{int(box[3])},{box[4]}\n"

f_out.write(line)

if __name__ == "__main__":

generate_train_list()

print(f"Training list saved to {OUTPUT_FILE}")

代码逻辑逐行分析与参数说明

- 第6–10行 :定义关键路径变量。

ANNOTATIONS_DIR指向XML标注文件夹;IMAGE_DIR为JPG图像所在目录;OUTPUT_FILE为输出训练文件名。 - 第13–15行 :声明VOC2007的20个类别名称列表,并创建

class_to_idx字典实现类别名到索引的映射。 - 第18–37行 :

parse_xml()函数负责解析单个XML文件。 ET.parse(xml_path)读取XML树结构;- 提取图像尺寸用于坐标合法性校验;

- 遍历每个

<object>节点,获取类别名与边界框坐标; - 对坐标执行裁剪操作,避免超出图像边界;

- 若存在非法框(如xmin≥xmax),则跳过;

- 返回一个元组列表,每个元素代表一个有效目标。

- 第40–57行 :

generate_train_list()主函数循环处理所有XML文件。 - 使用

os.listdir()枚举所有XML文件; - 根据文件ID拼接图像路径;

- 调用

parse_xml()获取该图像的所有标注; - 每个目标单独写入一行,字段间用逗号分隔;

- 最终生成可用于训练的数据列表。

此脚本具备良好的鲁棒性,支持跨平台运行,并可通过修改 OUTPUT_FILE 适配训练集、验证集或测试集的生成需求。

4.1.3 数据路径配置与跨平台兼容性处理

在实际项目部署中,常面临Windows与Linux/macOS之间的路径分隔符差异问题( \ vs / )。上述脚本虽然使用了 os.path.join() 来保证路径拼接的正确性,但仍建议进一步封装路径处理模块以增强可移植性。

推荐使用 pathlib.Path 替代传统字符串拼接:

from pathlib import Path

# 使用Path对象统一管理路径

base_dir = Path("VOCdevkit/VOC2007")

annotations_dir = base_dir / "Annotations"

image_dir = base_dir / "JPEGImages"

output_file = Path("voc_train.txt")

# 在循环中使用

xml_path = annotations_dir / xml_file

img_path = image_dir / f"{image_id}.jpg"

pathlib 会自动根据操作系统选择合适的路径分隔符,极大提升了脚本的跨平台兼容性。

此外,在分布式训练或多机协作场景中,建议将图像路径设为相对路径而非绝对路径,便于迁移至其他环境。若使用Docker容器或云平台训练,还可结合环境变量注入路径配置:

export VOC_ROOT="/data/vocdevkit"

python generate_voc_list.py --root $VOC_ROOT

这样可在不修改代码的前提下灵活切换数据源位置。

4.2 数据增强策略在输入管道中的集成

数据增强是提升目标检测模型鲁棒性和泛化能力的关键技术手段。尤其在小样本或类别不平衡的情况下,合理应用增强策略可以显著缓解过拟合现象。然而,由于目标检测涉及空间定位任务,增强操作必须同步更新边界框坐标,否则会导致标签错位。因此,增强算法不仅要作用于图像像素,还需精确维护标注信息的一致性。

4.2.1 常见增强方法:翻转、裁剪、色彩抖动的应用实现

常用的几何变换与颜色扰动方法包括水平翻转、随机裁剪、缩放、旋转、亮度/对比度调整等。以下以 Albumentations 库为例展示如何在保持边界框同步更新的同时实施增强。

首先安装依赖库:

pip install albumentations opencv-python

然后定义增强流水线:

import albumentations as A

import cv2

transform = A.Compose([

A.HorizontalFlip(p=0.5), # 50%概率水平翻转

A.RandomBrightnessContrast(brightness_limit=0.2, contrast_limit=0.2, p=0.5),

A.GaussNoise(var_limit=(10.0, 50.0), p=0.3),

A.OneOf([

A.Blur(blur_limit=3, p=0.3),

A.MotionBlur(blur_limit=5, p=0.3),

], p=0.3),

A.Resize(height=512, width=512) # 统一分辨率

], bbox_params=A.BboxParams(

format='pascal_voc', # 输入框为[xmin,ymin,xmax,ymax]

label_fields=['class_labels'], # 类别标签字段名

min_visibility=0.3 # 增强后保留至少30%可见的目标

Albumentations增强流程图(Mermaid)

graph TD

A[原始图像 + BBox] --> B{是否应用增强?}

B -->|是| C[水平翻转]

B -->|否| D[保持原样]

C --> E[亮度/对比度扰动]

E --> F[添加高斯噪声或模糊]

F --> G[调整图像尺寸至512x512]

G --> H[输出增强图像 + 更新后的BBox]

D --> G

该流程图清晰展示了从原始输入到最终输出的增强链路,强调了每一步操作都伴随着边界框坐标的同步修正。

4.2.2 增强后边界框坐标的同步更新机制

当对图像执行几何变换(如翻转、缩放、裁剪)时,原有的边界框坐标必须相应调整。Albumentations通过内部计算自动完成这一过程。以下是具体调用示例:

# 加载图像与标注

image = cv2.imread("JPEGImages/000005.jpg")

image = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

# 示例标注:两个目标

bboxes = [[23, 21, 178, 196, 14], [94, 17, 196, 195, 14]]

class_labels = [bbox[-1] for bbox in bboxes]

bboxes_no_label = [bbox[:4] for bbox in bboxes]

# 应用增强

transformed = transform(image=image, bboxes=bboxes_no_label, class_labels=class_labels)

# 获取结果

augmented_image = transformed['image']

augmented_bboxes = transformed['bboxes'] # 已更新的坐标

augmented_labels = transformed['class_labels']

# 输出示例

for i, (orig_box, aug_box) in enumerate(zip(bboxes, augmented_bboxes)):

print(f"Object {i}: Original={orig_box[:4]}, Augmented={list(aug_box)}")

参数说明与逻辑分析

bbox_params=A.BboxParams(...)是关键配置:format='pascal_voc'表示输入边界框为Pascal VOC标准格式(即未归一化的像素坐标);label_fields=['class_labels']告知库哪些字段包含类别标签,以便在过滤不可见目标时保留对应类别;min_visibility=0.3表示若某目标在增强后仅剩不到30%面积可见,则将其从输出中剔除,防止产生误导性标签。A.Compose将多个增强操作组合成一个序列,按顺序执行;- 返回的

transformed字典包含更新后的图像与边界框,完全同步。

⚠️ 注意事项:某些增强(如随机裁剪)可能导致部分目标完全移出视野,此时其边界框会被自动移除,同时

class_labels也会相应缩短。因此,在送入模型前需检查len(augmented_bboxes)是否大于0。

4.3 输入数据格式与框架适配(TensorFlow/PyTorch)

不同的深度学习框架对输入数据的组织形式有各自的要求。TensorFlow倾向于使用TFRecord格式进行高效I/O,而PyTorch则偏好动态加载的 Dataset 类。理解这两种范式的特点并掌握其转换方法,是实现高性能训练的关键。

4.3.1 TFRecord格式构建流程与优势分析

TFRecord是TensorFlow专用的二进制序列化格式,具有压缩率高、读取速度快、支持并行加载等优点,特别适合大规模数据集训练。

以下脚本演示如何将 voc_train.txt 转换为TFRecord:

import tensorflow as tf

import numpy as np

from PIL import Image

import io

def _bytes_feature(value):

return tf.train.Feature(bytes_list=tf.train.BytesList(value=[value]))

def _float_feature(value):

return tf.train.Feature(float_list=tf.train.FloatList(value=value))

def _int64_feature(value):

return tf.train.Feature(int64_list=tf.train.Int64List(value=value))

def create_tfexample(img_path, boxes, labels):

img = Image.open(img_path).convert("RGB")

img_bytes = io.BytesIO()

img.save(img_bytes, format='JPEG')

img_encoded = img_bytes.getvalue()

example = tf.train.Example(features=tf.train.Features(feature={

'image/encoded': _bytes_feature(img_encoded),

'image/format': _bytes_feature(b'jpeg'),

'image/filename': _bytes_feature(str.encode(os.path.basename(img_path))),

'image/object/bbox/xmin': _float_feature([b[0]/img.width for b in boxes]),

'image/object/bbox/ymin': _float_feature([b[1]/img.height for b in boxes]),

'image/object/bbox/xmax': _float_feature([b[2]/img.width for b in boxes]),

'image/object/bbox/ymax': _float_feature([b[3]/img.height for b in boxes]),

'image/object/class/label': _int64_feature(labels)

}))

return example

# 写入TFRecord

with tf.io.TFRecordWriter('voc2007_train.tfrecord') as writer:

with open('voc_train.txt', 'r') as f:

current_img = None

boxes, labels = [], []

for line in f:

parts = line.strip().split(',')

img_path = ','.join(parts[:-4]) # 兼容路径含逗号的情况(实际不会)

xmin, ymin, xmax, ymax, cls_id = map(float, parts[-4:])

cls_id = int(cls_id)

if current_img != img_path and current_img is not None:

tf_example = create_tfexample(current_img, boxes, labels)

writer.write(tf_example.SerializeToString())

boxes, labels = [], []

boxes.append([xmin, ymin, xmax, ymax])

labels.append(cls_id)

current_img = img_path

# 写最后一个样本

if current_img:

tf_example = create_tfexample(current_img, boxes, labels)

writer.write(tf_example.SerializeToString())

表格:TFRecord特征字段说明

| 特征键名 | 类型 | 描述 |

|---|---|---|

image/encoded |

bytes | JPEG编码的图像二进制数据 |

image/format |

bytes | 图像格式(’jpeg’) |

image/filename |

bytes | 文件名字符串 |

image/object/bbox/xmin |

float[] | 所有目标的归一化xmin |

image/object/bbox/ymin |

float[] | 所有目标的归一化ymin |

image/object/bbox/xmax |

float[] | 所有目标的归一化xmax |

image/object/bbox/ymax |

float[] | 所有目标的归一化ymax |

image/object/class/label |

int64[] | 对应的类别ID数组 |

该格式可直接配合 tf.data.Dataset 进行高效解码与批处理。

4.3.2 PyTorch Dataset类的自定义实现

在PyTorch中,推荐继承 torch.utils.data.Dataset 类来自定义数据集接口。

import torch

from torch.utils.data import Dataset

from PIL import Image

import pandas as pd

class VOCDataset(Dataset):

def __init__(self, csv_file, transform=None):

self.annotations = pd.read_csv(csv_file, header=None)

self.transform = transform

def __len__(self):

return len(self.annotations)

def __getitem__(self, index):

img_path = self.annotations.iloc[index, 0]

image = Image.open(img_path).convert("RGB")

boxes = []

labels = []

# 因为一行一个目标,需查找同图像的所有行(此处简化为单行单目标)

row = self.annotations.iloc[index]

boxes.append(row[1:5].tolist()) # [x1,y1,x2,y2]

labels.append(int(row[5]))

sample = {

'image': image,

'boxes': torch.tensor(boxes, dtype=torch.float32),

'labels': torch.tensor(labels, dtype=torch.int64)

}

if self.transform:

# 注意:albumentations需要numpy array

sample = self.transform(**sample)

return sample

该类实现了基本的数据加载功能,并支持外部传入增强函数。结合 DataLoader 即可实现多线程异步加载:

dataset = VOCDataset('voc_train.txt', transform=transform)

loader = torch.utils.data.DataLoader(dataset, batch_size=8, collate_fn=lambda x: x)

注:由于每张图像可能有多个目标,

collate_fn需自定义以处理变长标注。

综上所述,无论是构建TFRecord还是实现PyTorch Dataset,核心思想都是将原始标注转化为结构化、可批量处理的张量形式,为后续模型训练奠定坚实基础。

5. Faster R-CNN模型架构搭建(基于TensorFlow/PyTorch)

目标检测任务的核心在于实现对图像中多个对象的准确定位与分类。Faster R-CNN作为两阶段检测器的经典代表,通过引入区域提议网络(RPN),实现了端到端的可训练性,显著提升了检测精度与推理效率。本章将深入剖析Faster R-CNN的整体架构设计,重点围绕主干网络选择、区域提议机制构建以及RoI池化与边界框精调过程展开系统讲解。结合TensorFlow和PyTorch两种主流框架的实现方式,提供从理论到代码层面的完整解析。

5.1 主干网络(Backbone)的选择与特征提取

在Faster R-CNN架构中,主干网络承担着从原始输入图像中提取高层语义特征的关键职责。其输出的特征图将被后续模块(如RPN和RoI Head)用于生成候选框并进行分类与回归。因此,主干网络的设计直接决定了模型的感受野、特征表达能力以及计算复杂度。

5.1.1 VGG16与ResNet在Faster R-CNN中的应用比较

早期Faster R-CNN论文中广泛采用VGG16作为主干网络,因其结构简单且具有良好的梯度传播特性。然而,随着深度学习的发展,ResNet凭借残差连接解决了深层网络训练困难的问题,逐渐成为更优选择。

| 网络类型 | 层数 | 参数量(约) | 感受野大小 | 优点 | 缺点 |

|---|---|---|---|---|---|

| VGG16 | 16 | 138M | 212px | 结构清晰,特征稳定 | 计算开销大,难以扩展 |

| ResNet50 | 50 | 25.6M | 408px | 更深网络,更强表达力 | 需要更多内存优化 |

从感受野角度看,ResNet50能够覆盖更大范围的上下文信息,有助于识别大尺寸物体或遮挡场景下的实例;而VGG16虽然感受野较小,但其卷积堆叠方式使得局部细节保留较好,在小目标检测上表现尚可。

使用PyTorch加载预训练主干网络示例:

import torch

import torchvision.models as models

# 加载预训练VGG16 backbone

vgg16 = models.vgg16(pretrained=True)

backbone_vgg = vgg16.features # 去除最后的全连接层

# 加载预训练ResNet50,并截取前几层作为backbone

resnet50 = models.resnet50(pretrained=True)

backbone_resnet = torch.nn.Sequential(*list(resnet50.children())[:-2]) # 去掉avgpool和fc

代码逻辑逐行解读:

- 第4行:

models.vgg16(pretrained=True)加载ImageNet预训练的VGG16模型。 - 第5行:

.features提取仅包含卷积与池化层的部分,适合作为特征提取器。 - 第8行:

resnet50.children()获取ResNet的所有子模块。 - 第9行:

[:-2]切片操作移除最后两个模块(全局平均池化和全连接层),保留至最后一个卷积块输出。

该设计确保输出特征图为 [C, H', W'] 格式,通常为 C=512~2048 ,空间分辨率约为原图的1/16或1/32,适用于后续RPN处理。

5.1.2 特征图生成过程与感受野分析

特征图是主干网络对输入图像进行多层卷积与下采样后的结果,其每个位置对应原始图像的一个感受野区域。以输入图像尺寸为 600×800 为例,经过VGG16后特征图大小为 37×50 ,步长为16像素。

使用Mermaid流程图展示特征提取路径:

graph TD

A[Input Image 600x800x3] --> B{Conv Layers}

B --> C[VGG16 Block1]

C --> D[VGG16 Block2]

D --> E[VGG16 Block3]

E --> F[VGG16 Block4]

F --> G[VGG16 Block5]

G --> H[Feature Map 37x50x512]

上述流程表明,每一级Block都包含多个卷积层和一个最大池化层,逐步降低空间维度并增加通道数。最终输出的特征图既保留了足够空间信息,又具备强语义表达能力。

感受野计算公式:

RF_{out} = RF_{in} + (k - 1) \times \text{dilation} \times \text{effective_stride}

其中:

- $ k $:当前卷积核大小

- dilation:空洞率(默认为1)

- effective_stride:累积步长乘积

例如,在VGG16中,每经过一次 2×2 max pool ,有效步长翻倍。累计至conv5_3层时,总步长为16,意味着特征图上的一个点对应原图16×16区域。

此外,可通过以下Python函数估算任意网络层的感受野:

def calculate_receptive_field(layers_info):

rf = 1

stride = 1

for kernel_size, layer_stride in layers_info:

rf = rf + (kernel_size - 1) * stride

stride *= layer_stride

return rf, stride

# 示例:模拟VGG前5个block的池化层(每次kernel=2, stride=2)

layers = [(3,1)]*13 + [(2,2)]*5 # 简化表示

rf_total, final_stride = calculate_receptive_field([(2,2)]*5) # 只看pooling影响

print(f"Receptive Field: {rf_total}, Stride: {final_stride}")

参数说明:

-layers_info:列表形式传入(kernel_size, stride)对。

- 函数返回最终感受野大小及累积步长。

- 实际应用中需逐层追踪每个卷积与池化操作的影响。

通过精确控制主干网络结构,可以平衡检测速度与精度需求。例如,在移动端部署时可选用轻量化主干如MobileNetV2,而在高精度场景则倾向使用ResNet101或FPN增强版本。

5.2 区域提议网络(RPN)工作原理与实现

区域提议网络(Region Proposal Network, RPN)是Faster R-CNN的核心创新之一,它替代了传统方法(如Selective Search)生成候选框的过程,实现了高效、可学习的目标建议机制。

5.2.1 Anchor机制的设计思想与多尺度覆盖策略

RPN通过在特征图上滑动一个小网络来预测多个预定义锚框(Anchor)是否包含目标及其偏移量。每个位置生成k个不同尺度和长宽比的Anchor,形成密集先验框集合。

PASCAL VOC设置中常用参数如下:

| 尺度(scale) | 面积(px²) | 长宽比(aspect ratio) | 数量 |

|---|---|---|---|

| 128 | 128² | 1:1 | 1 |

| 256 | 256² | 1:2, 2:1 | 2 |

即每个空间位置生成3种Anchor,共k=9个。这些Anchor映射回原图后覆盖从小到大的各类物体。

Anchor生成逻辑代码示例(PyTorch):

import torch

import numpy as np

def generate_anchors(base_size=16, scales=[8, 16, 32], ratios=[0.5, 1, 2]):

base_area = base_size * base_size

anchors = []

for scale in scales:

area = base_area * (scale ** 2)

for ratio in ratios:

w = int(np.sqrt(area * ratio))

h = int(np.sqrt(area / ratio))

anchors.append([-w//2, -h//2, w//2, h//2]) # cx,cy,w,h → xyxy格式偏移

return torch.tensor(anchors)

# 调用生成基础Anchor模板

anchors = generate_anchors()

print("Generated Anchors (relative to center):", anchors.shape)

参数说明:

-base_size=16:对应主干网络的总下采样倍数。

-scales:缩放因子,决定Anchor的实际尺寸。

-ratios:长宽比例组合。

- 输出为相对于中心点的坐标偏移(左上x,y,右下x,y)。

随后,该Anchor模板在整个特征图网格上平铺,形成所有可能的候选框。

5.2.2 RPN中的分类与回归分支结构实现

RPN由共享卷积特征基础上分出两个子网络:

- 分类分支 :判断每个Anchor是否为前景(object)或背景(background)。

- 回归分支 :修正Anchor的位置,使其更贴近真实边界框(GT Box)。

结构示意如下表:

| 分支 | 输入 | 输出维度 | 损失函数 |

|---|---|---|---|

| 分类 | 512×H×W特征 | 2k × H × W | 二元交叉熵 |

| 回归 | 512×H×W特征 | 4k × H × W | Smooth L1 Loss |

PyTorch实现片段:

class RPNHead(torch.nn.Module):

def __init__(self, in_channels=512, num_anchors=9):

super().__init__()

self.conv = torch.nn.Conv2d(in_channels, 512, 3, padding=1)

self.cls_logits = torch.nn.Conv2d(512, num_anchors * 2, 1)

self.bbox_pred = torch.nn.Conv2d(512, num_anchors * 4, 1)

def forward(self, x):

t = torch.relu(self.conv(x))

logits = self.cls_logits(t)

bbox_deltas = self.bbox_pred(t)

return logits, bbox_deltas

# 初始化RPN头部

rpn_head = RPNHead(num_anchors=9)

feature_map = torch.randn(1, 512, 37, 50) # 模拟VGG输出

cls_logits, bbox_deltas = rpn_head(feature_map)

代码解释:

- 第4行:in_channels=512来自主干输出通道数。

- 第6–7行:两个1×1卷积分别输出分类得分与边界框偏移。

- 第12行:输入特征图形状为(B,C,H,W),经RPN后得到(B, 18, H, W)和(B, 36, H, W)。

此结构允许并行预测所有Anchor的状态,极大提升效率。

5.2.3 正负样本定义与损失计算方式

为了训练RPN,需根据Anchor与真实框之间的IoU(交并比)分配标签:

- IoU > 0.7 → 正样本(前景)

- IoU < 0.3 → 负样本(背景)

- 其余忽略

使用TensorFlow实现正负样本筛选:

import tensorflow as tf

def compute_rpn_targets(anchor_boxes, gt_boxes, iou_threshold_pos=0.7, iou_threshold_neg=0.3):

ious = tf.py_function(compute_iou, [anchor_boxes, gt_boxes], tf.float32)

max_iou_per_anchor = tf.reduce_max(ious, axis=1)

labels = tf.where(max_iou_per_anchor > iou_threshold_pos, 1.0,

tf.where(max_iou_per_anchor < iou_threshold_neg, 0.0, -1.0))

# 限制正负样本比例(如1:1)

num_pos = tf.minimum(128, tf.cast(tf.reduce_sum(labels == 1), tf.int32))

pos_idx = tf.random.shuffle(tf.where(labels == 1))[:num_pos]

neg_idx = tf.random.shuffle(tf.where(labels == 0))[:256-num_pos]

final_labels = tf.scatter_nd(pos_idx, tf.ones(num_pos), tf.shape(labels))

final_labels += tf.scatter_nd(neg_idx, tf.zeros_like(neg_idx[:,0], dtype=tf.float32), tf.shape(labels))

return final_labels

# 假设anchor_boxes为[N,4], gt_boxes为[M,4]

labels = compute_rpn_targets(anchors, gt_boxes)

逻辑分析:

-compute_iou为自定义IoU计算函数。

-tf.where实现三段式标签赋值。

-scatter_nd用于构造稀疏更新张量,保证正负样本均衡。

最终损失为分类损失与回归损失加权和:

L_{RPN} = \lambda L_{cls} + L_{reg}

其中 $\lambda$ 通常设为10以平衡两项量级差异。

5.3 RoI池化与边界框精调机制

在RPN生成候选区域后,Faster R-CNN进入第二阶段——RoI Pooling与Fast R-CNN头部处理,完成最终分类与精确定位。

5.3.1 RoI Pooling层的工作流程与梯度传播特性

RoI Pooling的作用是将不同大小的候选框映射为固定尺寸的特征向量(如7×7),以便送入全连接层处理。

流程如下:

1. 接收特征图和一组RoI(由RPN输出);

2. 将RoI坐标按主干步长缩放到特征图尺度;

3. 将每个RoI划分为 H×W 子区域;

4. 在每个子区域执行Max Pooling;

5. 输出统一大小的特征块。

graph LR

A[Feature Map] --> B[RPN Proposals]

B --> C{RoI Align/Pool}

C --> D[Fixed-size Features 7x7]

D --> E[Fully Connected Layers]

自定义RoI Pooling实现(PyTorch):

from torchvision.ops import roi_pool

pooled_features = roi_pool(feature_map, proposals, output_size=(7,7), spatial_scale=1/16)

spatial_scale=1/16表示特征图相对于原图缩小了16倍。proposals格式为[batch_ind, x1, y1, x2, y2],需归一化处理。

相比原始RoI Pooling带来的量化误差,后续改进版RoI Align通过双线性插值避免位置偏移,进一步提升小目标检测性能。

5.3.2 Fast R-CNN头部网络的双任务输出设计

Fast R-CNN头部分为两个分支:

- 分类分支 :输出K+1类概率(含背景);

- 回归分支 :输出K×4个边界框微调参数(每类独立调整)。

class FastRCNNHead(torch.nn.Module):

def __init__(self, in_features=2048, num_classes=21):

super().__init__()

self.fc6 = torch.nn.Linear(in_features, 1024)

self.fc7 = torch.nn.Linear(1024, 1024)

self.cls_score = torch.nn.Linear(1024, num_classes)

self.bbox_pred = torch.nn.Linear(1024, num_classes * 4)

def forward(self, x):

x = torch.relu(self.fc6(x))

x = torch.relu(self.fc7(x))

cls_logit = self.cls_score(x)

bbox_delta = self.bbox_pred(x)

return cls_logit, bbox_delta

参数说明:

-in_features=2048来自RoI Pooling展平后的特征。

-num_classes=21包含20个VOC类别+1个背景类。

-bbox_pred输出维度为num_classes * 4,实现类别相关回归。

最终通过Softmax分类,并结合NMS(非极大抑制)去除冗余检测框,输出高质量检测结果。

整个Faster R-CNN架构由此完成从特征提取到精准定位的闭环流程,奠定了现代两阶段检测器的基础范式。

6. 模型训练流程与性能评估体系构建

目标检测系统的有效性不仅取决于网络结构的设计,更依赖于完整的训练流程与科学的性能评估机制。在基于VOC2007数据集训练Faster R-CNN这类两阶段检测器时,必须建立从损失函数优化、超参数调控到最终量化评估的闭环体系。本章将深入剖析多任务联合训练中的损失设计原理,系统阐述训练过程中的关键策略选择,并重点介绍如何通过官方评测脚本 voc_eval.py 准确计算平均精度(AP)与平均mAP指标。整个流程涉及大量可调参数与中间输出格式规范,需结合代码实现与理论分析同步推进。

6.1 损失函数设计:分类与回归联合优化

现代目标检测模型普遍采用多任务学习框架,在同一前向传播过程中同时完成类别预测与边界框定位。Faster R-CNN正是这一思想的经典体现,其整体损失由多个子损失加权组合而成,涵盖RPN阶段和Fast R-CNN头部两个主要部分。理解这些损失项的设计逻辑及其数学表达形式,是实现稳定训练的前提。

6.1.1 多任务损失函数的加权组合策略

Faster R-CNN的整体损失函数是一个分层加权结构,分别作用于区域提议网络(RPN)和后续的RoI分类与回归模块。以标准实现为例,总损失可表示为:

\mathcal{L} = \lambda_1 \cdot \mathcal{L} {RPN} + \lambda_2 \cdot \mathcal{L} {head}

其中 $\mathcal{L} {RPN}$ 表示RPN部分的损失,$\mathcal{L} {head}$ 为RoI头部的损失,$\lambda_1$ 和 $\lambda_2$ 是平衡系数,通常设为1以保持各阶段贡献均衡。

进一步分解,每个子模块又包含分类损失 $\mathcal{L} {cls}$ 与回归损失 $\mathcal{L} {reg}$:

\mathcal{L} {module} = \frac{1}{N {cls}} \mathcal{L} {cls} + \lambda \frac{1}{N {reg}} \mathcal{L}_{reg}

这里的 $N_{cls}$ 和 $N_{reg}$ 分别代表参与分类和回归计算的样本数量,用于归一化;$\lambda$ 控制定位误差的相对权重,常见取值为1或10,具体取决于实现方式。

这种加权机制的核心目的在于防止某一任务主导梯度更新。例如,若不进行归一化处理,回归损失可能因数值较大而掩盖分类信号,导致模型无法有效区分前景与背景anchor。

| 损失类型 | 数学公式 | 用途说明 |

|---|---|---|

| RPN分类损失 | $-\sum_i t_i \log(p_i)$ | 判断anchor是否包含物体 |

| RPN回归损失 | $\sum_i L_{smooth}(t_i^u, v_i)$ | 调整正样本anchor的位置偏移 |

| RoI分类损失 | 交叉熵损失 | 预测RoI所属的具体类别 |

| RoI回归损失 | Smooth L1 | 精修最终边界框坐标 |

表:Faster R-CNN中各阶段损失函数组成

该表格清晰展示了不同层级的任务划分与对应损失函数的选择依据。值得注意的是,所有回归任务均使用Smooth L1而非MSE,因其对异常值更具鲁棒性。

import torch

import torch.nn as nn

class MultiTaskLoss(nn.Module):

def __init__(self, lambda_rpn=1.0, lambda_head=1.0, reg_weight=10.0):

super(MultiTaskLoss, self).__init__()

self.lambda_rpn = lambda_rpn

self.lambda_head = lambda_head

self.reg_weight = reg_weight

self.cls_loss_fn = nn.CrossEntropyLoss(reduction='none')

self.reg_loss_fn = nn.SmoothL1Loss(reduction='sum')

def forward(self, rpn_cls_logits, rpn_reg_pred, rpn_reg_targets,

roi_cls_logits, roi_reg_pred, roi_reg_targets,

rpn_labels, roi_labels):

# RPN 分类损失

rpn_cls_loss = self.cls_loss_fn(rpn_cls_logits, rpn_labels)

rpn_cls_loss = rpn_cls_loss[rpn_labels >= 0].mean() # 忽略-1标签

# RPN 回归损失(仅对正样本)

pos_indices = (rpn_labels == 1)

if pos_indices.sum() > 0:

rpn_reg_loss = self.reg_loss_fn(rpn_reg_pred[pos_indices],

rpn_reg_targets[pos_indices])

rpn_reg_loss /= pos_indices.sum() # 归一化

else:

rpn_reg_loss = 0.0

# 整合RPN损失

rpn_loss = rpn_cls_loss + self.reg_weight * rpn_reg_loss

# RoI 分类损失

roi_cls_loss = self.cls_loss_fn(roi_cls_logits, roi_labels).mean()

# RoI 回归损失(仅对正例)

pos_roi = (roi_labels > 0)

if pos_roi.sum() > 0:

roi_reg_loss = self.reg_loss_fn(roi_reg_pred[pos_roi],

roi_reg_targets[pos_roi])

roi_reg_loss /= pos_roi.sum()

else:

roi_reg_loss = 0.0

# 总损失加权求和

total_loss = (self.lambda_rpn * rpn_loss +

self.lambda_head * (roi_cls_loss + self.reg_weight * roi_reg_loss))

return {

'total_loss': total_loss,

'rpn_cls_loss': rpn_cls_loss.item(),

'rpn_reg_loss': rpn_reg_loss.item() if isinstance(rpn_reg_loss, torch.Tensor) else rpn_reg_loss,

'roi_cls_loss': roi_cls_loss.item(),

'roi_reg_loss': roi_reg_loss.item() if isinstance(roi_reg_loss, torch.Tensor) else roi_reg_loss

}

代码块:PyTorch实现Faster R-CNN多任务联合损失函数

逐行逻辑分析:

- 第4–8行:初始化类成员变量,定义分类与回归损失函数。 reduction='none' 保留原始损失以便筛选。

- 第13–15行:RPN分类损失仅对非忽略样本(≥0)求平均,排除无效anchor的影响。

- 第18–23行:回归损失只应用于正样本(label=1),避免噪声干扰,并按正样本数归一化。

- 第30–33行:RoI分类损失直接使用交叉熵,但同样过滤掉负标签。

- 第36–41行:类似地,RoI回归也限于正类别实例。

- 第45–47行:最终损失按预设权重合并,返回各项便于监控训练动态。

此设计确保了分类与回归任务之间的平衡,避免某一项过度主导训练方向。实际应用中可通过TensorBoard可视化各损失项变化趋势,辅助调试。

6.1.2 Smooth L1损失与交叉熵损失的协同作用

在目标检测中,Smooth L1损失被广泛用于边界框回归任务,相较于传统的L2损失(MSE),它在小误差范围内表现得像L2,在大误差时退化为L1,从而减少离群点对梯度的影响。

其数学定义如下:

L_{smooth}(x) =

\begin{cases}

0.5 x^2 & \text{if } |x| < 1 \

|x| - 0.5 & \text{otherwise}

\end{cases}

该函数在 $x=1$ 处连续且可导,适合反向传播。相比MSE,它不会因个别难样本产生过大梯度,有助于提升训练稳定性。

交叉熵损失则用于衡量预测概率分布与真实标签之间的差异:

\mathcal{L} {cls} = -\sum {c=1}^{C} y_c \log(\hat{y}_c)

其中 $y_c$ 为one-hot编码的真实标签,$\hat{y}_c$ 为softmax输出的概率。

两者协同工作的关键是 梯度比例协调 。由于分类损失通常较小(如0.x级别),而回归损失初始值可能高达几十甚至上百,若不加以控制,会导致优化器优先降低回归误差,忽视分类准确性。

因此引入以下策略:

- 对回归损失除以正样本数量进行归一化;

- 设置调节因子 $\lambda$(常取10)放大分类损失影响;

- 使用Adam等自适应优化器自动调整学习率尺度。

graph TD

A[输入特征图] --> B[RPN分支]

A --> C[RoI Pooling]

B --> D[Anchor生成]

D --> E[分类得分 + 偏移量]

E --> F[计算RPN损失<br>分类: CrossEntropy<br>回归: SmoothL1]

C --> G[Fast R-CNN Head]

G --> H[类别预测 + 边界框精调]

H --> I[计算Head损失<br>分类: CrossEntropy<br>回归: SmoothL1]

F --> J[加权总损失]

I --> J

J --> K[反向传播更新参数]

流程图:Faster R-CNN中损失函数的计算路径

该图展示了从主干网络输出到最终损失聚合的完整链路。可见RPN与Head各自独立计算损失后再汇总,体现了模块化设计理念。

综上所述,合理设计损失函数不仅能提高模型收敛速度,还能显著改善最终检测性能。实践中应结合验证集AP变化情况微调损失权重配置。

6.2 模型训练流程与超参数设置

训练深度学习模型并非简单地运行几个epoch即可达成理想效果,尤其对于Faster R-CNN这类复杂架构,训练流程的设计直接影响模型的泛化能力和最终精度。

6.2.1 学习率调度、批量大小与迭代次数设定原则

成功的训练始于合理的超参数配置。以下是针对VOC2007上训练Faster R-CNN的典型设置建议:

| 超参数 | 推荐值 | 说明 |

|---|---|---|

| 批量大小(Batch Size) | 1–2 images/GPU | 受限于显存,常用多卡同步BN模拟大batch |

| 初始学习率 | 0.001(SGD)或 1e-4(Adam) | SGD需更大lr,Adam更稳定 |

| 学习率衰减策略 | Step Decay 或 Cosine Annealing | 每30k–50k步下降×0.1 |

| 迭代总数 | 70k–120k iterations | VOC2007约需6–10个epoch |

| 动量(Momentum) | 0.9 | 加速收敛 |

| 权重衰减(Weight Decay) | 0.0001 | 防止过拟合 |

表:Faster R-CNN在VOC2007上的推荐超参数配置

训练初期应采用较低学习率进行“热身”(warm-up),例如前1k iterations线性递增至目标值,以防梯度爆炸。

学习率调度方面,常见的有两种方式:

- Step Decay :每固定步数乘以衰减因子(如0.1)

- Cosine Annealing :平滑下降至接近零

from torch.optim.lr_scheduler import StepLR, CosineAnnealingLR

# 示例:使用StepLR进行学习率调度

optimizer = torch.optim.SGD(model.parameters(), lr=0.001, momentum=0.9, weight_decay=5e-4)

scheduler = StepLR(optimizer, step_size=50000, gamma=0.1)

for epoch in range(num_epochs):

for batch in dataloader:

optimizer.zero_grad()

loss = model(batch)

loss.backward()

optimizer.step()

scheduler.step() # 每轮结束后更新学习率

代码块:PyTorch中实现学习率调度

参数说明:

- step_size=50000 :表示每5万次迭代降低一次学习率;

- gamma=0.1 :学习率乘以0.1;

- scheduler.step() 放在epoch循环内,也可放在每次iteration后实现更细粒度控制。

此外, 冻结主干网络 是迁移学习中的重要技巧。通常做法是:

- 前1–2万个iteration冻结backbone(如VGG16/ResNet);

- 后续解冻并以更低学习率微调(如原lr的1/10);

这样做既能保护预训练特征提取能力,又能适配新数据分布。

6.2.2 冻结主干网络与微调策略的时间节点选择

在使用ImageNet预训练权重初始化主干网络的情况下,直接全网络训练容易破坏已有良好特征表示。因此推荐分阶段训练策略:

阶段一:冻结backbone,仅训练RPN与Head(约20k iterations)

# 冻结主干网络参数

for param in model.backbone.parameters():

param.requires_grad = False

# 只优化RPN和检测头

optimizer = torch.optim.SGD(filter(lambda p: p.requires_grad, model.parameters()),

lr=0.001, momentum=0.9)

阶段二:解冻backbone,整体微调(剩余iterations)

# 解锁主干网络

for param in model.backbone.parameters():

param.requires_grad = True

# 使用较小学习率进行微调

for param_group in optimizer.param_groups:

param_group['lr'] = 0.0001 # 降为原来的1/10

该策略已被证明能显著提升收敛速度与最终性能。实验表明,在VOC2007上采用此方法可使mAP提升2–3个百分点。

gantt

title Faster R-CNN 训练阶段划分

dateFormat X

axisFormat %d0k

section 冻结训练

RPN + Head Training :a1, 0, 20000

section 微调阶段

Full Model Fine-tuning :a2, after a1, 100000

section 学习率变化

LR = 0.001 : 0, 20000

LR = 0.0001 : 20000, 100000

甘特图:Faster R-CNN两阶段训练流程与学习率切换时间点

该图直观呈现了训练周期的阶段性安排及对应的学习率调整时机。

综上,科学的训练流程设计包括合理的批大小、学习率调度与参数冻结策略。这些细节虽不起眼,却极大影响模型最终表现。

6.3 使用voc_eval.py进行性能评估

训练完成后,必须通过标准化评估手段验证模型性能。PASCAL VOC提供官方评测脚本 voc_eval.py ,用于计算各类别的AP(Average Precision)及整体mAP(mean Average Precision)。

6.3.1 检测结果文件(.txt)的格式规范与生成方式

要使用 voc_eval.py ,首先需将模型输出转换为指定格式的文本文件。每一类生成一个 .txt 文件,存放该类别在所有测试图像上的检测结果。

文件命名规则:

comp4_det_test_<class_name>.txt

例如: comp4_det_test_car.txt

每行记录格式:

image_id confidence x1 y1 x2 y2

字段含义如下:

- image_id :图像ID(如000001)

- confidence :置信度分数(0~1)

- x1,y1,x2,y2 :检测框坐标(左上+右下)

def write_detection_results(results, output_dir, class_names):

"""

将模型输出写入VOC评估格式文件

results: list of dict, each contains 'boxes', 'scores', 'labels', 'image_id'

"""

os.makedirs(output_dir, exist_ok=True)

# 初始化每个类别的结果列表

class_results = {cls: [] for cls in class_names}

for res in results:

img_id = res['image_id']

boxes = res['boxes'].cpu().numpy()

scores = res['scores'].cpu().numpy()

labels = res['labels'].cpu().numpy()

for box, score, label in zip(boxes, scores, labels):

cls_name = class_names[label]

line = f"{img_id} {score:.6f} {box[0]:.2f} {box[1]:.2f} {box[2]:.2f} {box[3]:.2f}"

class_results[cls_name].append(line)

# 写入每个类别的文件

for cls_name, lines in class_results.items():

with open(os.path.join(output_dir, f"comp4_det_test_{cls_name}.txt"), "w") as f:

f.write("\n".join(lines))

代码块:生成符合VOC评估格式的结果文件

参数说明:

- results :模型推理输出的集合,每个元素含检测框、置信度、标签和图像ID;

- output_dir :保存目录;

- class_names :类别名称列表,如[‘aeroplane’, ‘bicycle’, …];

该函数会为每个类别创建单独文件,供后续评估调用。

6.3.2 AP与mAP的计算流程与结果解读

AP(Average Precision)基于PR曲线(Precision-Recall Curve)计算,具体步骤如下:

- 按置信度降序排列检测结果;

- 计算每个阈值下的精确率(Precision)与召回率(Recall);

- 使用11点插值法或全体点积分法求AP;

- 对所有类别求平均得mAP。

def voc_ap(rec, prec, use_07_metric=False):

"""Compute VOC AP given precision and recall."""

if use_07_metric:

ap = 0.

for t in np.arange(0., 1.1, 0.1):

if np.sum(rec >= t) == 0:

p = 0

else:

p = np.max(prec[rec >= t])

ap += p / 11.

else:

mrec = np.concatenate(([0.], rec, [1.]))

mpre = np.concatenate(([0.], prec, [0.]))

for i in range(mpre.size - 1, 0, -1):

mpre[i - 1] = np.maximum(mpre[i - 1], mpre[i])

ap = np.trapz(mpre, mrec) # 数值积分

return ap

代码块:AP计算函数(简化版)

逻辑解析:

- 若启用 use_07_metric=True ,则采用PASCAL VOC 2007的11点插值法;

- 否则使用连续积分法(VOC 2010以后标准);

- np.trapz 实现梯形法则近似面积积分;

最终mAP即为所有类别AP的算术平均:

\text{mAP} = \frac{1}{C} \sum_{c=1}^{C} \text{AP}_c

| 类别 | AP (%) |

|---|---|

| aeroplane | 78.2 |

| bicycle | 81.5 |

| bird | 72.3 |

| … | … |

| tvmonitor | 76.8 |

| mAP | 76.4 |

表:某次Faster R-CNN在VOC2007 test上的评估结果示例

此类表格可用于分析模型在哪些类别上表现优异或存在短板,进而指导数据增强或类别加权策略调整。

综上,完整的评估流程包括结果文件生成、PR曲线绘制与AP/mAP计算。这是验证模型真实性能不可或缺的一环。

7. 目标检测全流程实战:从数据到评估

7.1 数据准备与训练集划分

在正式进入模型训练之前,必须完成对VOC2007数据集的系统性组织与格式转换。首先确认 VOCdevkit/VOC2007/ 目录结构完整,包含 JPEGImages 、 Annotations 、 ImageSets/Main 等关键子目录。其中, ImageSets/Main/trainval.txt 是训练验证集的图像ID列表,共包含16,551张图像(train: 5,011, val: 5,823, trainval: 10,834),测试集 test.txt 含4,952张图像。

我们通过以下Python脚本读取训练图像列表并构建绝对路径:

import os

voc_root = '/path/to/VOCdevkit/VOC2007'

image_ids = []

with open(os.path.join(voc_root, 'ImageSets/Main/trainval.txt'), 'r') as f:

image_ids = [line.strip() for line in f.readlines()]

# 构建图像和标注文件路径

image_paths = [os.path.join(voc_root, 'JPEGImages', img_id + '.jpg') for img_id in image_ids]

annot_paths = [os.path.join(voc_root, 'Annotations', img_id + '.xml') for img_id in image_ids]

该过程确保后续数据加载器能准确索引每一张图像及其对应XML标注。

7.2 XML标注解析与训练样本生成

接下来需要从XML中提取边界框和类别信息。使用 xml.etree.ElementTree 进行结构化解析:

import xml.etree.ElementTree as ET

def parse_voc_xml(annot_path):

tree = ET.parse(annot_path)

root = tree.getroot()

objects = []

for obj in root.findall('object'):

name = obj.find('name').text.lower().strip()

bbox = obj.find('bndbox')

xmin = int(bbox.find('xmin').text)

ymin = int(bbox.find('ymin').text)

xmax = int(bbox.find('xmax').text)

ymax = int(bbox.find('ymax').text)

objects.append({'class': name, 'bbox': [xmin, ymin, xmax, ymax]})

return objects

将所有样本整合为统一训练格式(如YOLO风格或Faster R-CNN所需格式):

| image_id | class_name | xmin | ymin | xmax | ymax |

|---|---|---|---|---|---|

| 000005 | aero | 111 | 101 | 280 | 255 |

| 000005 | person | 163 | 238 | 200 | 275 |

| 000007 | car | 134 | 178 | 234 | 226 |

| 000009 | person | 109 | 82 | 313 | 398 |

| 000010 | cat | 98 | 107 | 283 | 377 |

| 000012 | bird | 74 | 98 | 155 | 187 |

| 000014 | dog | 148 | 98 | 304 | 311 |

| 000016 | bus | 9 | 108 | 317 | 279 |

| 000017 | horse | 105 | 96 | 314 | 374 |

| 000018 | bottle | 185 | 79 | 266 | 195 |

此表可用于构建 voc_train.txt 标准输入文件,每行格式如下:

/path/to/VOC2007/JPEGImages/000005.jpg 0,111,101,280,255,0 1,163,238,200,275,14

其中数字分别表示类别索引、坐标及分类ID。

7.3 模型训练执行流程

基于PyTorch实现的Faster R-CNN训练主循环示例如下:

from torchvision.models.detection import fasterrcnn_resnet50_fpn

import torch

model = fasterrcnn_resnet50_fpn(pretrained=True)

model.train()

optimizer = torch.optim.SGD(model.parameters(), lr=0.001, momentum=0.9, weight_decay=5e-4)

for epoch in range(20):

for images, targets in dataloader:

images = [img.to(device) for img in images]

targets = [{k: v.to(device) for k, v in t.items()} for t in targets]

loss_dict = model(images, targets)

losses = sum(loss for loss in loss_dict.values())

optimizer.zero_grad()

losses.backward()

optimizer.step()

print(f"Epoch {epoch}, Loss: {losses.item()}")

训练过程中需监控RPN分类损失 rpn_cls_loss 与回归损失 rpn_box_reg ,若初期不下降,可检查学习率是否过高或标签匹配策略是否有误。

7.4 性能评估与mAP计算

调用官方 voc_eval.py 脚本前,需生成符合格式的检测结果文件。每个类别输出一个 .txt 文件,如 comp3_det_test_aeroplane.txt ,内容为:

000001 0.9876 112 103 278 252

000003 0.9643 145 180 235 225

字段依次为图像ID、置信度、边界框坐标。

使用Matlab运行评测脚本:

cd ./VOCcode

main('test');

输出各分类AP值与总体mAP,典型结果如下:

| Class | AP (%) |

|---|---|

| aeroplane | 72.3 |

| bicycle | 78.9 |

| bird | 63.4 |

| boat | 55.1 |

| bottle | 38.2 |

| bus | 76.8 |

| car | 81.7 |

| cat | 79.6 |

| chair | 45.3 |

| cow | 70.1 |

| diningtable | 68.9 |

| dog | 77.5 |

| horse | 79.8 |

| motorbike | 76.2 |

| person | 74.6 |

| pottedplant | 36.7 |

| sheep | 68.4 |

| sofa | 67.1 |

| train | 78.3 |

| tvmonitor | 69.5 |

| mAP | 69.6 |

结合混淆矩阵分析误检情况,发现 bottle 与 pottedplant 因小目标且背景复杂导致检测性能偏低。

7.5 常见问题诊断与优化建议

当出现“loss不下降”时,应检查:

- 数据路径是否正确,图像能否正常加载

- 标注坐标是否越界或反序(xmin > xmax)

- 正负样本比例是否失衡(建议RPN正负比≈1:1)

对于RPN提案质量差的问题,可通过调整anchor尺度与长宽比适配VOC2007目标分布:

from torchvision.models.detection.rpn import AnchorGenerator

anchor_sizes = ((32,), (64,), (128,), (256,), (512,))

aspect_ratios = ((0.5, 1.0, 2.0),) * len(anchor_sizes)

anchor_generator = AnchorGenerator(sizes=anchor_sizes, aspect_ratios=aspect_ratios)

此外,在训练后期出现过拟合时,可启用早停机制或增加Dropout层,并采用余弦退火学习率调度提升收敛稳定性。

graph TD

A[开始] --> B[加载VOC2007数据]

B --> C[解析XML标注]

C --> D[生成训练文件]

D --> E[构建Faster R-CNN模型]

E --> F[训练模型]

F --> G[生成检测结果]

G --> H[调用voc_eval.py]

H --> I[输出mAP与AP]

I --> J[分析性能瓶颈]

J --> K[优化策略迭代]

简介:本文深入解析VOC2007数据集的核心工具包VOCdevkit2007,涵盖其文件结构与在Faster R-CNN目标检测模型训练中的关键作用。文章介绍如何利用Annotations、ImageSets、JPEGImages等目录进行数据准备,并通过Python脚本将XML标注转换为模型可读格式。结合TensorFlow或PyTorch框架,详细阐述RPN区域提议、分类回归训练及mAP评估全过程,帮助开发者掌握从数据预处理到模型评估的完整目标检测实践流程。

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)