基于卷积神经网络的野生保护动物识别系统,resnet50,vgg16,resnet34模型【pytorch框架+python源码,Django框架】

摘要:本文介绍了一个基于卷积神经网络的野生保护动物识别系统,采用PyTorch框架实现,包含ResNet50、VGG16和ResNet34三种可选模型。项目提供完整代码、数据集、预训练模型及Web界面(Vue+Django)。系统支持模型训练、测试和性能评估,提供准确率曲线、混淆矩阵等可视化指标。用户可通过前端界面进行动物分类识别并查看历史记录。项目结构清晰,包含详细配置说明和核心代码示例,为野生

更多目标检测、图像分类识别、目标追踪、图像检索等项目可看我主页其他文章

功能演示(看 shi pin 简介):

(一)简介

基于卷积神经网络的野生保护动物识别系统是在pytorch框架下实现的,这是一个完整的项目,包括代码,数据集,训练好的模型权重,模型训练记录,Web前端界面和各种模型指标图表等。

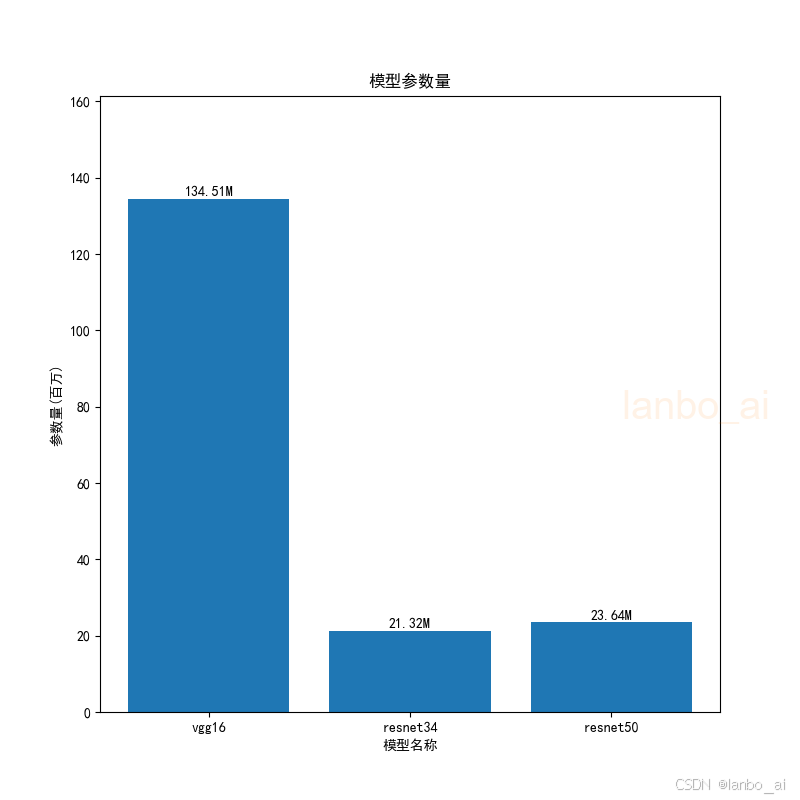

该项目有3个可选模型:resnet50,vgg16,resnet34,3个模型都在项目中,随便用一个即可,也可以三个都用,可做对比分析,增加工作量。

前端界面由vue,css,html设计实现,后端由Django框架实现。

该项目可在pycharm和anaconda搭建的虚拟环境运行

pycharm和anaconda安装和配置可观看教程:

超详细的pycharm+anaconda搭建python虚拟环境_pycharm虚拟环境搭建-CSDN博客

(二)项目介绍

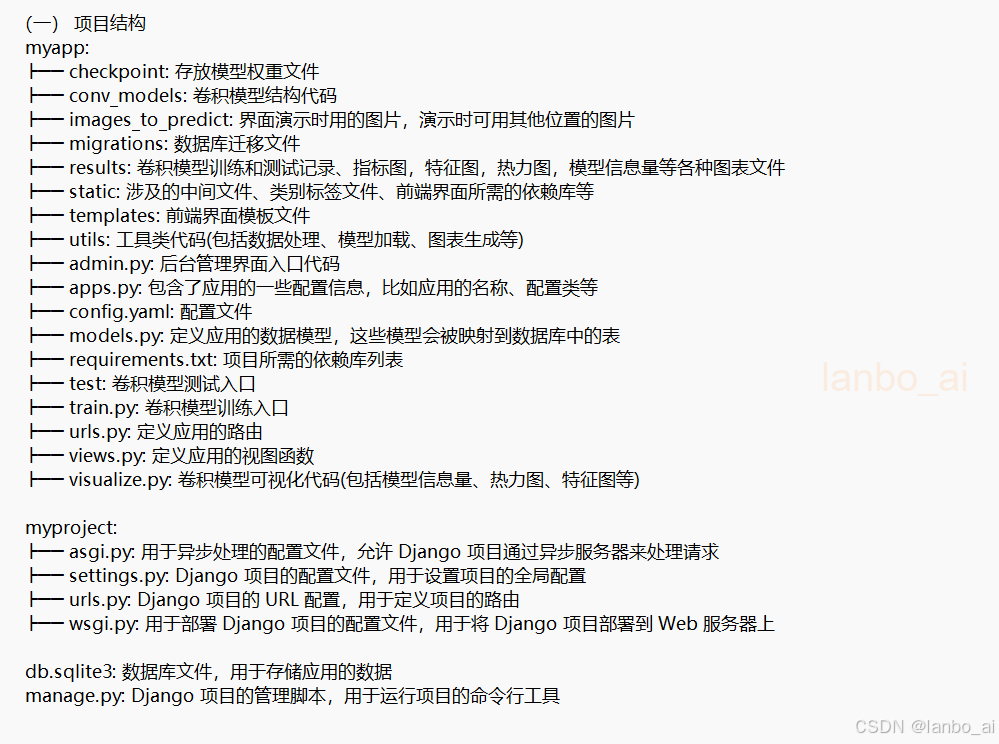

1. 项目结构

该项目可以使用已经训练好的模型权重,也可以自己重新训练,自己训练也比较简单

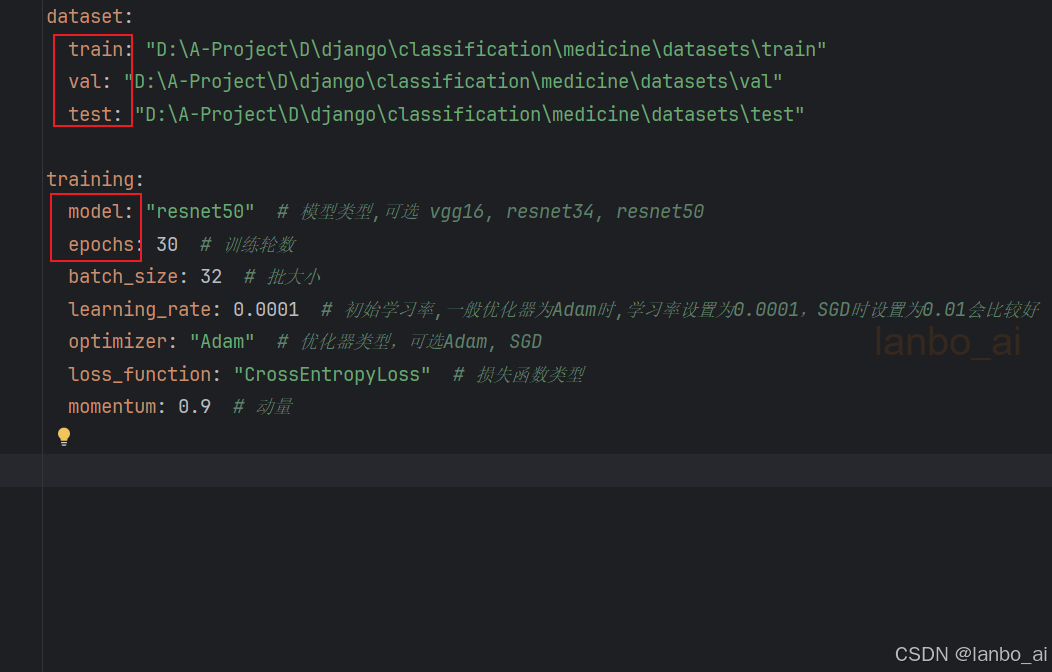

第一步:修改config.yaml的数据集路径(训练集、验证集、测试集),模型名称、模型训练的轮数

第二步:模型训练,即直接运行train.py文件可进行模型训练

第三步:模型测试,即直接运行test.py文件可进行模型测试

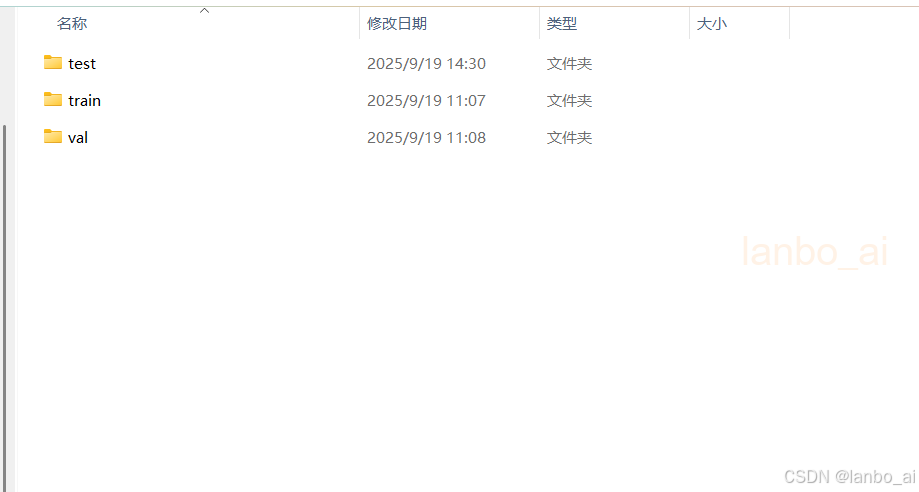

2. 数据结构

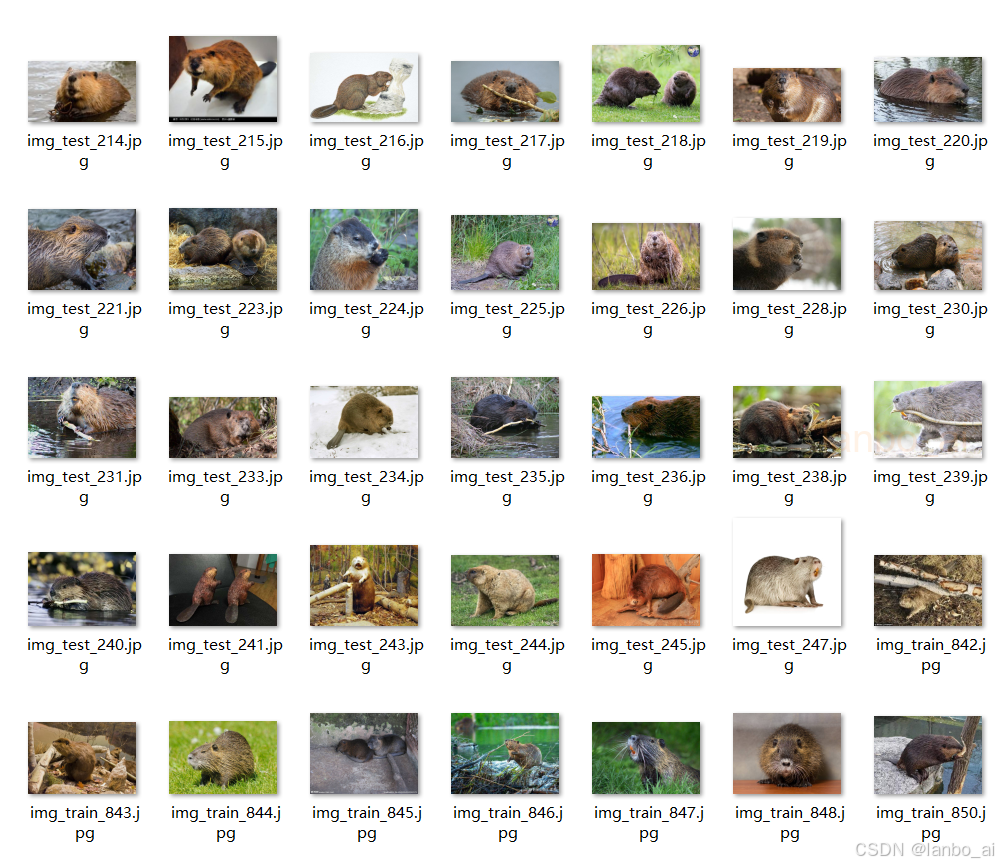

部分数据展示:

3.Web前端界面(技术栈:python+opencv+Django+vue3)

1)初始界面

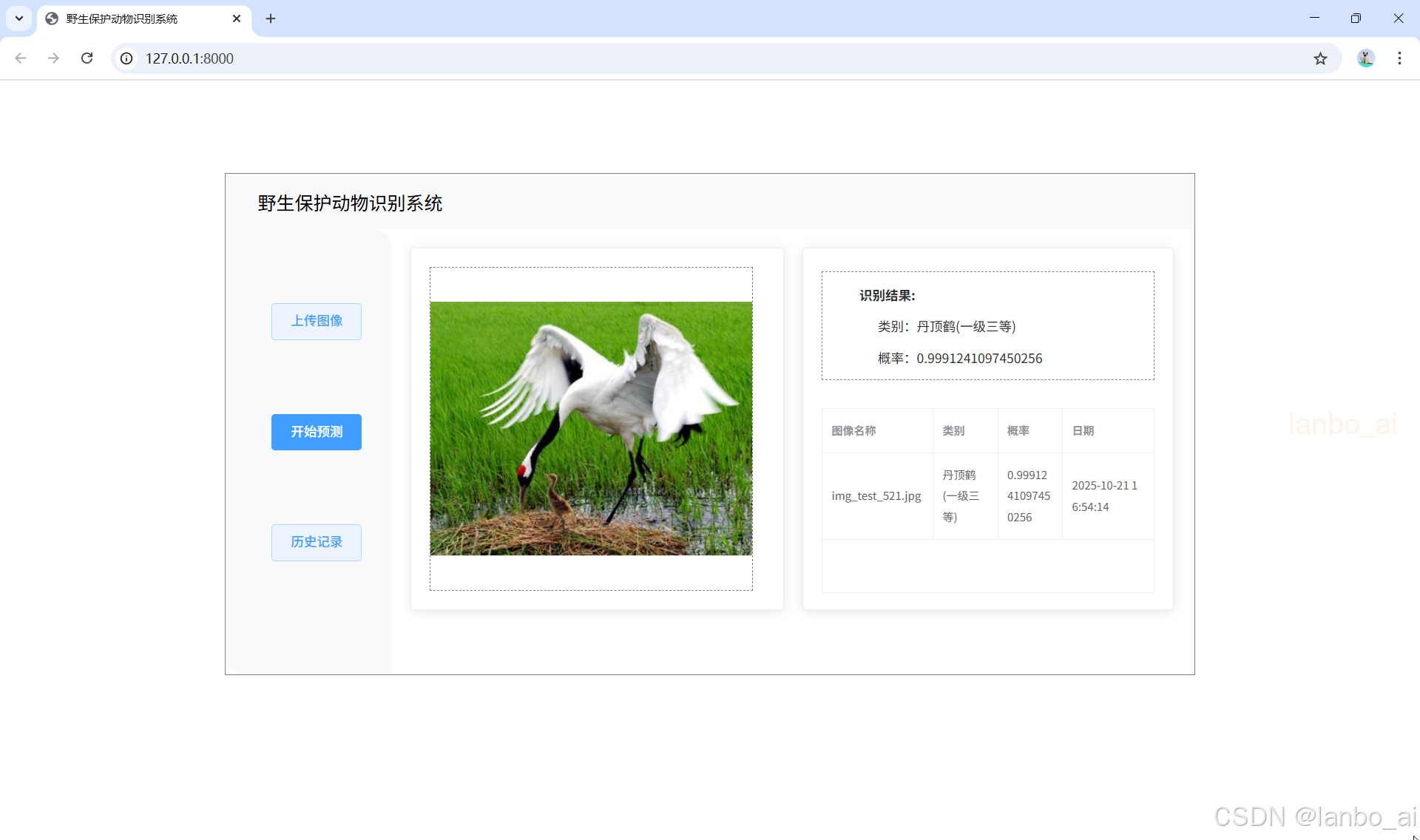

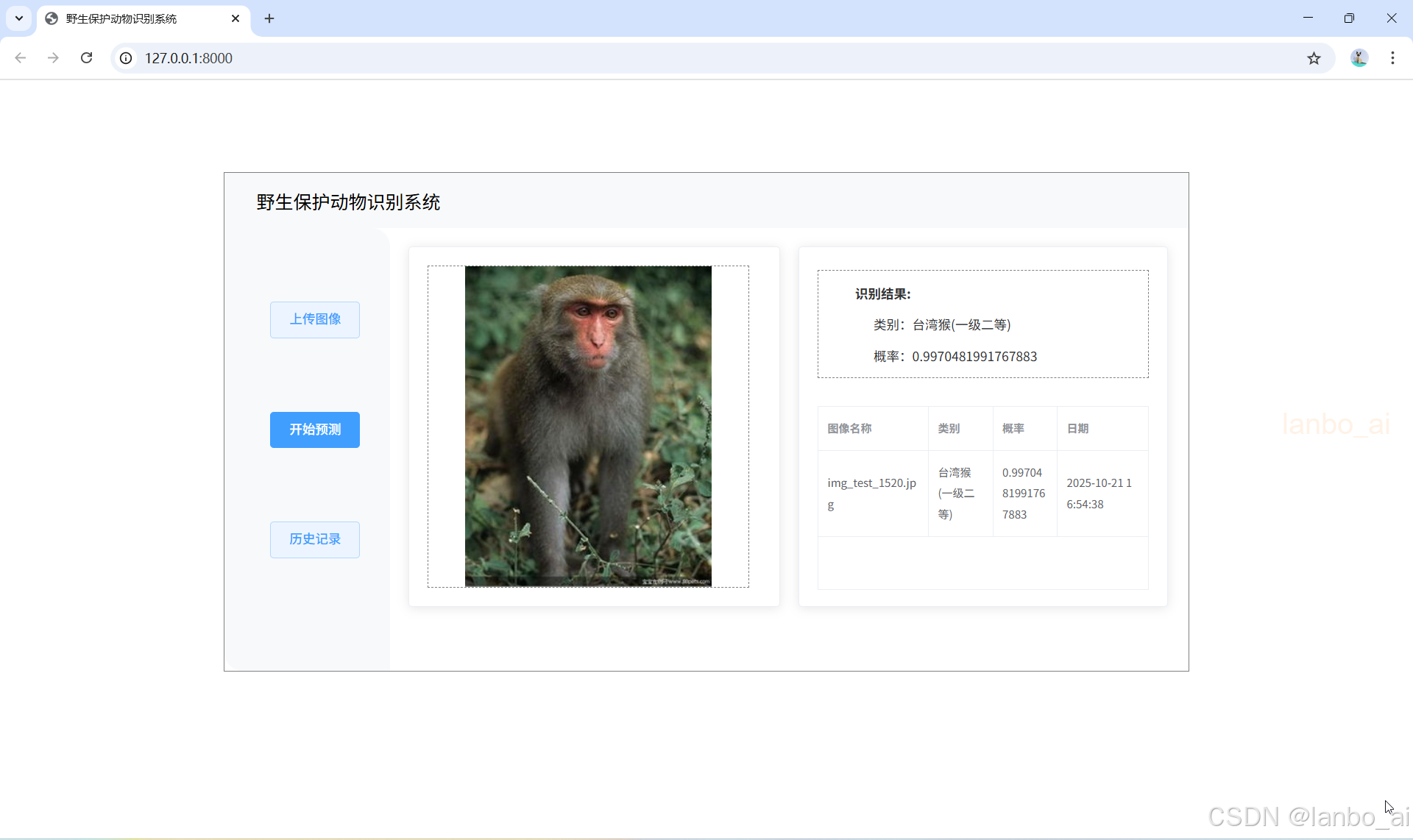

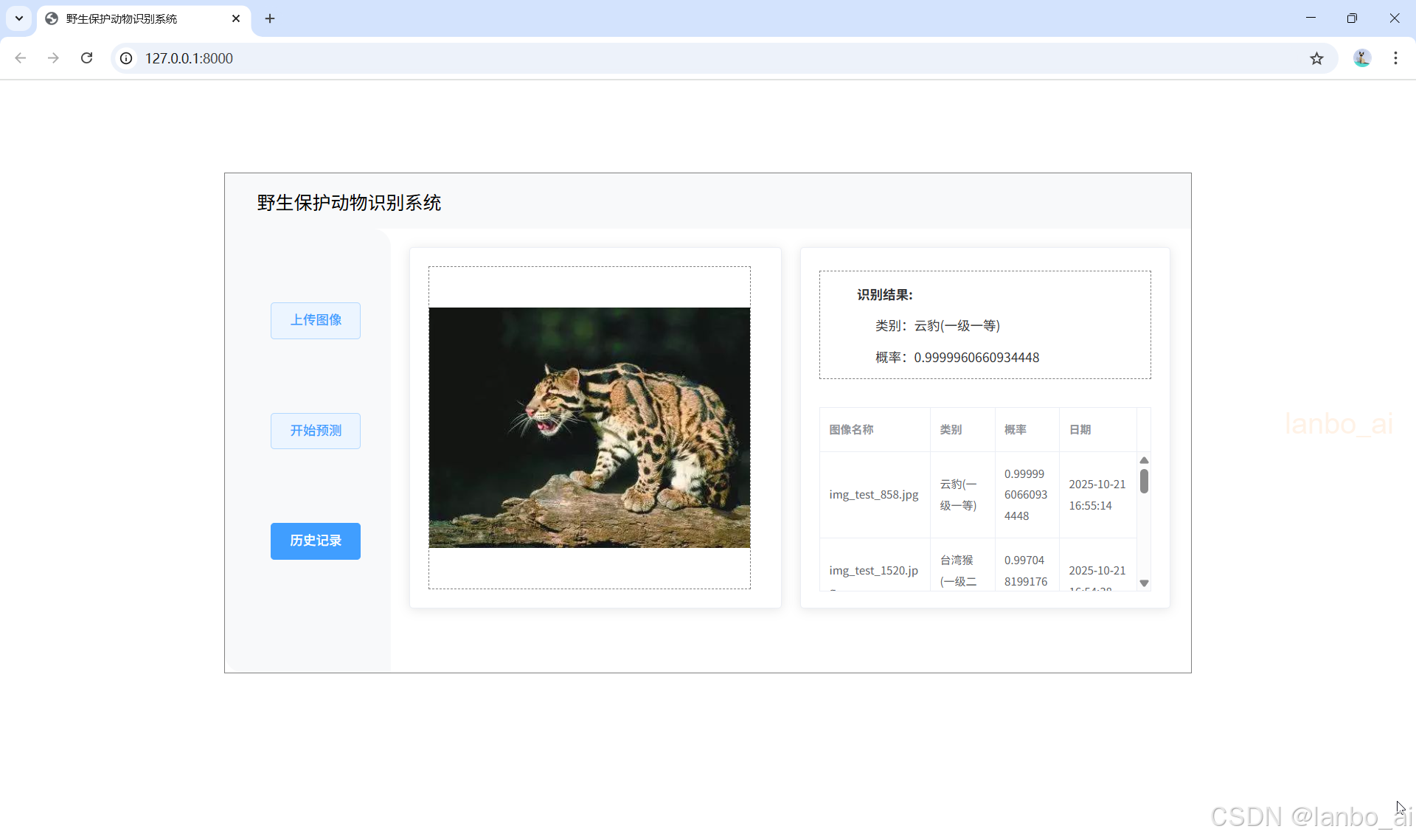

2)分类、识别界面

3)查看历史记录(每次模型预测都会记录到数据库,可查看历史的预测结果)

4.模型训练和测试的一些指标及效果

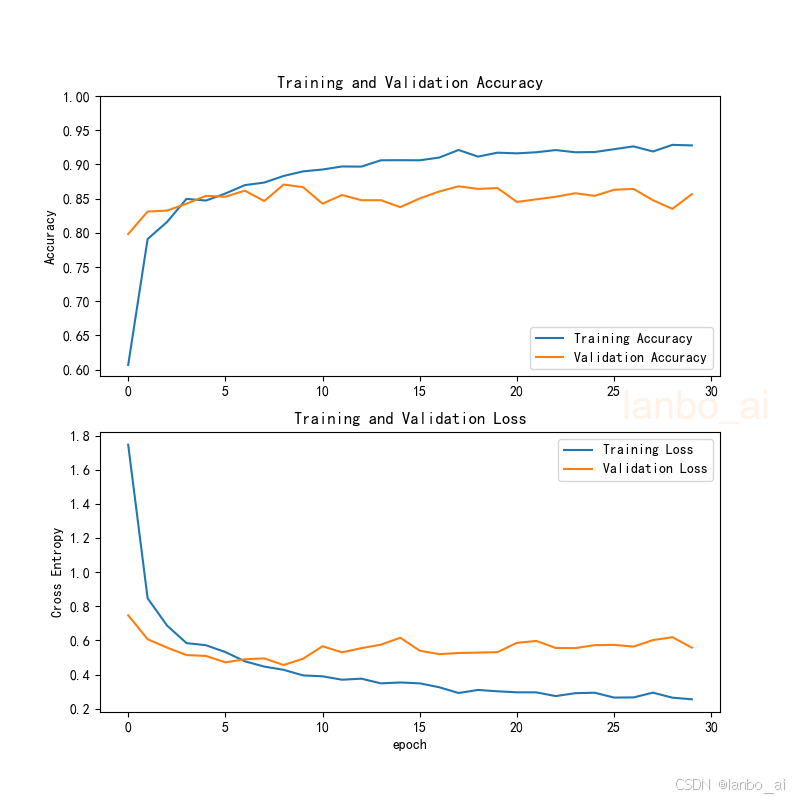

1)模型训练和验证的准确率曲线,损失曲线

2)分类混淆矩阵

3)准确率、精确率、召回率、F1值

4)模型训练和验证记录

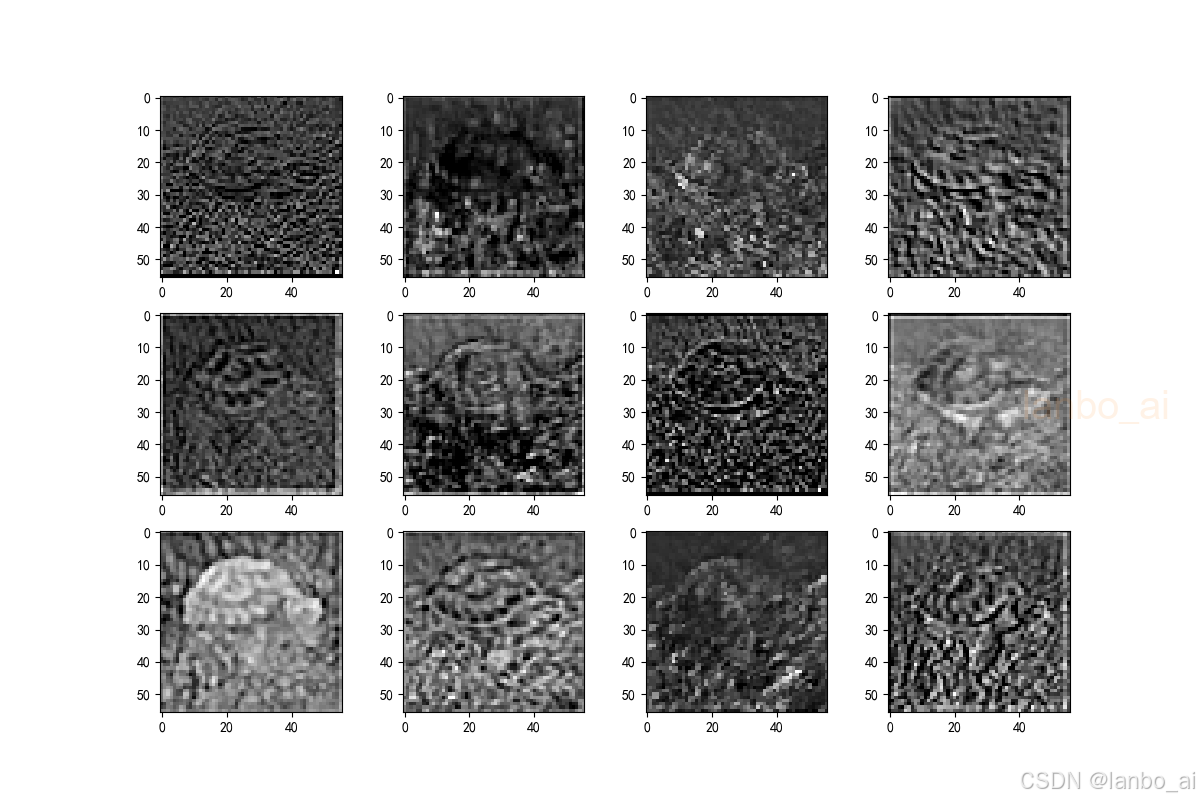

5)模型特征图

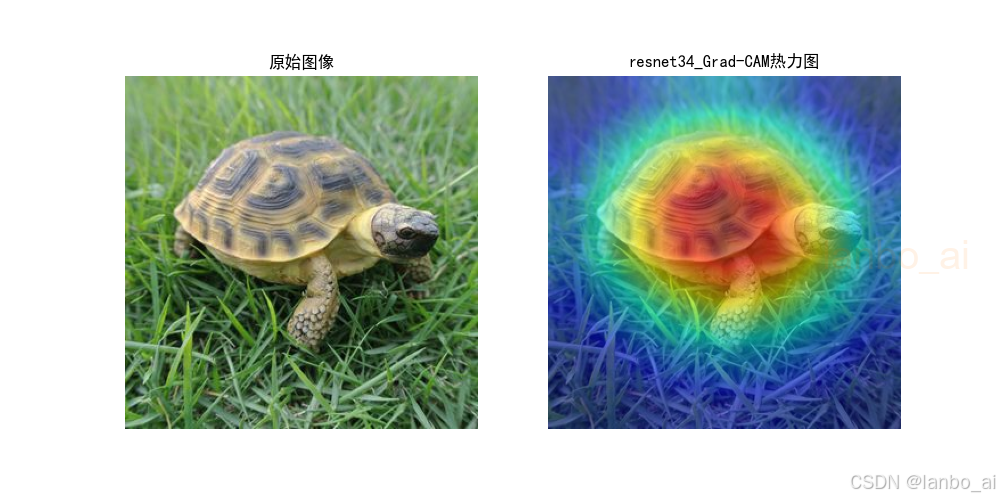

6)热力图

(三)3个模型的参数量对比(模型大小对比)

(四)代码

由于篇幅有限,只展示核心代码

def main(self, epochs):

# 记录训练过程

log_file_name = './results/resnet50训练和验证过程.txt'

# 记录正常的 print 信息

sys.stdout = Logger(log_file_name)

print("using {} device.".format(self.device))

# 开始训练,记录开始时间

begin_time = time()

# 加载数据

train_loader, validate_loader, class_names, train_num, val_num = self.data_load()

print("class_names: ", class_names)

train_steps = len(train_loader)

val_steps = len(validate_loader)

# 加载模型

model = self.model_load() # 创建模型

# 修改全连接层的输出维度

in_channel = model.fc.in_features

model.fc = nn.Linear(in_channel, len(class_names))

# 模型结构可视化

x = torch.randn(16, 3, 224, 224) # 随机生成一个输入

# 模型结构保存路径

model_visual_path = 'results/resnet50_visual.onnx'

# 将 pytorch 模型以 onnx 格式导出并保存

torch.onnx.export(model, x, model_visual_path)

# netron.start(model_visual_path) # 浏览器会自动打开网络结构

# 将模型放入GPU中

model.to(self.device)

# 定义损失函数

loss_function = nn.CrossEntropyLoss()

# 定义优化器

params = [p for p in model.parameters() if p.requires_grad]

optimizer = optim.Adam(params=params, lr=0.0001)

train_loss_history, train_acc_history = [], []

test_loss_history, test_acc_history = [], []

best_acc = 0.0

for epoch in range(0, epochs):

# 下面是模型训练

model.train()

running_loss = 0.0

train_acc = 0.0

train_bar = tqdm(train_loader, file=sys.stdout)

# 进来一个batch的数据,计算一次梯度,更新一次网络

for step, data in enumerate(train_bar):

# 获取图像及对应的真实标签

images, labels = data

# 清空过往梯度

optimizer.zero_grad()

# 得到预测的标签

outputs = model(images.to(self.device))

# 计算损失

train_loss = loss_function(outputs, labels.to(self.device))

# 反向传播,计算当前梯度

train_loss.backward()

# 根据梯度更新网络参数

optimizer.step()

# 累加损失

running_loss += train_loss.item()

# 每行最大值的索引

predict_y = torch.max(outputs, dim=1)[1]

# torch.eq()进行逐元素的比较,若相同位置的两个元素相同,则返回True;若不同,返回False

train_acc += torch.eq(predict_y, labels.to(self.device)).sum().item()

# 更新进度条

train_bar.desc = "train epoch[{}/{}] loss:{:.3f}".format(epoch + 1,

epochs,

train_loss)

# 下面是模型验证

# 不启用 BatchNormalization 和 Dropout,保证BN和dropout不发生变化

model.eval()

# accumulate accurate number / epoch

val_acc = 0.0

testing_loss = 0.0

# 张量的计算过程中无需计算梯度

with torch.no_grad():

val_bar = tqdm(validate_loader, file=sys.stdout)

for val_data in val_bar:

# 获取图像及对应的真实标签

val_images, val_labels = val_data

# 得到预测的标签

outputs = model(val_images.to(self.device))

# 计算损失

val_loss = loss_function(outputs, val_labels.to(self.device))

testing_loss += val_loss.item()

# 每行最大值的索引

predict_y = torch.max(outputs, dim=1)[1]

# torch.eq()进行逐元素的比较,若相同位置的两个元素相同,则返回True;若不同,返回False

val_acc += torch.eq(predict_y, val_labels.to(self.device)).sum().item()

train_loss = running_loss / train_steps

train_accurate = train_acc / train_num

test_loss = testing_loss / val_steps

val_accurate = val_acc / val_num

train_loss_history.append(train_loss)

train_acc_history.append(train_accurate)

test_loss_history.append(test_loss)

test_acc_history.append(val_accurate)

print('[epoch %d] train_loss: %.3f val_accuracy: %.3f' %

(epoch + 1, train_loss, val_accurate))

# 保存最佳模型

if val_accurate > best_acc:

best_acc = val_accurate

torch.save(model.state_dict(), self.model_name)

# 记录结束时间

end_time = time()

run_time = end_time - begin_time

print('该循环程序运行时间:', run_time, "s")

# 绘制模型训练过程图

self.show_loss_acc(train_loss_history, train_acc_history,

test_loss_history, test_acc_history)

# 画热力图

test_real_labels, test_pre_labels = self.heatmaps(model, validate_loader, class_names)

# 计算混淆矩阵

self.calculate_confusion_matrix(test_real_labels, test_pre_labels, class_names)(五)总结

以上即为整个项目的介绍,整个项目主要包括以下内容:完整的程序代码文件、训练好的模型、数据集、界面和各种模型指标图表等。

整套项目资料齐全,一步到位,省心省力。

项目运行过程如出现问题,请及时沟通!

鲲鹏昇腾开发者社区是面向全社会开放的“联接全球计算开发者,聚合华为+生态”的社区,内容涵盖鲲鹏、昇腾资源,帮助开发者快速获取所需的知识、经验、软件、工具、算力,支撑开发者易学、好用、成功,成为核心开发者。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)